собственный момент

Эта статья предоставляет недостаточный контекст для тех, кто не знаком с предметом . ( июнь 2022 г. ) |

Собственные моменты [1] представляет собой набор ортогональных , устойчивых к шуму, инвариантных к вращению, масштабированию, перемещению и чувствительным к распределению моментов . Их применение можно найти в обработке сигналов и компьютерном зрении в качестве дескрипторов сигнала или изображения. Дескрипторы позже можно использовать для целей классификации .

Оно получается путем ортогонализации посредством анализа собственных геометрических моментов . [2]

Краткое изложение структуры

[ редактировать ]Собственные моменты вычисляются путем выполнения собственного анализа в пространстве моментов изображения путем максимизации отношения сигнал/шум в пространстве признаков в форме коэффициента Рэлея .

Этот подход имеет несколько преимуществ в приложениях обработки изображений:

- Зависимость моментов в моментном пространстве от распределения преобразуемых изображений обеспечивает декорреляцию конечного пространства признаков после анализа собственных значений на моментном пространстве.

- Способность EigenMoments учитывать распространение изображения делает его более универсальным и адаптируемым под разные жанры.

- Сгенерированные ядра моментов ортогональны, и поэтому анализ моментного пространства становится проще. Преобразование с ортогональными моментными ядрами в моментное пространство аналогично проецированию изображения на несколько ортогональных осей.

- Нусий компоненты можно удалить. Это делает EigenMoments надежным для приложений классификации.

- Можно получить оптимальное уплотнение информации, и поэтому для характеристики изображений требуется несколько моментов.

Формулировка задачи

[ редактировать ]Предположим, что вектор сигнала берется из определенного распределения, имеющего корреляцию , то есть где E[.] обозначает ожидаемое значение.

Размерность пространства сигналов n часто слишком велика, чтобы быть полезной для практического применения, такого как классификация шаблонов. Нам необходимо преобразовать пространство сигналов в пространство с меньшей размерностью.

Это осуществляется двухэтапным линейным преобразованием:

где преобразованный сигнал, фиксированная матрица преобразования, которая преобразует сигнал в пространство моментов, и матрица преобразования, которую мы собираемся определить путем максимизации SNR пространства признаков, находящегося в . В случае геометрических моментов X будет мономом. Если , результатом будет преобразование полного ранга, однако обычно мы имеем и . Это особенно актуально, когда имеет большие размеры.

Нахождение это максимизирует SNR пространства признаков:

где N – корреляционная матрица шумового сигнала. Таким образом, проблему можно сформулировать как

с учетом ограничений:

где это дельта Кронекера .

Можно заметить, что эта максимизация представляет собой фактор Рэлея, если позволить и и поэтому может быть записано как:

,

коэффициент Рэлея

[ редактировать ]Оптимизация коэффициента Рэлея [3] [4] имеет форму:

и и , оба симметричны и положительно определена и, следовательно, обратима .Масштабирование не меняет значение объектной функции и, следовательно, дополнительного скалярного ограничения может быть наложен на и ни одно решение не будет потеряно при оптимизации целевой функции.

Эту проблему оптимизации ограничений можно решить с помощью множителя Лагранжа :

при условии

приравнивая первую производную нулю, мы будем иметь:

что является примером обобщенной проблемы собственных значений (GEP).ГЭП имеет вид:

для любой пары это решение приведенного выше уравнения, называется обобщенным собственным вектором и называется обобщенным собственным значением .

Нахождение и то, что удовлетворяет этим уравнениям, даст результат, который оптимизирует коэффициент Рэлея .

Одним из способов максимизации коэффициента Рэлея является решение обобщенной проблемы собственных чисел . Уменьшение размеров можно выполнить, просто выбрав первые компоненты. , , с самыми высокими значениями для из компоненты, а остальные выбросьте. Интерпретация этого преобразования заключается в повороте и масштабировании моментного пространства, преобразовании его в пространство признаков с максимальным ОСШ и, следовательно, первым компоненты — это компоненты с самым высоким Значения ОСШ .

Другой способ взглянуть на это решение — использовать концепцию одновременной диагонализации вместо обобщенной проблемы собственных чисел .

Одновременная диагонализация

[ редактировать ]- Позволять и как упоминалось ранее. Мы можем написать как две отдельные матрицы преобразования:

- можно найти, сначала диагонализовав B:

.

Где — диагональная матрица, отсортированная в порядке возрастания. С положительно определен, поэтому . Мы можем отбросить те собственные значения , которые большие, и сохранить те, которые близки к 0, поскольку это означает, что энергия шума в этом пространстве близка к 0. На этом этапе также можно отбросить те собственные векторы , которые имеют большие собственные значения .

Позволять будь первым столбцы , сейчас где это главная подматрица .

- Позволять

и следовательно:

.

отбеливать и уменьшает размерность с к . Преобразованное пространство занимало называется шумовым пространством.

- Затем диагонализуем :

,

где . – матрица с собственными значениями на его диагонали. Мы можем сохранить все собственные значения и соответствующие им собственные векторы, поскольку большая часть шума уже отброшена на предыдущем шаге.

- Наконец, преобразование определяется следующим образом:

где диагонализует как числитель, так и знаменатель SNR ,

, и преобразование сигнала определяется как .

Потеря информации

[ редактировать ]Чтобы найти потерю информации, когда мы отбрасываем некоторые собственные значения и собственные векторы, мы можем выполнить следующий анализ:

собственный момент

[ редактировать ]Собственные моменты получаются путем применения описанной выше схемы к геометрическим моментам. Их можно получить как для 1D, так и для 2D сигналов.

1D-сигнал

[ редактировать ]Если мы позволим , т.е. мономы , после преобразования получаем геометрические моменты, обозначаемые вектором , сигнала , то есть .

На практике оценить корреляционный сигнал сложно из-за недостаточного количества выборок, поэтому используются параметрические подходы.

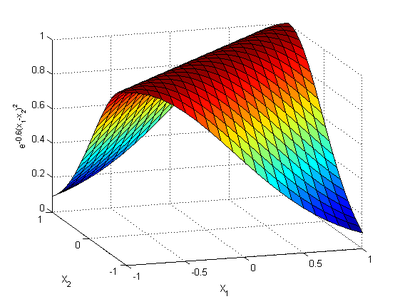

Одну такую модель можно определить как:

,

где . Эту модель корреляции можно заменить другими моделями, однако эта модель охватывает общие природные изображения.

С не влияет на максимизацию, его можно удалить.

Корреляцию шума можно смоделировать как , где – энергия шума. Снова можно отбросить, поскольку константа не оказывает никакого влияния на задачу максимизации.

Используя вычисленные значения A и B и применяя алгоритм, обсуждавшийся в предыдущем разделе, мы находим и множество преобразованных мономов который производит моментные ядра EM. Моментные ядра ЭМ декоррелируют корреляцию на изображении.

,

и ортогональны:

Пример расчета

[ редактировать ]принимая , размерность моментного пространства как и размерность пространства признаков как , у нас будет:

и

2D-сигнал

[ редактировать ]Вывод для 2D-сигнала такой же, как и для 1D-сигнала, за исключением того, что обычные геометрические моменты напрямую используются для получения набора 2D-собственных моментов.

Определение геометрических моментов порядка для сигнала 2D-изображения:

.

который можно обозначить как . Тогда набор 2D EigenMoments:

,

где — это матрица, содержащая набор EigenMoments.

.

Инварианты собственного момента (EMI)

[ редактировать ]Чтобы получить набор моментных инвариантов, мы можем использовать нормированные геометрические моменты. вместо .

Нормализованные геометрические моменты инвариантны к вращению, масштабированию и преобразованию и определяются следующим образом:

где: это центр тяжести изображения и

.

в этом уравнении является коэффициентом масштабирования, зависящим от изображения. обычно устанавливается равным 1 для двоичных изображений.

См. также

[ редактировать ]Ссылки

[ редактировать ]- ^ Пью-Тиан Яп, Равендран Парамесран, Собственные моменты, Распознавание образов, Том 40, Выпуск 4, апрель 2007 г., страницы 1234-1244, ISSN 0031-3203, 10.1016/j.patcog.2006.07.003.

- ^ МК Ху, «Визуальное распознавание образов по моментным инвариантам», IRE Trans. Информация. Теория, том. ИТ-8, стр. 179–187, 1962 г.

- ^ Т. Де Би, Н. Кристианини, Р. Розипал, Собственные проблемы вРаспознавание образов, в: Э. Байро-Коррочано (ред.), Справочник поВычислительная геометрия для распознавания образов, компьютерного зрения,Нейрокомпьютеры и робототехника, Springer, Гейдельберг, 2004G.

- ^ Стрэнг, Линейная алгебра и ее приложения, второе изд., АкадемическийПресс, Нью-Йорк, 1980.

![{\displaystyle C=E[ss^{T}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e5c7314c65aec7c374a5edf9f9aa321dcedbbb24)

![{\displaystyle q=[q_{1},...,q_{n}]^{T}\in {\mathcal {R}}^{k}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/78aadcf4b39577fe2b64766ae5cf5c5b2b2d9132)

![{\displaystyle X=[x_{1},...,x_{n}]^{T}\in {\mathcal {R}}^{n\times m}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6fd7544bfae7e93ef6cf5587534e19d163215ee4)

![{\displaystyle W=[w_{1},...,w_{n}]^{T} \in {\mathcal {R}}^{m\times k}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1e3f5044622ef896099bd33a5c7d2db1e7714b6c)

![{\displaystyle X=[1,x,x^{2},...,x^{m-1}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4605547d9210d9a72eb06da3d0c0f67e7cdb4c0a)

![{\displaystyle s=[s(x)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1002e10ab656cfaab818a0af2497d7729d79110e)

![{\displaystyle r(0,0)=E[tr(ss^{T})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fb07d8686b468aab9620d324e4341ef742f5df98)

![{\displaystyle A=X^{T}CX=\int _{-1}^{1}\int _{-1}^{1}[x_{1}^{j}x_{2}^{i }e^{-c(x_{1}-x_{2})^{2}}]_{i,j=0}^{i,j=m-1}dx_{1}dx_{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/af7ce479d381a08eb945ec5471fd6c36d52014f8)

![{\displaystyle B=X^{T}NX=\int _{-1}^{1}\int _{-1}^{1}[x_{1}^{j}x_{2}^{i }\delta (x_{1},x_{2})]_{i,j=0}^{i,j=m-1}dx_{1}dx_{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f0db38fb55a765ccee9c8e0d2d5a1c9e1aa1a4cc)

![{\displaystyle B=X^{T}NX=\int _{-1}^{1}[x_{1}^{j+i}]_{i,j=0}^{i,j=m -1}dx_{1}=X^{T}X}](https://wikimedia.org/api/rest_v1/media/math/render/svg/56e3ec936011d0b9c9ac822bcd2b52fb2c126f22)

![{\displaystyle \You =[\you _{1},...,\you _{k}]=XW}](https://wikimedia.org/api/rest_v1/media/math/render/svg/30aa0c2a875445b0d49d539613896423f57038b1)

![{\displaystyle {\begin{array}{lll}{\hat {m}}_{pq}&=&\alpha ^{p}+q+2\int _{-1}^{1}\int _ {-1}^{1}[(xx^{c})cos(\theta )+(yy^{c})sin(\theta )]^{p}\\&=&\times [-(xx ^{c})sin(\theta )+(yy^{c})cos(\theta )]^{q}\\&=&\times f(x,y)dxdy,\\\end{array} }}](https://wikimedia.org/api/rest_v1/media/math/render/svg/16dc1d1207f287b46bddc43fe3f7afba4d219759)

![{\displaystyle {\begin{array}{lll}\alpha &=&[m_{00}^{S}/m_{00}]^{1/2}\\\theta &=&{\frac {1 }{2}}tan^{-1}{\frac {2m_{11}}{m_{20}-m_{02}}}\end{array}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ccf2385647efaae81fc118b647f615cc7115e820)