Markov property

В теории вероятностей и статистике термин «марковское свойство» относится к свойству отсутствия памяти у случайного процесса , что означает, что его будущая эволюция не зависит от его истории. Назван в честь российского математика Андрея Маркова . [ 1 ] Термин «сильное марковское свойство» аналогичен марковскому свойству, за исключением того, что значение слова «присутствует» определяется в терминах случайной величины, известной как время остановки .

Термин «допущение Маркова» используется для описания модели, в которой предполагается сохранение марковского свойства, например скрытой марковской модели .

Марковское случайное поле распространяет это свойство на два или более измерений или на случайные величины, определенные для взаимосвязанной сети элементов. [ 2 ] Примером модели такого месторождения является модель Изинга .

Случайный процесс с дискретным временем, удовлетворяющий свойству Маркова, известен как цепь Маркова .

Введение

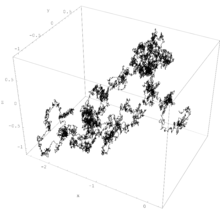

[ редактировать ]Случайный процесс обладает марковским свойством, если условное распределение вероятностей будущих состояний процесса (условное как от прошлых, так и от текущих значений) зависит только от настоящего состояния; то есть, учитывая настоящее, будущее не зависит от прошлого. Процесс с этим свойством называется марковским или марковским и известен как марковский процесс . Двумя известными классами марковских процессов являются цепь Маркова и броуновское движение .

Обратите внимание, что есть тонкий, часто упускаемый из виду и очень важный момент, который часто упускается из виду в простом английском изложении определения. А именно, что пространство состояний процесса остается постоянным во времени. Условное описание предполагает фиксированную «пропускную способность». Например, без этого ограничения мы могли бы дополнить любой процесс таким, который включает полную историю из заданного начального состояния, и сделать его марковским. Но пространство состояний со временем будет иметь возрастающую размерность и не соответствует определению.

История

[ редактировать ]Определение

[ редактировать ]Позволять — вероятностное пространство с фильтрацией для некоторого ( полностью упорядоченного ) набора индексов ; и пусть быть измеримым пространством . А -значный случайный процесс адаптированный к фильтрации Говорят, что обладает марковским свойством , если для каждого и каждый с ,

В случае, когда представляет собой дискретное множество с дискретной сигма-алгеброй и , это можно переформулировать следующим образом:

Альтернативные составы

[ редактировать ]Альтернативно марковское свойство можно сформулировать следующим образом.

для всех и ограничен и измерим. [ 4 ]

Сильное марковское свойство

[ редактировать ]Предположим, что это случайный процесс в вероятностном пространстве с естественной фильтрацией . Тогда для любого времени остановки на , мы можем определить

- .

Затем Говорят, что оно обладает сильным марковским свойством, если для каждого времени остановки , в зависимости от события , у нас есть это для каждого , не зависит от данный .

Из сильного марковского свойства следует обычное марковское свойство, поскольку, взяв время остановки , можно вывести обычное марковское свойство. [ 5 ]

В прогнозировании

[ редактировать ]В области прогнозного моделирования и вероятностного прогнозирования марковское свойство считается желательным, поскольку оно может позволить обосновать и решить проблему, которую в противном случае было бы невозможно решить из-за ее неразрешимости . Такая модель известна как модель Маркова .

Примеры

[ редактировать ]Предположим, что в урне лежат два красных и один зеленый шар. Один шар вытащили вчера, один шар вытащили сегодня, а последний шар выберут завтра. Все розыгрыши «без замены».

Предположим, вы знаете, что сегодняшний мяч был красным, но у вас нет информации о вчерашнем мяче. Вероятность того, что завтрашний шар будет красным, равна 1/2. Это потому, что в этом случайном эксперименте осталось только два результата:

| День | Результат 1 | Результат 2 |

|---|---|---|

| Вчера | Красный | Зеленый |

| Сегодня | Красный | Красный |

| Завтра | Зеленый | Красный |

С другой стороны, если вы знаете, что и сегодня, и вчерашние шары были красными, то завтра вы гарантированно получите зеленый шар.

Это несоответствие показывает, что распределение вероятностей цвета завтрашнего дня зависит не только от текущего значения, но также зависит от информации о прошлом. Этот стохастический процесс наблюдаемых цветов не обладает марковским свойством. Используя тот же эксперимент, описанный выше, если выборку «без замены» заменить на выборку «с заменой», процесс наблюдаемых цветов будет иметь марковское свойство. [ 6 ]

Применение свойства Маркова в обобщенной форме находится в вычислениях Монте-Карло цепей Маркова в контексте байесовской статистики .

См. также

[ редактировать ]- Причинное условие Маркова

- Уравнение Чепмена – Колмогорова

- Гистерезис

- Марковское одеяло

- Цепь Маркова

- Марковский процесс принятия решения

- Markov model

Ссылки

[ редактировать ]- ^ Марков, А.А. (1954). Теория алгоритмов . [Перевод Жака Ж. Шорра-Кона и сотрудников PST] Выходные данные Москва, Академия наук СССР, 1954 г. [Иерусалим, Израильская программа научных переводов, 1961; можно получить в Управлении технических служб Министерства торговли США .] Добавлено в русском переводе трудов Математического института АН СССР, т. 42. Оригинальное название: Теория алгоритмов . [QA248.M2943 Библиотека Дартмутского колледжа. Министерство торговли США, Управление технических служб, номер OTS 60-51085.]

- ^ Додж, Ядола . (2006) Оксфордский словарь статистических терминов , Oxford University Press . ISBN 0-19-850994-4

- ^ Дарретт, Рик . Вероятность: теория и примеры . Четвертое издание. Издательство Кембриджского университета , 2010.

- ^ Оксендал, Бернт К. (2003). Стохастические дифференциальные уравнения: введение с приложениями . Шпрингер, Берлин. ISBN 3-540-04758-1 .

- ^ Этье, Стюарт Н. и Курц, Томас Г. Марковские процессы: характеристика и конвергенция . Серия Уайли по вероятности и математической статистике, 1986, стр. 158.

- ^ «Пример случайного процесса, не обладающего марковским свойством» . Обмен стеками . Проверено 7 июля 2020 г.

![{\displaystyle \operatorname {E} [f(X_{t})\mid {\mathcal {F}}_{s}] = \operatorname {E} [f(X_{t})\mid \sigma (X_ {s})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4c5d802bee0255def457294f63a68e8290ec5bd8)