Модерация контента

На веб-сайтах , которые позволяют пользователям создавать контент, модерация контента — это процесс обнаружения материалов, которые являются неуместными, непристойными, незаконными, вредными или оскорбительными, в отличие от полезных или информативных материалов, часто для цензуры или подавления противоположных точек зрения. Цель модерации контента — удалить или применить предупреждающий ярлык к проблемному контенту или позволить пользователям самостоятельно блокировать и фильтровать контент. [1]

Различные типы интернет-сайтов допускают пользовательский контент, такой как сообщения, комментарии, видео, включая интернет-форумы , блоги и новостные сайты, работающие на основе таких сценариев, как phpBB , Wiki или PHP-Nuke и т. д. В зависимости от содержания сайта и целевой аудитории. , администраторы сайта решают, какие комментарии пользователей являются уместными, а затем делегируют ответственность за анализ комментариев менее важным модераторам . Чаще всего они пытаются устранить троллинг , спам или флейминг , хотя это сильно варьируется от сайта к сайту.

Основные платформы используют комбинацию алгоритмических инструментов, пользовательских отчетов и человеческого анализа. [1] Сайты социальных сетей также могут нанимать модераторов контента, чтобы вручную отмечать или удалять контент, помеченный как разжигание ненависти или другой нежелательный контент. Другие проблемы содержания включают порноместь , графический контент , материалы о жестоком обращении с детьми и пропаганду . [1] Некоторые веб-сайты также должны сделать свой контент пригодным для рекламы. [1]

В Соединенных Штатах модерация контента регулируется разделом 230 Закона о порядочности в сфере коммуникаций , и несколько дел по этому вопросу дошли до Верховного суда США , например, нынешнее дело Moody v. NetChoice, LLC .

Модерация супервайзера

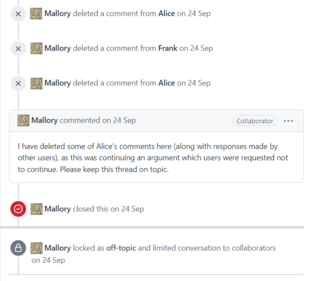

[ редактировать ]Эту систему модерации, также известную как односторонняя модерация, часто можно увидеть на интернет-форумах . Администраторы сайта выбирают группу людей (обычно на долгосрочной основе) в качестве делегатов, обеспечивающих соблюдение правил сообщества от их имени. Этим модераторам предоставляются особые привилегии удалять или редактировать материалы других людей и/или исключать людей на основании их адреса электронной почты или IP-адреса , и, как правило, они пытаются удалить негативные комментарии во всем сообществе. [2]

Модерация коммерческого контента

[ редактировать ]Модерация коммерческого контента — это термин, придуманный Сарой Т. Робертс для описания практики «мониторинга и проверки пользовательского контента (UGC) для платформ социальных сетей всех типов, чтобы гарантировать, что контент соответствует правовым и нормативным требованиям». правила сайта/сообщества, пользовательские соглашения и что это соответствует нормам вкуса и приемлемости для этого сайта и его культурного контекста». [3]

Промышленная композиция

[ редактировать ]Индустрия модерации контента оценивается в 9 миллиардов долларов США. насчитывается около 10 000 модераторов контента Хотя официальные цифры не предоставлены, в TikTok ; 15 000 для Facebook и 1500 для Twitter по состоянию на 2022 год. [4]

Глобальная цепочка создания стоимости модерации контента обычно включает платформы социальных сетей, крупные многонациональные компании и поставщиков модерации контента. Платформы социальных сетей (например, Facebook, Google) в основном базируются в США, Европе и Китае. Многонациональные корпорации (например, Accenture , Foiwe ) обычно имеют штаб-квартиры на севере мира или в Индии, тогда как поставщики услуг по модерации контента в основном расположены в южных странах мира, таких как Индия и Филиппины. [5] : 79–81

Хотя когда-то эта работа могла выполняться добровольцами внутри интернет-сообщества, для коммерческих веб-сайтов это в основном достигается за счет передачи этой задачи специализированным компаниям, часто в регионах с низкой заработной платой, таких как Индия и Филиппины. Аутсорсинг работ по модерации контента вырос в результате бума социальных сетей . В связи с огромным ростом пользователей и пользовательского контента компаниям потребовалось гораздо больше сотрудников для модерации контента. В конце 1980-х и начале 1990-х годов технологические компании начали передавать рабочие места в зарубежные страны, которые имели образованную рабочую силу, но были готовы работать за дешевую цену. [6]

Условия труда

[ редактировать ]Сотрудники работают, просматривая, оценивая и удаляя тревожный контент. [7] В 2014 году Wired сообщил, что они могут получить психологический ущерб. [8] [9] [10] [2] [11] В 2017 году газета Guardian сообщила, что может возникнуть вторичная травма с симптомами, похожими на посттравматическое стрессовое расстройство . [12] Некоторые крупные компании, такие как Facebook, предлагают психологическую поддержку. [12] и все чаще полагаются на использование искусственного интеллекта для сортировки наиболее наглядного и неуместного контента, однако критики утверждают, что этого недостаточно. [13] В 2019 году NPR назвало это опасным для работы. [14] Соглашения о неразглашении являются нормой при найме модераторов контента. Из-за этого модераторы не решаются высказываться об условиях работы или организации. [4]

Психологические риски, включая стресс и посттравматическое стрессовое расстройство , в сочетании с нестабильностью алгоритмического управления и низкой заработной платой делают модерацию контента чрезвычайно сложной задачей. [15] : 123 Количество выполненных задач, например пометка контента как нарушение авторских прав, удаление сообщения, содержащего разжигание ненависти или просмотр графического контента, оценивается количественно для обеспечения производительности и качества . [4]

В феврале 2019 года в отчете о расследовании The Verge были описаны плохие условия труда в Cowlant офисе в Фениксе, штат Аризона . [16] У сотрудников Cowl, которым было поручено модерировать контент для Facebook, возникли проблемы с психическим здоровьем , включая посттравматическое стрессовое расстройство , в результате воздействия изображений насилия , разжигания ненависти и теорий заговора в видеороликах, которые им было поручено оценить. [16] [17] Модераторы офиса в Финиксе сообщали о злоупотреблении наркотиками , алкоголем и сексуальных отношениях на рабочем месте и опасались мести со стороны уволенных работников, которые угрожали причинить им вред. [16] [18] В ответ представитель Cowlant заявил, что компания изучит вопросы, содержащиеся в отчете. [16]

В июне 2019 года The Verge опубликовала последующее расследование офиса Cignant в Тампе, штат Флорида . [19] [20] Сотрудники офиса в Тампе рассказали, что условия труда были хуже, чем в офисе в Финиксе. [19] [21] [22]

Чтобы получить работу, модераторы были обязаны подписать соглашение о неразглашении информации с Cknowant, хотя трое бывших сотрудников нарушили соглашения, предоставив информацию The Verge . [19] [23] Работники офиса в Тампе сообщили о нехватке ресурсов в области психического здоровья. [19] [24] В результате просмотра видеороликов, изображающих насилие, жестокое обращение с животными и сексуальное насилие над детьми , у некоторых сотрудников развилась психологическая травма и посттравматическое стрессовое расстройство. [19] [25] В ответ на негативное освещение, связанное с контрактами на модерацию контента, директор Facebook указал, что Facebook находится в процессе создания «глобальной команды по обеспечению устойчивости», которая будет помогать своим подрядчикам. [19]

Фейсбук

[ редактировать ]Facebook увеличил количество модераторов контента с 4500 до 7500 в 2017 году из-за юридических требований и других разногласий . В Германии Facebook отвечал за удаление высказываний, разжигающих ненависть, в течение 24 часов с момента их публикации. [26] В конце 2018 года Facebook создал наблюдательный совет или внутренний «Верховный суд», который решает, какой контент остается, а какой контент удаляется. [14]

По словам Фрэнсис Хауген , по состоянию на 2021 год количество сотрудников Facebook, ответственных за модерацию контента, было намного меньше. [27]

Твиттер

[ редактировать ]Сайт социальной сети Twitter имеет политику блокировки . В период с августа 2015 года по декабрь 2017 года оно заблокировало более 1,2 миллиона аккаунтов с террористическим контентом, стремясь сократить количество подписчиков и количество контента, связанного с Исламским государством. [28] После приобретения Twitter Илоном Маском в октябре 2022 года правила контента на всей платформе были ослаблены в попытке сделать свободу слова приоритетом. [29] Однако последствия этой кампании были поставлены под сомнение. [30] [31]

Распределенная модерация

[ редактировать ]Пользовательская модерация

[ редактировать ]Пользовательская модерация позволяет любому пользователю модерировать вклады других пользователей. Миллиарды людей в настоящее время ежедневно принимают решения о том, чем поделиться, переслать или сделать видимым. [32] На большом сайте с достаточно большим активным населением это обычно работает хорошо, поскольку относительно небольшое количество нарушителей спокойствия отсеивается голосами остального сообщества.

Модерацию пользователей также можно охарактеризовать как реактивную модерацию. Этот тип модерации зависит от пользователей платформы или сайта, сообщающих о неуместном контенте и нарушающем стандарты сообщества . В этом процессе, когда пользователи сталкиваются с изображением или видео, которые они считают неприемлемыми, они могут нажать кнопку «Пожаловаться». Жалоба подана и поставлена в очередь на рассмотрение модераторов. [33]

Объединение в профсоюзы

[ редактировать ]150 модераторов контента, заключивших контракты с Meta , ByteDance и OpenAI, собрались в Найроби, Кения, чтобы 1 мая 2023 года создать первый африканский союз модераторов контента. Этот союз был создан через 4 года после того, как Дэниел Мотаунг был уволен и подвергся ответным мерам за организацию профсоюза в Sama. , который заключает контракт с Facebook. [34]

См. также

[ редактировать ]- Кнопка «Нравится»

- Система мета-модерации

- Муди против NetChoice, LLC

- Рекомендательная система

- Метрика доверия

- Нам пришлось удалить этот пост

Ссылки

[ редактировать ]- ^ Jump up to: а б с д Григель, Дженнифер; Браун, Нина (июнь 2019 г.). «Мотивированы ли компании, занимающиеся социальными сетями, быть хорошими корпоративными гражданами? Исследование связи между корпоративной социальной ответственностью и безопасностью в социальных сетях» . Телекоммуникационная политика . 43 (5): 2, 3. doi : 10.1016/j.telpol.2018.12.003 . S2CID 158295433 . Проверено 25 мая 2022 г.

- ^ Jump up to: а б «Невидимые сборщики данных зачищают популярные веб-сайты — Аль-Джазира Америка» . aljazeera.com .

- ^ «За ширмой: модерация коммерческого контента (CCM)» . Сара Т. Робертс | Иллюзия воли . 20 июня 2012 г. Проверено 3 февраля 2017 г.

- ^ Jump up to: а б с Вамай, Жаклин Вамбуи; Калуме, Морин Чади; Гачуки, Моника; Муками, Агнес (2023). «Новый социальный контракт для платформ социальных сетей: приоритет прав и условий работы для создателей контента и модераторов | Международная организация труда» . Международный журнал исследований труда . 12 (1–2). Международная организация труда . Проверено 21 июля 2024 г.

- ^ Ахмад, Сана; Кшивдзинский, Мартин (2022), Грэм, Марк; Феррари, Фабиан (ред.), «Модерирование в безвестности: как индийские модераторы контента работают в глобальных цепочках создания стоимости модерации контента» , Цифровая работа на планетарном рынке , MIT Press , стр. 77–95, ISBN 978-0-262-36982-4 , получено 22 июля 2024 г.

- ^ Эллиотт, Виттория; Пармар, Текендра (22 июля 2020 г.). " "Тьма и отчаяние людей доберутся до тебя" " . остальной мир .

- ^ Стоун, Брэд (18 июля 2010 г.). «Забота о тех, кто проверяет Интернет на предмет варварства» . Нью-Йорк Таймс .

- ^ Адриан Чен (23 октября 2014 г.). «Рабочие, которые не пускают фотографии членов и обезглавливания в вашу ленту на Facebook» . ПРОВОДНОЙ . Архивировано из оригинала 13 сентября 2015 г.

- ^ «Невидимые пожиратели грехов Интернета» . Шило . Архивировано из оригинала 8 сентября 2015 г.

- ^ «Профессор раскрывает скрытую рабочую силу Интернета» . Западные новости . 19 марта 2014 г.

- ^ «Должен ли Facebook блокировать оскорбительные видео до их публикации?» . ПРОВОДНОЙ . 26 августа 2015 г.

- ^ Jump up to: а б Оливия Солон (04 мая 2017 г.). «Facebook нанимает модераторов. Но неужели эта работа слишком ужасна, чтобы с ней можно было справиться?» . Хранитель . Проверено 13 сентября 2018 г.

- ^ Оливия Солон (25 мая 2017 г.). «Недоплачивают и перегружены работой: жизнь модератора Facebook» . Хранитель . Проверено 13 сентября 2018 г.

- ^ Jump up to: а б Отвратительно, Терри. «Для модераторов контента Facebook травмирующий материал представляет собой угрозу для работы» . NPR.org .

- ^ Гиллеспи, Тарлтон (2018). Хранители Интернета: платформы, модерация контента и скрытые решения, которые формируют социальные сети (PDF) . Издательство Йельского университета . ISBN 978-0-300-23502-9 .

- ^ Jump up to: а б с д Ньютон, Кейси (25 февраля 2019 г.). «Тайная жизнь модераторов Facebook в Америке» . Грань . Архивировано из оригинала 21 февраля 2021 года . Проверено 20 июня 2019 г.

- ^ Файнер, Лорен (25 февраля 2019 г.). «Рецензенты контента Facebook борются с симптомами посттравматического стрессового расстройства, занимаясь сексом и употребляя наркотики на работе, — говорится в отчете» . CNBC . Архивировано из оригинала 20 июня 2019 года . Проверено 20 июня 2019 г.

- ^ Сильверстайн, Джейсон (25 февраля 2019 г.). «Facebook обещает улучшить проверку контента после того, как модераторы заявили, что они пострадали от посттравматического стрессового расстройства» . Новости CBS . Архивировано из оригинала 20 июня 2019 года . Проверено 20 июня 2019 г.

- ^ Jump up to: а б с д и ж Ньютон, Кейси (19 июня 2019 г.). «Три модератора Facebook нарушают свои соглашения о неразглашении, чтобы подвергнуть компанию кризису» . Грань . Архивировано из оригинала 12 сентября 2022 года . Проверено 20 июня 2019 г.

- ^ Бридж, Марк (20 июня 2019 г.). «Сотрудник Facebook, умерший от сердечного приступа, находился под «неземным» давлением » Таймс . ISSN 0140-0460 . Архивировано из оригинала 20 июня 2019 года . Проверено 20 июня 2019 г.

- ^ Карбоне, Кристофер (20 июня 2019 г.). «Модератор Facebook умер после просмотра ужасающих видео, другие делятся тревожными инцидентами: отчет» . Фокс Ньюс . Архивировано из оригинала 21 июня 2019 года . Проверено 21 июня 2019 г.

- ^ Эдичико, Лиза (19 июня 2019 г.). «Модератор контента Facebook умер после сердечного приступа на работе» . Сан-Антонио Экспресс-Новости . Архивировано из оригинала 30 ноября 2019 года . Проверено 20 июня 2019 г.

- ^ Файнер, Лорен (19 июня 2019 г.). «Модераторы контента Facebook нарушают соглашения о неразглашении, чтобы разоблачить шокирующие условия работы, включая ужасные видеоролики и размазанные по стенам фекалии» . CNBC . Архивировано из оригинала 19 июня 2019 года . Проверено 20 июня 2019 г.

- ^ Джонсон, О'Райан (19 июня 2019 г.). «Cowlant получает 200 миллионов долларов от Facebook за умеренно насильственный контент на фоне обвинений в «грязных» условиях работы: отчет» . КРН . Архивировано из оригинала 20 июня 2019 года . Проверено 20 июня 2019 г.

- ^ Буфкин, Элли (19 июня 2019 г.). «Отчет раскрывает отчаянные условия работы модераторов Facebook, включая смерть» . Вашингтонский экзаменатор . Архивировано из оригинала 20 июня 2019 года . Проверено 20 июня 2019 г.

- ^ «Искусственный интеллект создаст новые виды труда» . Экономист . Проверено 2 сентября 2017 г.

- ^ Бёмерманн, Ян (10 декабря 2021 г.). Информатор Facebook Фрэнсис Хауген рассказывает о документах Facebook . де: ZDF Magazin Royale .

- ^ Гартенштейн-Росс, Дэйвид; Кодуваюр, Варша (26 мая 2022 г.). «Новый закон Техаса о социальных сетях создаст убежище для глобальных экстремистов» . Foreignpolicy.com . Внешняя политика . Проверено 27 мая 2022 г.

- ^ «Илон Маск на X: «@essagar Приостановить действие аккаунта крупной новостной организации в Твиттере за публикацию правдивой истории было явно неуместно » . Твиттер . Проверено 21 августа 2023 г.

- ^ Бюрель, Грегуар; Алани, Харит; Фаррелл, Трейси (12 мая 2022 г.). «Илон Маск мог бы отменить модерацию в социальных сетях – точно так же, как мы изучаем, как это может остановить дезинформацию» . Разговор . Проверено 21 августа 2023 г.

- ^ Фунг, Брайан (2 июня 2023 г.). «Twitter теряет своего главного специалиста по модерации контента в ключевой момент» . Новости CNN .

- ^ Хартманн, Ивар А. (апрель 2020 г.). «Новая система модерации онлайн-контента» . Обзор компьютерного права и безопасности . 36 :3. дои : 10.1016/j.clsr.2019.105376 . S2CID 209063940 . Проверено 25 мая 2022 г.

- ↑ Граймс-Виорт, Блез (7 декабря 2010 г.). «6 типов модерации контента, о которых вам нужно знать». Социальные сети сегодня .

- ^ Перриго, Билли (01 мая 2023 г.). «150 работников искусственного интеллекта проголосовали за объединение в профсоюз на встрече в Найроби» . Время . Проверено 21 июля 2024 г.

Дальнейшее чтение

[ редактировать ]- Сара Т. Робертс (2019). За ширмой: модерация контента в тени социальных сетей . Издательство Йельского университета. ISBN 978-0300235883 .

- Алхури, Хамед; Альварес, Омар; Фурута, Ричард; Муньис, Мигель; Урбина, Эдуардо (2009), «Поддержка создания научных библиографий сообществами посредством социального сотрудничества, основанного на онлайн-репутации» , Исследования и передовые технологии для цифровых библиотек , том. 5714, Берлин, Гейдельберг: Springer , стр. 180–191, doi : 10.1007/978-3-642-04346-8_19 , ISBN. 978-3-642-04345-1 , получено 24 июля 2024 г.

Внешние ссылки

[ редактировать ]- Запрос работников данных — результат сотрудничества Института Вайценбаума , Берлинского технического университета и DAIR.

- Клифф Лампе и Пол Резник: Слэш (точка) и сжигание: распределенная модерация в большом онлайн-пространстве для разговоров. Материалы конференции SIGCHI по человеческому фактору в вычислительных системах, содержание, Вена, Австрия, 2005, 543–550.