Пиковая нейронная сеть

В этой статье есть несколько проблем. Пожалуйста, помогите улучшить его или обсудите эти проблемы на странице обсуждения . ( Узнайте, как и когда удалять эти шаблонные сообщения )

|

Пиковые нейронные сети ( SNN ) — это искусственные нейронные сети (ИНС), которые более точно имитируют естественные нейронные сети. [1] Помимо состояния нейронов и синапсов , SNN включают в свою операционную модель концепцию времени. Идея состоит в том, что нейроны в SNN не передают информацию в каждом цикле распространения (как это происходит с типичными многослойными перцептронными сетями ), а передают информацию только тогда, когда мембранный потенциал — внутреннее качество нейрона, связанное с его мембранными электрическими свойствами. заряд — достигает определенного значения, называемого порогом. Когда мембранный потенциал достигает порога, нейрон срабатывает и генерирует сигнал, который передается другим нейронам, которые, в свою очередь, увеличивают или уменьшают свои потенциалы в ответ на этот сигнал. Модель нейрона, которая срабатывает в момент пересечения порога, также называется моделью импульсного нейрона . [2]

Хотя ранее считалось, что мозг кодирует информацию посредством частоты импульсов, которую можно рассматривать как аналоговую переменную выходную мощность традиционной ИНС. [3] исследования в области нейробиологии показали, что высокоскоростная обработка не может выполняться исключительно по схеме, основанной на скорости. Например, люди могут выполнять задачу распознавания изображений со скоростью, требующей не более 10 мс времени обработки на нейрон через последовательные слои (от сетчатки до височной доли). Это временное окно слишком короткое для кодирования на основе скорости. Точное время импульсов в небольшом наборе импульсных нейронов также имеет более высокую способность кодирования информации по сравнению с подходом, основанным на частоте. [4]

Наиболее известной моделью импульсных нейронов является модель «протекающей интеграции и запуска» . [5] В модели «интегрировать и запустить» мгновенный уровень активации (смоделированный как дифференциальное уравнение ) обычно считается состоянием нейрона, при этом входящие спайки повышают или понижают это значение до тех пор, пока состояние в конечном итоге либо не затухнет, либо — если срабатывание порог достигнут — нейрон срабатывает. После срабатывания переменная состояния сбрасывается до более низкого значения.

Существуют различные методы декодирования для интерпретации исходящей последовательности спайков как числа реального значения, основанного либо на частоте спайков ( код скорости ), времени до первого импульса после стимуляции, либо на интервале между спайками.

История [ править ]

Этот раздел нуждается в дополнительных цитатах для проверки . ( декабрь 2018 г. ) |

Многие многослойные искусственные нейронные сети полностью связаны между собой : они получают входные данные от каждого нейрона предыдущего слоя и передают сигналы каждому нейрону последующего слоя. Хотя эти сети совершили прорыв во многих областях, они биологически неточны и не имитируют механизм работы нейронов в мозгу живого существа. [ нужна ссылка ]

Биологическая Ходжкина-Хаксли модель спайкового нейрона потенциалы действия была предложена в 1952 году. Эта модель описывает, как инициируются и распространяются . Связь между нейронами, которая требует обмена химическими нейротрансмиттерами в синаптической щели, описывается в различных моделях, таких как модель интеграции и огня , модель ФитцХью-Нагумо (1961–1962) и модель Хиндмарша-Роуза (1984). . Обычно используется дырявая модель «интеграция и запуск» (или ее производная), поскольку ее легче вычислить, чем модель Ходжкина – Хаксли. [6]

Основы [ править ]

Эта статья нуждается в дополнительных цитатах для проверки . ( ноябрь 2021 г. ) |

Информация в мозге представлена в виде потенциалов действия (нейронных спайков), которые могут быть сгруппированы в серии спайков или даже в скоординированные волны мозговой активности. Фундаментальный вопрос нейробиологии состоит в том, чтобы определить, общаются ли нейроны по скорости или по временному коду . [7] Временное кодирование предполагает, что один импульсный нейрон может заменить сотни скрытых единиц в сигмоидальной нейронной сети . [1]

SNN выполняет вычисления в непрерывной, а не в дискретной области. Идея состоит в том, что нейроны не могут тестировать активацию на каждой итерации распространения (как в случае с типичной многослойной перцептронной сетью), а только тогда, когда их мембранные потенциалы достигают определенного значения. Когда нейрон активируется, он вырабатывает сигнал, который передается подключенным нейронам, повышая или понижая их мембранный потенциал.

В импульсной нейронной сети текущее состояние нейрона определяется как его мембранный потенциал (возможно, моделируемый как дифференциальное уравнение). [8] Входной импульс вызывает повышение мембранного потенциала на некоторое время, а затем постепенное снижение. Были построены схемы кодирования для интерпретации этих последовательностей импульсов как числа с учетом как частоты импульсов, так и интервала между импульсами. Можно создать модель нейронной сети, основанную на времени генерации импульса. [9] Используя точное время появления импульса, нейронная сеть может использовать больше информации и предлагать лучшие вычислительные свойства. [10]

Подход SNN обеспечивает непрерывный вывод вместо двоичного вывода традиционных искусственных нейронных сетей (ИНС). Последовательности импульсов нелегко интерпретировать, поэтому необходимы схемы кодирования, описанные выше. Однако представление последовательности импульсов может больше подходить для обработки пространственно-временных данных (или непрерывной классификации сенсорных данных реального мира). [11] SNN учитывают пространство, соединяя нейроны только с соседними нейронами, чтобы они обрабатывали входные блоки отдельно (аналогично CNN, использующему фильтры). Они учитывают время, кодируя информацию в виде последовательности импульсов, чтобы не потерять информацию в двоичном кодировании. Это позволяет избежать дополнительной сложности рекуррентной нейронной сети (RNN). Оказывается, импульсные нейроны — более мощные вычислительные единицы, чем традиционные искусственные нейроны. [12]

SNN теоретически более мощны, чем так называемые «сети второго поколения», определенные в [12] как «[ИНС] на основе вычислительных блоков, которые применяют функцию активации с непрерывным набором возможных выходных значений к взвешенной сумме (или полиному) входных данных; однако проблемы обучения SNN и требования к оборудованию ограничивают их использование. Хотя неконтролируемое биологически вдохновленное обучение доступны такие методы, как обучение Хеббиана и STDP , ни один эффективный контролируемый метод обучения не подходит для SNN, которые могут обеспечить лучшую производительность, чем сети второго поколения. [12] Активация SNN на основе всплесков не является дифференцируемой, что затрудняет разработку градиентного спуска методов обучения на основе для выполнения обратного распространения ошибки .

SNN требуют гораздо больших вычислительных затрат для моделирования реалистичных нейронных моделей, чем традиционные ANN. [13]

Нейронные сети с импульсной связью (PCNN) часто путают с SNN. PCNN можно рассматривать как разновидность SNN.

В настоящее время существует несколько проблем при использовании SNN, над которыми активно работают исследователи. Первая проблема касается недифференцируемости резкой нелинейности. Выражения для методов прямого и обратного обучения содержат производную функции нейронной активации, которая не является дифференцируемой, поскольку выходной сигнал нейрона равен либо 1, когда он всплеск, и 0 в противном случае. Такое поведение двоичной пиковой нелинейности по принципу «все или ничего» останавливает «течение» градиентов и делает LIF-нейроны непригодными для оптимизации на основе градиента. Вторая проблема касается реализации самого алгоритма оптимизации. Стандартный BP может быть дорогостоящим с точки зрения вычислений, памяти и связи и может плохо подходить для ограничений, налагаемых аппаратным обеспечением, которое его реализует (например, компьютером, мозгом или нейроморфным устройством). [14] Что касается первой проблемы, то существует несколько подходов к ее решению. Некоторые из них:

- прибегая к полностью биологическим правилам местного обучения для скрытых единиц

- перевод традиционно обученных «скоростных» NN в SNN

- сглаживание сетевой модели, чтобы она была непрерывно дифференцируемой

- определение SG (суррогатного градиента) как непрерывного ослабления реальных градиентов

В разработке SNN включение в модели нейронов дополнительной динамики нейронов, такой как адаптация пиковой частоты (SFA), является заметным достижением, повышающим как эффективность, так и вычислительную мощность. [5] [15] Эти нейроны находятся между биологической сложностью и вычислительной сложностью. [16] Основанный на биологических знаниях, SFA предлагает значительные вычислительные преимущества за счет снижения энергопотребления за счет эффективного кодирования. [17] особенно в случаях повторяющихся или интенсивных раздражителей. Эта адаптация улучшает четкость сигнала на фоне фонового шума и вводит элементарную кратковременную память на уровне нейронов, что, в свою очередь, повышает точность и эффективность обработки информации. [18] В последнее время это явление в основном достигалось с помощью моделей компартментарных нейронов . Более простые версии представляют собой модели нейронов с адаптивными порогами, что является косвенным способом достижения SFA. Он наделяет SNN улучшенными возможностями обучения, даже при ограниченной синаптической пластичности, и повышает эффективность вычислений. [19] [20] Эта функция снижает потребность в сетевых уровнях за счет уменьшения необходимости обработки всплесков, тем самым сокращая вычислительную нагрузку и время доступа к памяти — важные аспекты нейронных вычислений. Более того, SNN, использующие нейроны, способные к SFA, достигают уровня точности, который конкурирует с показателями обычных искусственных нейронных сетей, в том числе основанных на моделях долговременной краткосрочной памяти. [21] [22] при этом требуется меньше нейронов для сопоставимых вычислительных задач. Такая эффективность не только оптимизирует вычислительный рабочий процесс, но также экономит пространство и энергию, предлагая прагматичный шаг вперед в практическом применении SNN для сложных вычислительных задач при сохранении приверженности технической целостности.

Приложения [ править ]

Этот раздел нуждается в дополнительных цитатах для проверки . ( декабрь 2018 г. ) |

SNN в принципе могут применяться к тем же приложениям, что и традиционные ANN. [23] Кроме того, SNN могут моделировать центральную нервную систему биологических организмов, таких как насекомое, ищущее пищу без предварительного знания окружающей среды. [24] Благодаря относительной реалистичности их можно использовать для изучения работы биологических нейронных цепей . Начав с гипотезы о топологии биологической нейронной цепи и ее функции, записи этой цепи можно сравнить с выходными данными соответствующей SNN, оценивая правдоподобность гипотезы. Однако для SNN отсутствуют эффективные механизмы обучения, что может быть тормозом для некоторых приложений, включая задачи компьютерного зрения.

По состоянию на 2019 год SNN отстают от ИНС по точности, но разрыв сокращается, а в некоторых задачах исчез. [25]

При использовании SNN для данных на основе изображений изображения необходимо преобразовать в двоичные последовательности импульсов. [26] Типы кодировок включают в себя: [27]

- Временное кодирование; генерация одного спайка на нейрон, при этом задержка спайка обратно пропорциональна интенсивности пикселя.

- Кодирование скорости: преобразование интенсивности пикселей в последовательность пиков, где количество пиков пропорционально интенсивности пикселей.

- Прямое кодирование; использование обучаемого слоя для генерации значения с плавающей запятой для каждого временного шага. Слой преобразует каждый пиксель в определенный момент времени в значение с плавающей запятой, а затем для сгенерированных значений с плавающей запятой используется пороговое значение для выбора нуля или единицы.

- Фазовое кодирование; кодирование временной информации в пиковые паттерны на основе глобального осциллятора.

- Пакетное кодирование; передавая всплеск спайков за малое время, повышая надежность синаптической связи между нейронами.

Программное обеспечение [ править ]

Этот раздел нуждается в дополнительных цитатах для проверки . ( декабрь 2018 г. ) |

Разнообразное прикладное программное обеспечение может моделировать SNN. Это программное обеспечение можно классифицировать в зависимости от его использования:

Моделирование SNN [ править ]

Они моделируют сложные нейронные модели с высоким уровнем детализации и точности. Большие сети обычно требуют длительной обработки. Среди кандидатов: [28]

- Брайан – разработан Роменом Бреттом и Дэном Гудманом в Высшей нормальной школе ;

- GENESIS (Общая система нейронного моделирования) [29] ) – разработан в лаборатории Джеймса Бауэра в Калифорнийском технологическом институте ;

- NEST – разработан Инициативой NEST;

- NEURON – в основном разработан Майклом Хайнсом, Джоном В. Муром и Тедом Карневейлом в Йельском университете и Университете Дьюка ;

- RAVSim (инструмент выполнения) [30] – в основном разработан Санауллой из Университета прикладных наук и искусств Билефельда ;

Аппаратное обеспечение [ править ]

Этот раздел нуждается в дополнительных цитатах для проверки . ( декабрь 2018 г. ) |

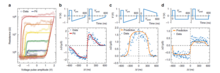

Будущие нейроморфные архитектуры [31] будет состоять из миллиардов таких наносинапсов, что требует четкого понимания физических механизмов, ответственных за пластичность. Экспериментальные системы на основе сегнетоэлектрических туннельных переходов были использованы, чтобы показать, что STDP можно использовать за счет гетерогенного переключения поляризации. С помощью комбинированной визуализации сканирующих зондов, электрического транспорта и молекулярной динамики атомного масштаба изменения проводимости можно моделировать путем изменения направления доменов с преобладанием нуклеации. Моделирование показывает, что массивы сегнетоэлектрических наносинапсов могут автономно учиться распознавать закономерности предсказуемым образом, открывая путь к обучению без присмотра . [32]

- Akida — это полностью цифровое устройство нейронной обработки, основанное на событиях, с 1,2 миллионами искусственных нейронов и 10 миллиардами искусственных синапсов, разработанное BrainChip . Используя управление событиями, оно анализирует важные входные данные в определенных точках. Результаты сохраняются во встроенных блоках памяти.

- Neurogrid — это плата, которая может моделировать импульсные нейронные сети непосредственно на аппаратном уровне. (Стэнфордский университет)

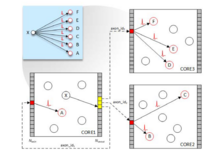

- SpiNNaker (Spiking Neural Network Architecture) использует процессоры ARM в качестве строительных блоков массово-параллельной вычислительной платформы, основанной на шестиуровневой таламокортикальной модели. ( Манчестерский университет ) [33] Система SpiNNaker основана на численных моделях, выполняемых в реальном времени на специализированных цифровых многоядерных чипах с использованием архитектуры ARM . Он предоставляет специальные цифровые чипы, каждый из которых имеет восемнадцать ядер и общую локальную оперативную память объемом 128 Мбайт, в общей сложности более 1 000 000 ядер. [34] Один чип может моделировать 16 000 нейронов с восемью миллионами пластиковых синапсов, работающих в режиме реального времени. [35]

- TrueNorth — процессор, содержащий 5,4 миллиарда транзисторов, потребляющий всего 70 милливатт ; большинство процессоров персональных компьютеров содержат около 1,4 миллиарда транзисторов и требуют 35 Вт и более. IBM называет принцип проектирования, лежащий в основе TrueNorth, нейроморфными вычислениями . Его основная цель — распознавание образов. Хотя критики говорят, что чип недостаточно мощный, его сторонники отмечают, что это только первое поколение, и возможности улучшенных итераций станут очевидными. (ИБМ) [36]

Тесты [ править ]

Возможности классификации шиповых сетей, обученных методами обучения без учителя [37] были протестированы на общих эталонных наборах данных, таких как Iris, Wisconsin Breast Cancer или набор данных Statlog Landsat. [38] [39] Использовались различные подходы к кодированию информации и проектированию сетей. Например, двухуровневая сеть прямой связи для кластеризации и классификации данных. На основе идеи, предложенной Хопфилдом (1995), авторы реализовали модели локальных рецептивных полей, сочетающие свойства радиальных базисных функций (RBF) и импульсных нейронов для преобразования входных сигналов (классифицированных данных), имеющих представление с плавающей запятой, в представление импульсов. [40] [41]

См. также [ править ]

Ссылки [ править ]

- ^ Jump up to: Перейти обратно: а б Маасс В. (1997). «Сети спайковых нейронов: третье поколение моделей нейронных сетей». Нейронные сети . 10 (9): 1659–1671. дои : 10.1016/S0893-6080(97)00011-7 . ISSN 0893-6080 .

- ^ Герстнер В., Кистлер В.М. (2002). Модели спайковых нейронов: отдельные нейроны, популяции, пластичность . Кембридж, Великобритания: Издательство Кембриджского университета. ISBN 0-511-07817-Х . OCLC 57417395 .

- ^ Ван, Сянвэнь; Линь, Сянхун; Данг, Сяочао (01 мая 2020 г.). «Обучение с учителем в импульсных нейронных сетях: обзор алгоритмов и оценок» . Нейронные сети . 125 : 258–280. doi : 10.1016/j.neunet.2020.02.011 . ISSN 0893-6080 . ПМИД 32146356 . S2CID 212638634 .

- ^ Тахерхани, Абузар; Белатрече, Аммар; Ли, Юхуа; Косма, Джорджина; Магуайр, Лиам П.; Макгиннити, ТМ (01 февраля 2020 г.). «Обзор обучения биологически правдоподобных импульсных нейронных сетей» . Нейронные сети . 122 : 253–272. дои : 10.1016/j.neunet.2019.09.036 . ISSN 0893-6080 . ПМИД 31726331 . S2CID 207904985 .

- ^ Jump up to: Перейти обратно: а б Гангули, Читтотош; Безугам, Саи Сукрут; Абс, Элизабет; Пайванд, Мелика; Дей, Сунак; Сури, Манан (1 февраля 2024 г.). «Адаптация частоты спайков: соединение нейронных моделей и нейроморфных приложений» . Инженерия связи . 3 (1): 22. дои : 10.1038/s44172-024-00165-9 . ISSN 2731-3395 . ПМЦ 11053160 .

- ^ Ли Д., Ли Джи, Квон Д., Ли С., Ким Ю, Ким Дж. (июнь 2018 г.). «Flexon: гибкий цифровой нейрон для эффективного моделирования импульсных нейронных сетей». ACM/IEEE, 2018 г. 45-й ежегодный международный симпозиум по компьютерной архитектуре (ISCA ) стр. 275–288. дои : 10.1109/isca.2018.00032 . ISBN 978-1-5386-5984-7 . S2CID 50778421 .

- ^ Герстнер В. (2001). «Спайковые нейроны» . В Маасс В., епископ К.М. (ред.). Импульсные нейронные сети . МТИ Пресс. ISBN 978-0-262-63221-8 .

- ^ Ходжкин, Алабама; Хаксли, А. Ф. (28 августа 1952 г.). «Количественное описание мембранного тока и его применение к проводимости и возбуждению нерва» . Журнал физиологии . 117 (4): 500–544. дои : 10.1113/jphysicalol.1952.sp004764 . ISSN 0022-3751 . ПМК 1392413 . ПМИД 12991237 .

- ^ Дэн, Ян; Пу, Му-Минг (июль 2006 г.). «Пластичность, зависящая от времени всплеска: от синапса к восприятию» . Физиологические обзоры . 86 (3): 1033–1048. doi : 10.1152/physrev.00030.2005 . ISSN 0031-9333 . ПМИД 16816145 .

- ^ Нагорнов Николай Н.; Ляхов Павел А.; Бергерман, Максим В.; Калита, Диана И. (2024). «Современные тенденции улучшения технических характеристик устройств и систем цифровой обработки изображений» . Доступ IEEE . 12 : 44659–44681. Бибкод : 2024IEEEA..1244659N . дои : 10.1109/ACCESS.2024.3381493 . ISSN 2169-3536 .

- ^ Ван Везель М (2020). Надежная модульная методология обучения нейронных сетей для наборов данных временных рядов: с акцентом на управление жестами (магистерская диссертация). Делфтский технологический университет.

- ^ Jump up to: Перейти обратно: а б с Маасс В. (1997). «Сети спайковых нейронов: третье поколение моделей нейронных сетей». Нейронные сети . 10 (9): 1659–1671. дои : 10.1016/S0893-6080(97)00011-7 .

- ^ Фербер, Стив (август 2016 г.). «Крупномасштабные нейроморфные вычислительные системы» . Журнал нейронной инженерии . 13 (5): 051001. Бибкод : 2016JNEng..13e1001F . дои : 10.1088/1741-2560/13/5/051001 . ISSN 1741-2552 . ПМИД 27529195 .

- ^ Нефтчи, Эмре О.; Мостафа, Хешам; Зенке, Фридеманн (2019). «Суррогатное градиентное обучение в пиковых нейронных сетях: использование возможностей градиентной оптимизации в пиковых нейронных сетях» . Журнал обработки сигналов IEEE . 36 (6): 51–63. Бибкод : 2019ISPM...36f..51N . дои : 10.1109/msp.2019.2931595 .

- ^ Саладж, Даржан; Субрамони, Ананд; Крайсникович, Чека; Беллек, Гийом; Легенштейн, Роберт; Маасс, Вольфганг (26 июля 2021 г.). О'Лири, Тимоти; Беренс, Тимоти Э; Гутьеррес, Габриель (ред.). «Адаптация пиковой частоты поддерживает сетевые вычисления на распределенной во времени информации» . электронная жизнь . 10 : е65459. doi : 10.7554/eLife.65459 . ISSN 2050-084X . ПМЦ 8313230 . ПМИД 34310281 .

- ^ Ижикевич, Э.М. (2004). «Какую модель использовать для кортикальных импульсных нейронов?» . Транзакции IEEE в нейронных сетях . 15 (5): 1063–1070. дои : 10.1109/tnn.2004.832719 . ПМИД 15484883 . S2CID 7354646 . Проверено 14 февраля 2024 г.

- ^ Адиби М., Макдональд Дж. С., Клиффорд К. В. и Арабзаде Э. Адаптация повышает эффективность нейронного кодирования, несмотря на увеличение корреляций в изменчивости. Дж. Нейроски. 33, 2108–2120 (2013)

- ^ Лафлин, С. (1981). «Простая процедура кодирования увеличивает информационную емкость нейрона» . Журнал естественных исследований C. 36 (9–10): 910–912. ISSN 0341-0382 . ПМИД 7303823 .

- ^ Керлиоз, Дэмиен; Бихлер, Оливье; Дольфус, Филипп; Гамрат, Кристиан (2013). «Иммунитет к вариациям устройств в импульсной нейронной сети с мемристивными наноустройствами» . Транзакции IEEE по нанотехнологиям . 12 (3): 288–295. Бибкод : 2013ITNan..12..288Q . дои : 10.1109/TNANO.2013.2250995 . S2CID 14416573 . Проверено 14 февраля 2024 г.

- ^ Ямадзаки, Касю; Во-Хо, Вьет-Хоа; Булсара, Даршан; Ле, Нган (июль 2022 г.). «Всплеск нейронных сетей и их применение: обзор» . Науки о мозге . 12 (7): 863. doi : 10.3390/brainsci12070863 . ISSN 2076-3425 . ПМЦ 9313413 . ПМИД 35884670 .

- ^ Шабан, Ахмед; Безугам, Саи Сукрут; Сури, Манан (9 июля 2021 г.). «Адаптивный пороговый нейрон для рекуррентных импульсных нейронных сетей с аппаратной реализацией наноустройств» . Природные коммуникации . 12 (1): 4234. Бибкод : 2021NatCo..12.4234S . дои : 10.1038/s41467-021-24427-8 . ISSN 2041-1723 . ПМК 8270926 . ПМИД 34244491 .

- ^ Беллек, Гийом; Саладж, Даржан; Субрамони, Ананд; Легенштейн, Роберт; Маасс, Вольфганг (25 декабря 2018 г.), Долговременная кратковременная память и обучение обучению в сетях импульсных нейронов , arXiv : 1803.09574

- ^ Альнаджар Ф, Мурасе К (2008). «Простая импульсная нейронная сеть, подобная аплизии, для создания адаптивного поведения автономных роботов». Адаптивное поведение . 14 (5): 306–324. дои : 10.1177/1059712308093869 . S2CID 16577867 .

- ^ Чжан X, Сюй Z, Энрикес C, Ferrari S (декабрь 2013 г.). «Непрямое обучение виртуального насекомого, управляемого нейронной сетью, на основе шипов». 52-я конференция IEEE по принятию решений и управлению . стр. 6798–6805. CiteSeerX 10.1.1.671.6351 . дои : 10.1109/CDC.2013.6760966 . ISBN 978-1-4673-5717-3 . S2CID 13992150 .

- ^ Таванаи А., Годрати М., Херадпишех С.Р., Маскелье Т., Майда А. (март 2019 г.). «Глубокое обучение в нейронных сетях». Нейронные сети . 111 : 47–63. arXiv : 1804.08150 . дои : 10.1016/j.neunet.2018.12.002 . ПМИД 30682710 . S2CID 5039751 .

- ^ Ямазаки К., Во-Хо В.К., Булсара Д., Ле Н. (июнь 2022 г.). «Всплеск нейронных сетей и их применение: обзор» . Науки о мозге . 12 (7): 863. doi : 10.3390/brainsci12070863 . ПМЦ 9313413 . ПМИД 35884670 .

- ^ Ким Ю, Пак Х, Мойтра А, Бхаттачарджи А, Венкатеша Ю, Панда П (31 января 2022 г.). «Кодирование скорости или прямое кодирование: какое из них лучше для точных, надежных и энергоэффективных пиковых нейронных сетей?». arXiv : 2202.03133 [ cs.NE ].

- ^ Эбботт Л.Ф., Нельсон С.Б. (ноябрь 2000 г.). «Синапстическая пластичность: укрощение зверя». Природная неврология . 3 (С11): 1178–1183. дои : 10.1038/81453 . ПМИД 11127835 . S2CID 2048100 .

- ^ Атия А.Ф., Парлос А.Г. (май 2000 г.). «Новые результаты по рекуррентному обучению сетей: унификация алгоритмов и ускорение сходимости». Транзакции IEEE в нейронных сетях . 11 (3): 697–709. дои : 10.1109/72.846741 . ПМИД 18249797 .

- ^ Санаулла С., Коравуна С., Рюкерт У., Юнгеблут Т. (август 2023 г.). «Оценка классификации изображений на основе всплесков нейронных сетей с использованием симулятора времени выполнения RAVSim». Международный журнал нейронных систем . 33 (9): 2350044. doi : 10.1142/S0129065723500442 . ПМИД 37604777 . S2CID 259445644 .

- ^ Саттон Р.С., Барто А.Г. (2002) Обучение с подкреплением: Введение. Bradford Books, MIT Press, Кембридж, Массачусетс.

- ^ Бойн С., Гроллиер Дж., Лесерф Г., Сюй Б., Локателли Н., Фузиль С. и др. (апрель 2017 г.). «Обучение посредством динамики сегнетоэлектрических доменов в твердотельных синапсах» . Природные коммуникации . 8 : 14736. Бибкод : 2017NatCo...814736B . дои : 10.1038/ncomms14736 . ПМЦ 5382254 . ПМИД 28368007 .

- ^ Джин Икс, Фёрбер С.Б., Вудс СП (2008). «Эффективное моделирование импульсных нейронных сетей на масштабируемом мультипроцессоре». 2008 Международная совместная конференция IEEE по нейронным сетям (Всемирный конгресс IEEE по вычислительному интеллекту) . стр. 2812–2819. дои : 10.1109/IJCNN.2008.4634194 . ISBN 978-1-4244-1820-6 . S2CID 2103654 .

- ^ «Нейроморфные вычисления» . Проект человеческого мозга .

- ^ «Аппаратное обеспечение: Доступные системы» . Проект человеческого мозга . Проверено 10 мая 2020 г.

- ^ Маркофф Дж. (8 августа 2014 г.). «Новый чип функционирует как мозг, — говорит IBM» . Нью-Йорк Таймс . п. Б1.

- ^ Понулак Ф, Касинский А (февраль 2010 г.). «Обучение с учителем в нейронных сетях с всплесками с помощью ReSuMe: обучение последовательностям, классификация и смещение всплесков». Нейронные вычисления . 22 (2): 467–510. дои : 10.1162/neco.2009.11-08-901 . ПМИД 19842989 . S2CID 12572538 .

- ^ Ньюман Д., Хеттих С., Блейк С., Мерц С. (1998). «Репозиторий UCI баз данных машинного обучения» .

- ^ Бохте С., Кок Дж.Н., Ла Путре Х. (2002). «Обратное распространение ошибок во временно закодированных сетях импульсных нейронов» . Нейрокомпьютинг . 48 (1–4): 17–37. дои : 10.1016/S0925-2312(01)00658-0 .

- ^ Пфистер Дж. П., Тойоидзуми Т., Барбер Д., Герстнер В. (июнь 2006 г.). «Оптимальная пластичность, зависящая от времени всплеска, для точного срабатывания потенциала действия при контролируемом обучении». Нейронные вычисления . 18 (6): 1318–1348. arXiv : q-bio/0502037 . Бибкод : 2005q.bio.....2037P . дои : 10.1162/neco.2006.18.6.1318 . ПМИД 16764506 . S2CID 6379045 .

- ^ Боте С.М., Ла Путре Х., Кок Дж.Н. (март 2002 г.). «Неконтролируемая кластеризация с использованием импульсных нейронов с помощью разреженного временного кодирования и многослойных сетей RBF» . Транзакции IEEE в нейронных сетях . 13 (2): 426–435. дои : 10.1109/72.991428 . ПМИД 18244443 .