Сеть глубоких убеждений

| Часть серии о |

| Машинное обучение и интеллектуальный анализ данных |

|---|

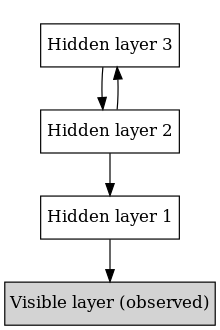

В машинном обучении сеть глубоких убеждений ( DBN ) представляет собой генеративную графическую модель или, альтернативно, класс глубокой нейронной сети , состоящей из нескольких слоев скрытых переменных («скрытых единиц») со связями между слоями, но не между единицами внутри. каждый слой. [1]

При обучении на наборе примеров без присмотра DBN может научиться вероятностно реконструировать свои входные данные. Затем слои действуют как детекторы объектов . [1] После этого этапа обучения DBN можно дополнительно обучить под наблюдением выполнению классификации . [2]

DBN можно рассматривать как совокупность простых неконтролируемых сетей, таких как ограниченные машины Больцмана (RBM). [1] или автоэнкодеры , [3] где скрытый слой каждой подсети служит видимым слоем для следующей. RBM — это ненаправленная генеративная модель, основанная на энергии, с «видимым» входным слоем и скрытым слоем, а также связями между слоями, но не внутри них. Такая композиция приводит к быстрой, послойной неконтролируемой процедуре обучения, где контрастная дивергенция применяется к каждой подсети по очереди, начиная с «самой нижней» пары слоев (самый нижний видимый слой — это обучающий набор ).

Наблюдение [2] Тот факт, что DBN можно обучать жадно , по одному уровню за раз, привел к созданию одного из первых эффективных алгоритмов глубокого обучения . [4] : 6 В целом, существует множество привлекательных реализаций и применений DBN в реальных приложениях и сценариях (например, электроэнцефалография , [5] открытие лекарств [6] [7] [8] ).

Обучение

[ редактировать ]Метод обучения RBM, предложенный Джеффри Хинтоном для использования с моделями обучения « Продукт экспертов », называется контрастивной дивергенцией (CD). [9] CD обеспечивает приближение к методу максимального правдоподобия , который в идеале можно было бы применять для изучения весов. [10] [11] При обучении одного RBM обновления веса выполняются с градиентным спуском по следующему уравнению:

где, - вероятность видимого вектора, которая определяется выражением . - функция распределения (используется для нормализации) и – энергетическая функция, присвоенная состоянию сети. Более низкая энергия указывает на то, что сеть находится в более «желательной» конфигурации. Градиент имеет простую форму где представляют собой средние значения по отношению к распределению . Проблема возникает при выборке поскольку для этого требуется расширенная попеременная выборка Гиббса . CD заменяет этот шаг, запуская попеременную выборку Гиббса для шаги (значения хорошо выступаем). После шагов, данные отбираются, и эта выборка используется вместо . Процедура CD работает следующим образом: [10]

- Инициализируйте видимые единицы обучающим вектором.

- Обновите скрытые блоки параллельно с видимыми блоками: . сигмовидная функция и это предвзятость .

- Обновите видимые модули параллельно с учетом скрытых модулей: . это предвзятость . Это называется этапом «реконструкции».

- Повторно обновите скрытые единицы параллельно с учетом реконструированных видимых единиц, используя то же уравнение, что и на шаге 2.

- Выполните обновление веса: .

После обучения RBM поверх него «накладывается» другой RBM, получающий входные данные от последнего обученного слоя. Новый видимый слой инициализируется обучающим вектором, а значения единиц в уже обученных слоях присваиваются с использованием текущих весов и смещений. Затем новый RBM обучается с помощью описанной выше процедуры. Весь этот процесс повторяется до тех пор, пока не будет достигнут желаемый критерий остановки. [12]

Хотя приближение CD к максимальному правдоподобию является грубым (не соответствует градиенту какой-либо функции), оно эмпирически эффективно. [10]

См. также

[ редактировать ]- Байесовская сеть

- Сверточная сеть глубоких убеждений

- Глубокое обучение

- Энергетическая модель

- Многоуровневая ограниченная машина Больцмана

Ссылки

[ редактировать ]- ^ Jump up to: а б с Хинтон Дж. (2009). «Сети глубоких убеждений» . Схоларпедия . 4 (5): 5947. Бибкод : 2009SchpJ...4.5947H . doi : 10.4249/scholarpedia.5947 .

- ^ Jump up to: а б Хинтон Дж.Э. , Осиндеро С., Тех Ю.В. (июль 2006 г.). «Алгоритм быстрого обучения для сетей глубокого доверия» (PDF) . Нейронные вычисления . 18 (7): 1527–54. CiteSeerX 10.1.1.76.1541 . дои : 10.1162/neco.2006.18.7.1527 . ПМИД 16764513 . S2CID 2309950 .

- ^ Бенджио Ю., Ламблин П., Поповичи Д., Ларошель Х. (2007). Жадное послойное обучение глубоких сетей (PDF) . НИПС .

- ^ Бенджио, Ю. (2009). «Изучение глубокой архитектуры для искусственного интеллекта» (PDF) . Основы и тенденции в машинном обучении . 2 : 1–127. CiteSeerX 10.1.1.701.9550 . дои : 10.1561/2200000006 .

- ^ Мовахеди Ф., Койл Дж.Л., Сейдич Э. (май 2018 г.). «Сети глубоких убеждений для электроэнцефалографии: обзор недавних вкладов и перспектив на будущее» . Журнал IEEE по биомедицинской и медицинской информатике . 22 (3): 642–652. дои : 10.1109/jbhi.2017.2727218 . ПМЦ 5967386 . ПМИД 28715343 .

- ^ Гасеми, Перес-Санчес; Мехри, Перес-Гарридо (2018). «Нейронные сети и алгоритмы глубокого обучения, используемые в исследованиях QSAR: достоинства и недостатки». Открытие наркотиков сегодня . 23 (10): 1784–1790. дои : 10.1016/j.drudis.2018.06.016 . ПМИД 29936244 . S2CID 49418479 .

- ^ Гасеми, Перес-Санчес; Мехри, Фассихи (2016). «Роль различных методов отбора проб в улучшении прогнозирования биологической активности с использованием сети глубокого убеждения». Журнал вычислительной химии . 38 (10): 1–8. дои : 10.1002/jcc.24671 . ПМИД 27862046 . S2CID 12077015 .

- ^ Гавен Э., Хисс Дж.А., Шнайдер Г. (январь 2016 г.). «Глубокое обучение в открытии лекарств» . Молекулярная информатика . 35 (1): 3–14. дои : 10.1002/минф.201501008 . ПМИД 27491648 . S2CID 10574953 .

- ^ Хинтон Дж. Э. (2002). «Продукт обучения экспертов путем минимизации контрастного расхождения» (PDF) . Нейронные вычисления . 14 (8): 1771–1800. CiteSeerX 10.1.1.35.8613 . дои : 10.1162/089976602760128018 . ПМИД 12180402 . S2CID 207596505 .

- ^ Jump up to: а б с Хинтон Дж. Э. (2010). «Практическое руководство по обучению ограниченных машин Больцмана» . Тех. Реп. УТМЛ ТР 2010-003 .

- ^ Фишер А., Игель С. (2014). «Обучение ограниченных машин Больцмана: введение» (PDF) . Распознавание образов . 47 (1): 25–39. Бибкод : 2014PatRe..47...25F . CiteSeerX 10.1.1.716.8647 . дои : 10.1016/j.patcog.2013.05.025 . Архивировано из оригинала (PDF) 10 июня 2015 г. Проверено 2 июля 2017 г.

- ^ Бенджио Ю. (2009). «Изучение глубокой архитектуры для искусственного интеллекта» (PDF) . Основы и тенденции в машинном обучении . 2 (1): 1–127. CiteSeerX 10.1.1.701.9550 . дои : 10.1561/2200000006 . Архивировано из оригинала (PDF) 4 марта 2016 г. Проверено 2 июля 2017 г.

Внешние ссылки

[ редактировать ]- «Сети глубоких убеждений» . Учебники по глубокому обучению.

- «Пример сети глубоких убеждений» . Учебники по Deeplearning4j. Архивировано из оригинала 3 октября 2016 г. Проверено 22 февраля 2015 г.