Внимание (машинное обучение)

| Часть серии о |

| Машинное обучение и интеллектуальный анализ данных |

|---|

машинном обучении, , основанный на Метод внимания имитирует работу человеческого внимания , присваивая различные уровни важности различным компонентам последовательности. При обработке естественного языка это обычно означает присвоение разных уровней важности разным словам в предложении. Он присваивает важность каждому слову путем расчета «мягких» весов для числового представления слова, известного как его встраивание , в определенный раздел предложения, называемый контекстным окном, для определения его важности. Вычисление этих весов может происходить одновременно в моделях, называемых трансформаторами , или по одному в моделях, известных как рекуррентные нейронные сети . В отличие от «жестких» весов, которые заранее определяются и фиксируются во время тренировки, «мягкие» веса могут адаптироваться и меняться при каждом использовании модели.

Внимание было обращено на устранение недостатков использования информации из скрытых слоев рекуррентных нейронных сетей. Рекуррентные нейронные сети отдают предпочтение более свежей информации, содержащейся в словах в конце предложения, тогда как информация в начале предложения имеет тенденцию к ослаблению . Внимание позволяет вычислить скрытое представление токена, равное доступу к любой части предложения напрямую, а не только через предыдущее скрытое состояние.

Ранее этот механизм привязывался к системе языкового перевода последовательной рекуррентной нейронной сети преобразователей (ниже), но позднее использование в больших языковых моделях удалило рекуррентную нейронную сеть и в значительной степени полагалось на более быструю схему параллельного внимания.

История

[ редактировать ]Предшественники

[ редактировать ]человека Избирательное внимание изучалось в нейробиологии и когнитивной психологии. [3]

Избирательное внимание на прослушивании изучалось в эффекте коктейльной вечеринки ( Колин Черри , 1953). [4] . ( Дональд Бродбент , 1958) предложил модель фильтра внимания . [5] Избирательное зрительное внимание изучалось в 1960-х годах с помощью Джорджа Сперлинга парадигмы частичного отчета . Было также замечено, что контроль саккад модулируется когнитивными процессами, поскольку глаз преимущественно движется к областям высокой значимости . Поскольку ямка глаза мала, глаз не может четко различить все поле зрения одновременно. Использование саккадного контроля позволяет глазу быстро сканировать важные детали сцены. [6]

Эти исследования вдохновили на создание алгоритмов, таких как вариант неокогнитрона . [7] [8] И наоборот, развитие нейронных сетей вдохновило на создание схем биологического зрительного внимания. [9] [2] Например, одна широко цитируемая сеть 1998 года была вдохновлена низкоуровневой зрительной системой приматов и создавала карты значимости изображений с использованием созданных вручную (не изученных) функций, которые затем использовались для управления другой нейронной сетью для обработки фрагментов данных. изображения в порядке убывания значимости. [10]

Ключевой аспект механизма внимания можно записать (схематически) как где угловые скобки обозначают скалярное произведение. Это показывает, что речь идет о мультипликативной операции. Мультипликативные операции в нейронных сетях изучались под названием нейронных сетей более высокого порядка . [11] блоки умножения , [12] единицы сигма-пи , [13] быстрые весовые контроллеры , [14] и гиперсети . [15]

Периодическое внимание

[ редактировать ]В эпоху глубокого обучения был разработан механизм внимания, решающий аналогичные проблемы кодирования-декодирования. [1]

В машинном переводе модель seq2seq , предложенная в 2014 году, [16] будет кодировать входной текст в вектор фиксированной длины, который затем будет декодирован в выходной текст. Если входной текст длинный, вектор фиксированной длины не сможет нести достаточно информации для точного декодирования. Для решения этой проблемы был предложен механизм внимания.

Модель подписей к изображениям была предложена в 2015 году, вдохновленная моделью seq2seq. [17] который будет кодировать входное изображение в вектор фиксированной длины. (Сюй и др., 2015 г.), [18] цитируя (Бахданау и др. 2014) [19] , применил механизм внимания, используемый в модели seq2seq, к подписям к изображениям.

Трансформатор

[ редактировать ]Одной из проблем с моделями seq2seq было использование рекуррентных нейронных сетей, которые не поддаются распараллеливанию, поскольку и кодер, и декодер обрабатывают последовательность токен за токеном. Разложимое внимание [20] попытались решить эту проблему путем параллельной обработки входной последовательности перед вычислением «матрицы мягкого выравнивания» («выравнивание» - это терминология, используемая (Bahdanau et al 2014) [19] ). Это позволило осуществлять параллельную обработку.

В этот период также была предложена идея использования механизма внимания для самовнимания вместо кодера-декодера (перекрестное внимание), например, в дифференцируемых нейронных компьютерах. [21] и нейронные машины Тьюринга [22] . Это называлось внутренним вниманием. [23] где LSTM дополняется сетью памяти, поскольку она кодирует входную последовательность.

Эти направления разработки были объединены в архитектуре Transformer, опубликованной в книге «Внимание — это все, что вам нужно » (2017). В дальнейшем механизмы внимания были расширены в рамках архитектуры Transformer, которая описана там .

Внимание к точечному произведению

[ редактировать ]Внимание точечного произведения, популяризированное архитектурой Transformer, является наиболее широко используемым механизмом внимания. Его можно построить путем добавления механизмов помодульно.

Для чистоты обозначений все векторы являются векторами-строками .

машинный перевод seq2seq

[ редактировать ]

Рассмотрим задачу перевода языка seq2seq с английского на французский. Чтобы быть более конкретным, давайте рассмотрим перевод «зона международного контроля <конец>», который следует перевести как «зона международного контроля <конец>». Здесь мы используем специальный токен <end> в качестве управляющего символа , чтобы разграничить конец ввода как для кодера, так и для декодера.

Входная последовательность текста обрабатывается нейронной сетью (которая может быть LSTM, кодировщиком Transformer или какой-либо другой сетью) в последовательность векторов с действительным знаком , где означает «скрытый вектор».

После того, как кодер завершил обработку, декодер начинает работать со скрытыми векторами, чтобы создать выходную последовательность. , авторегрессионно. То есть, для создания следующего выходного слова он всегда принимает на вход как скрытые векторы, созданные кодером, так и то, что сам декодер создал ранее:

- ( , "<начало>") → "ла"

- ( , "<start> la") → "la Zone"

- ( , «<start> зона») → «зона де»

- ...

- ( , «<начало> зона международного контроля») → «зона международного контроля <конец>»

Здесь мы используем специальный токен <start> в качестве управляющего символа , чтобы ограничить начало ввода для декодера. Декодирование завершается, как только на выходе декодера появляется «<конец>».

Выравнивание

[ редактировать ]

Идея механизма внимания заключается в том, что если у кого-то ограниченная вычислительная мощность, например у человека, смотрящего на изображение, или у декодера, декодирующего текст, он должен потратить ее на ту часть, где это важно. Эта идея, примененная к машинному переводу seq2seq, реализована в механизме перекрестного внимания.

Для начала рассмотрим, как декодер может перевести слово «ла», если оно задано ( , «<начало>»). Поскольку слово «ла» является прямым переводом английского слова «the», декодер должен «сосредоточить свое внимание» на векторе. , с возможностью отвлечения небольшого внимания на другие векторы. Итак, схематически мы можем построить «вектор контекста» полученный взвешенной суммой скрытых векторов: где мы могли бы, например, вручную изготовить гири . Эти веса называются весами внимания .

Его также называют «выравниванием» — термин, пришедший из задачи обработки естественного языка «выравнивание слов», которая обозначает процесс идентификации и выравнивания слов или фраз на одном языке, которые эквивалентны по значению словам или фразам на другом языке. , обычно в параллельном корпусе переведенных текстов. Предыдущим уровнем техники были модели выравнивания IBM . Термин «выравнивание» использовался в (Бахданау и др., 2014). [19] бумага. Например, для «зона международного контроля <конец>» → «зона международного контроля <конец>» у нас должны быть следующие выравнивания:

- "то" - "ля"

- «зона» — «зона»

- ...

Выравнивание не является тривиальным, поскольку в разных языках порядок слов разный. В этом примере «международный контроль» инвертируется в «международный контроль». В качестве другого примера рассмотрим «Я люблю тебя <конец>» → «je t' aime <конец>», что мы можем схематически записать в виде следующей матрицы весов внимания:

| я | любовь | ты | |

| является | 0.94 | 0.02 | 0.04 |

| т' | 0.11 | 0.01 | 0.88 |

| любовь | 0.03 | 0.95 | 0.02 |

Здесь «цель» соответствует «любви», но порядок инвертируется. Это визуально ясно, поскольку черная диагональная линия из верхнего левого угла в нижний правый меняет направление и идет от правого верхнего угла к левому нижнему. Иногда выравнивание может быть множественным. Например, английская фраза «посмотри» соответствует «черчез-ле». Таким образом, «мягкие» веса внимания работают лучше, чем «жесткие» веса внимания (устанавливая один вес внимания равным 1, а остальным — 0), поскольку мы хотим, чтобы модель создавала вектор контекста, состоящий из взвешенной суммы скрытых векторов. , а не «самый лучший», поскольку не существует единственного лучшего скрытого вектора, который можно было бы использовать.

Внимание

[ редактировать ]

Поскольку создание весов вручную противоречит целям машинного обучения, модель должна вычислять веса внимания самостоятельно. Принимая аналогию с языком запросов к базе данных , мы заставляем модель строить тройку векторов: ключ, запрос и значение. Грубая идея состоит в том, что у нас есть «база данных» в виде списка пар ключ-значение. Декодер отправляет запрос и получает ответ в виде взвешенной суммы значений , где вес пропорционален тому, насколько близко запрос похож на каждый ключ .

Декодер сначала частично обрабатывает ввод «<start>», чтобы получить промежуточный вектор. , 0-й скрытый вектор декодера. Затем промежуточный вектор преобразуется линейным отображением в запроса вектор . Тем временем скрытые векторы, выдаваемые кодировщиком, преобразуются с помощью другой линейной карты. на ключевые векторы . Линейные карты полезны для предоставления модели достаточной свободы для поиска наилучшего способа представления данных.

Теперь запрос и ключи сравниваются путем скалярного произведения: . В идеале модель должна была научиться вычислять ключи и значения так, чтобы большой, мал, а остальные очень малы. Это можно интерпретировать как утверждение, что вес внимания должен в основном применяться к 0-му скрытому вектору кодера, немного к 1-му и, по существу, ни к одному из остальных.

Чтобы получить правильно взвешенную сумму, нам нужно преобразовать этот список скалярных произведений в распределение вероятностей по . Этого можно добиться с помощью функции softmax , что дает нам веса внимания: Затем это используется для вычисления вектора контекста : где — это векторы значений , линейно преобразованные с помощью другой матрицы, чтобы предоставить модели свободу поиска наилучшего способа представления значений. Без матриц , модель будет вынуждена использовать один и тот же скрытый вектор как для ключа, так и для значения, что может быть нецелесообразно, поскольку эти две задачи не совпадают.

Это механизм точечного внимания. Конкретная версия, описанная в этом разделе, представляет собой «перекрестное внимание декодера», поскольку выходной вектор контекста используется декодером, а входные ключи и значения поступают от кодера, но запрос поступает от декодера, таким образом, «перекрестное внимание» ".

Более кратко мы можем записать это как где матрица матрица, строки которой .

Многонаправленное внимание

[ редактировать ]

Перекрестное внимание декодера может стать «многоголовым», если весовых матриц несколько. и мы вычисляем один вектор контекста для каждой тройки весовой матрицы: затем объедините их и примените еще одно линейное преобразование, чтобы получить окончательный вектор контекста: Многонаправленное внимание

Внимание к себе

[ редактировать ]

Само-внимание, по сути, то же самое, что и перекрестное внимание, за исключением того, что векторы запроса, ключа и значения происходят из одной и той же модели. И кодер, и декодер могут использовать самовнимание, но с небольшими различиями.Что касается самоконтроля кодировщика, мы можем начать с простого кодировщика без самоконтроля, такого как «слой внедрения», который просто преобразует каждое входное слово в вектор с помощью фиксированной таблицы поиска . Это дает последовательность скрытых векторов . Затем их можно применить к механизму внимания скалярного произведения, чтобы получить или более кратко, . Это можно применять неоднократно, чтобы получить многоуровневый кодер. Это «само-внимание кодировщика», иногда называемое «всем вниманием», поскольку вектор в каждой позиции может уделять внимание каждому другому.

Для самовнимания декодера внимание «всем ко всем» не подходит, поскольку во время процесса авторегрессионного декодирования декодер не может обрабатывать будущие выходные данные, которые еще предстоит декодировать. Эту проблему можно решить, заставив веса внимания для всех , называемая «причинной маскировкой». Этот механизм внимания представляет собой «каузально замаскированное внимание к себе».

Основные расчеты

[ редактировать ]Сеть внимания была разработана для выявления наиболее высоких корреляций между словами в предложении, при условии, что она усвоила эти шаблоны из обучающего корпуса. Эта корреляция фиксируется в весах нейронов посредством обратного распространения ошибки либо в результате предварительной тренировки с самоконтролем , либо в результате контролируемой точной настройки.

В приведенном ниже примере (вариант сети внимания QKV только для кодировщика) показано, как корреляции идентифицируются после того, как сеть обучена и имеет правильные веса. Глядя на слово «это» в предложении «вижу, как бежит девушка», сеть должна быть в состоянии идентифицировать «девушку» как сильно коррелированное слово. Для простоты в этом примере основное внимание уделяется слову «это», но на самом деле все слова обрабатываются параллельно, а полученные мягкие веса и векторы контекста складываются в матрицы для дальнейшего использования в конкретной задаче.

Предложение отправляется через 3 параллельных потока (слева), которые в конце появляются как вектор контекста (справа). Размер встраивания слова составляет 300, а количество нейронов — 100 в каждой подсети головы внимания.

- Заглавная буква X обозначает матрицу размером 4×300, состоящую из вложений всех четырех слов.

- Маленькая подчеркнутая буква x обозначает вектор внедрения (размером 300) слова «это».

- подсети, каждая из которых имеет 100 нейронов, имеющих Wq Голова внимания включает в себя три (расположенные вертикально на рисунке ) , Wk Wv и . 100 соответствующие весовые матрицы, все они имеют размер 300 ×

- q (от «запрос») — вектор размером 100, K («ключ») и V («значение») — матрицы 4x100.

- Звездочка в скобках « (*) » обозначает softmax( qW k / √ 100 ) . Результатом Softmax является вектор размером 4, который позже умножается на матрицу V=XW v для получения вектора контекста.

- Изменение масштаба на √ 100 предотвращает высокую дисперсию qW k. Т это позволило бы одному слову чрезмерно доминировать в мягком максимуме, что привело бы к вниманию только к одному слову, как это сделал бы дискретный жесткий максимум.

Обозначение для строк, : широко написанная формула softmax приведенная выше, предполагает, что векторы являются строками, что противоречит стандартным математическим обозначениям векторов-столбцов. Точнее, нам следует взять транспонирование вектора контекста и использовать softmax по столбцам , что приведет к более правильной форме.

запроса Вектор сравнивается (через скалярное произведение) с каждым словом в ключах. Это помогает модели обнаружить наиболее подходящее слово для слова запроса. В данном случае слово «девушка» было определено как наиболее подходящее слово для слова «это». Результат (в данном случае размер 4) обрабатывается функцией softmax , создавая вектор размера 4 с суммой вероятностей, равной 1. Умножение этого значения на матрицу значений эффективно усиливает сигнал для наиболее важных слов в предложении и уменьшает сигнал. для менее важных слов. [24]

Структура входных данных фиксируется весами W q и W k , а веса W v выражают эту структуру с точки зрения более значимых функций для задачи, для которой проводится обучение. По этой причине компоненты «головы внимания» называются «Запрос» ( W q ), «Ключ» ( W k ) и «Значение» ( W v ) — это расплывчатая и, возможно, вводящая в заблуждение аналогия с системами реляционных баз данных .

Обратите внимание, что вектор контекста для слова «это» не зависит от векторов контекста для других слов; поэтому векторы контекста всех слов можно вычислить с использованием всей матрицы X , которая включает в себя все вложения слов, вместо вектора встраивания одного слова x в приведенной выше формуле, что позволяет распараллелить вычисления. Теперь softmax можно интерпретировать как softmax матрицы, действующей на отдельные строки. Это огромное преимущество перед рекуррентными сетями , которые должны работать последовательно.

Общая аналогия ключа запроса с запросами к базе данных предполагает асимметричную роль этих векторов, когда один интересующий элемент (запрос) сопоставляется со всеми возможными элементами (ключами). Однако параллельные вычисления сопоставляют все слова предложения сами с собой; поэтому роли этих векторов симметричны. Возможно, из-за того, что упрощенная аналогия с базой данных ошибочна, много усилий было потрачено на дальнейшее понимание внимания путем изучения его роли в целенаправленных условиях, таких как контекстное обучение, [25] языковые задания в масках, [26] разобранные трансформаторы, [27] статистика биграмм, [28] парные свертки, [29] и арифметический факторинг. [30]

Пример языкового перевода

[ редактировать ]Чтобы построить машину, которая переводит с английского на французский, к базовому кодировщику-декодеру прикрепляют блок внимания (схема ниже). В простейшем случае единица внимания состоит из скалярных произведений рекуррентных состояний кодера и не нуждается в обучении. На практике блок внимания состоит из трех обученных, полностью связанных слоев нейронной сети, называемых запросом, ключом и значением.

![Кодер-декодер с вниманием.[31] Левая часть (черные линии) — это кодер-декодер, средняя часть (оранжевые линии) — единица внимания, а правая часть (серый и цветной) — вычисляемые данные. Серые области в матрице H и векторе w имеют нулевые значения. Числовые индексы указывают размеры векторов, а буквенные индексы i и i - 1 указывают временные шаги.](http://upload.wikimedia.org/wikipedia/commons/f/f7/Attention-1-sn.png)

Если рассматривать их в виде матрицы, веса внимания показывают, как сеть корректирует свой фокус в зависимости от контекста. [33]

| я | любовь | ты | |

| является | 0.94 | 0.02 | 0.04 |

| т' | 0.11 | 0.01 | 0.88 |

| любовь | 0.03 | 0.95 | 0.02 |

Этот взгляд на веса внимания решает проблему « объяснимости » нейронной сети. Сети, выполняющие дословный перевод без учета порядка слов, покажут самые высокие баллы по (доминирующей) диагонали матрицы. Недиагональное доминирование показывает, что механизм внимания более тонкий. При первом проходе через декодер 94% веса внимания приходится на первое английское слово «I», поэтому сеть предлагает слово «je». На втором проходе декодера 88% внимания приходится на третье английское слово «you», поэтому оно предлагает «t». На последнем проходе 95% внимания приходится на второе английское слово «love», поэтому оно предлагает «aime».

Варианты

[ редактировать ]Многие варианты внимания реализуют мягкие веса, такие как

- быстрые программисты веса или быстрые контролеры веса (1992) [14] . «Медленная» нейронная сеть выводит «быстрые» веса другой нейронной сети через внешние продукты . Медленная сеть обучается по градиентному спуску. Позже оно было переименовано в «линеаризованное самовнимание». [34] .

- По-Богданову будь осторожен, [33] также называемое аддитивным вниманием ,

- Внимание в стиле Луонг, [35] которое известно как мультипликативное внимание ,

- высокораспараллеливаемое внимание к себе, представленное в 2016 году как разлагаемое внимание [23] успешно использовался в трансформаторах , и год спустя

- позиционное внимание и факторизованное позиционное внимание . [36]

Для сверточных нейронных сетей механизмы внимания можно различать по измерению, в котором они работают, а именно: пространственное внимание, [37] канал внимания, [38] или комбинации. [39] [40]

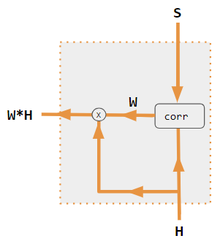

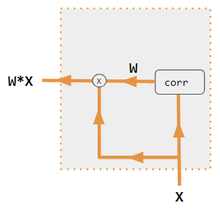

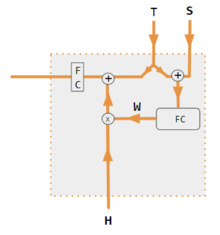

Эти варианты рекомбинируют входные данные на стороне кодера для перераспределения этих эффектов на каждый целевой выход. Часто матрица скалярных произведений в стиле корреляции обеспечивает коэффициенты повторного взвешивания. На рисунках ниже W — это матрица весов контекстного внимания, аналогичная формуле, приведенной в разделе «Основные расчеты» выше.

| 1. скалярное произведение кодер-декодер | 2. кодер-декодер QKV | 3. скалярное произведение только для кодировщика | 4. QKV только для энкодера | 5. Учебное пособие по Pytorch |

|---|---|---|---|---|

|  |  |  |  |

Математическое представление

[ редактировать ]Внимание к стандартному масштабированному скалярному произведению

[ редактировать ]где — это матрицы запроса, ключа и значения, это размер клавиш. Векторы значений в матрице взвешиваются с использованием весов, полученных в результате операции softmax.

Многоголовое внимание

[ редактировать ]где каждая головка рассчитывается как: и , и являются матрицами параметров.

Богданау (Присадка) Внимание

[ редактировать ]где и и являются обучаемыми весовыми матрицами. [33]

Луонг Внимание (Общее)

[ редактировать ]где это обучаемая весовая матрица. [35]

См. также

[ редактировать ]Ссылки

[ редактировать ]- ^ Jump up to: а б Ню, Чжаоян; Чжун, Гоцян; Ю, Хуэй (10 сентября 2021 г.). «Обзор механизма внимания глубокого обучения» . Нейрокомпьютинг . 452 : 48–62. doi : 10.1016/j.neucom.2021.03.091 . ISSN 0925-2312 .

- ^ Jump up to: а б Сойданер, Дерья (август 2022 г.). «Механизм внимания в нейронных сетях: куда оно приходит и куда уходит» . Нейронные вычисления и их приложения . 34 (16): 13371–13385. дои : 10.1007/s00521-022-07366-3 . ISSN 0941-0643 .

- ^ Крамер, Артур Ф.; Вигманн, Дуглас А.; Кирлик, Алекс (28 декабря 2006 г.). «1 Внимание: от истории к применению». Внимание: От теории к практике . Издательство Оксфордского университета. doi : 10.1093/acprof:oso/9780195305722.003.0001 . ISBN 978-0-19-530572-2 .

- ^ Вишня ЕС (1953). «Некоторые эксперименты по распознаванию речи одним и двумя ушами» (PDF) . Журнал Акустического общества Америки . 25 (5): 975–79. Бибкод : 1953ASAJ...25..975C . дои : 10.1121/1.1907229 . hdl : 11858/00-001M-0000-002A-F750-3 . ISSN 0001-4966 .

- ^ Бродбент, Д. (1958). Восприятие и общение . Лондон: Пергамон Пресс.

- ^ Коулер, Эйлин; Андерсон, Эрик; Дошер, Барбара; Блазер, Эрик (1 июля 1995 г.). «Роль внимания в программировании саккад» . Исследование зрения . 35 (13): 1897–1916. дои : 10.1016/0042-6989(94)00279-У . ISSN 0042-6989 .

- ^ Фукусима, Кунихико (1 декабря 1987 г.). «Нейросетевая модель избирательного внимания при распознавании визуальных образов и ассоциативном запоминании» . Прикладная оптика . 26 (23): 4985. doi : 10.1364/AO.26.004985 . ISSN 0003-6935 .

- ^ Ба, Джимми; Мних, Владимир; Кавукчуоглу, Корай (23 апреля 2015 г.), Распознавание нескольких объектов с помощью зрительного внимания , doi : 10.48550/arXiv.1412.7755 , получено 6 августа 2024 г.

- ^ Кох, Кристоф; Ульман, Шимон (1987), Вайна, Люсия М. (редактор), «Сдвиги в избирательном визуальном внимании: к основным нейронным схемам» , Вопросы интеллекта: концептуальные структуры в когнитивной нейронауке , Дордрехт: Springer Нидерланды, стр. 115– 141, номер домена : 10.1007/978-94-009-3833-5_5 , ISBN 978-94-009-3833-5 , получено 6 августа 2024 г.

- ^ Итти, Л.; Кох, К.; Нибур, Э. (ноябрь 1998 г.). «Модель визуального внимания на основе значимости для быстрого анализа сцены» . Транзакции IEEE по анализу шаблонов и машинному интеллекту . 20 (11): 1254–1259. дои : 10.1109/34.730558 .

- ^ Джайлз, К. Ли; Максвелл, Том (1 декабря 1987 г.). «Обучение, инвариантность и обобщение в нейронных сетях высокого порядка» . Прикладная оптика . 26 (23): 4972. doi : 10.1364/AO.26.004972 . ISSN 0003-6935 .

- ^ Фельдман, Дж. А.; Баллард, Д.Х. (1 июля 1982 г.). «Коннекционистские модели и их свойства» . Когнитивная наука . 6 (3): 205–254. дои : 10.1016/S0364-0213(82)80001-3 . ISSN 0364-0213 .

- ^ Румельхарт, Дэвид Э.; Макклелланд, Джеймс Л.; Группа, PDP Research (29 июля 1987 г.). Параллельная распределенная обработка, Том 1: Исследования микроструктуры познания: Основы, Глава 2 (PDF) . Кембридж, Массачусетс: Bradford Books. ISBN 978-0-262-68053-0 .

- ^ Jump up to: а б Шмидхубер, Юрген (1992). «Научимся контролировать быстрые воспоминания: альтернатива повторяющимся сетям». Нейронные вычисления . 4 (1): 131–139. дои : 10.1162/neco.1992.4.1.131 . S2CID 16683347 .

- ^ Ха, Дэвид; Нет, Эндрю; Ле, Куок В. (01 декабря 2016 г.), HyperNetworks , номер документа : 10.48550/arXiv.1609.09106 , получено 6 августа 2024 г.

- ^ Суцкевер, Илья; Виньялс, Ориол; Ле, Куок Вьет (2014). «Последовательное обучение с помощью нейронных сетей». arXiv : 1409.3215 [ cs.CL ].

- ^ Виньялс, Ориол; Тошев, Александр; Бенджио, Сами; Эрхан, Дмитрий (2015). «Покажи и расскажи: нейронный генератор подписей к изображениям» . стр. 3156–3164.

- ^ Сюй, Кельвин; Ба, Джимми; Кирос, Райан; Чо, Кёнхён; Курвиль, Аарон; Салахудинов Руслан; Земель, Рич; Бенджио, Йошуа (01 июня 2015 г.). «Покажи, присутствуй и расскажи: создание подписей к изображениям с помощью нейронных сетей с помощью визуального внимания» . Материалы 32-й Международной конференции по машинному обучению . ПМЛР: 2048–2057.

- ^ Jump up to: а б с Богданов Дмитрий; Чо, Кёнхён; Бенджио, Йошуа (19 мая 2016 г.) [первая версия на arXiv вышла 1 сентября 2014 г.], Нейронный машинный перевод от Jointly Learning to Align and Translate , doi : 10.48550/arXiv.1409.0473 , получено 5 августа 2024 г.

- ^ Парих, Анкур; Тэкстрем, Оскар; Дас, Дипанджан; Ушкорейт, Якоб (2016). «Разложимая модель внимания для вывода на естественном языке» . Материалы конференции 2016 года по эмпирическим методам обработки естественного языка . Страудсбург, Пенсильвания, США: Ассоциация компьютерной лингвистики. дои : 10.18653/v1/d16-1244 .

- ^ Грейвс, Алекс; Уэйн, Грег; Рейнольдс, Малькольм; Харли, Тим; Данигелька, Иво; Грабская-Барвинская, Агнешка; Кольменарехо, Серхио Гомес; Грефенштетт, Эдвард; Рамальо, Тьяго; Агапиу, Джон; Бадия, Адриа Пучдоменек; Герман, Карл Мориц; Зволс, Йори; Островский, Георг; Каин, Адам; Король, Хелен; Саммерфилд, Кристофер; Блансом, Фил; Кавукчуоглу, Корай; Хассабис, Демис (12 октября 2016 г.). «Гибридные вычисления с использованием нейронной сети с динамической внешней памятью» . Природа . 538 (7626): 471–476. Бибкод : 2016Natur.538..471G . дои : 10.1038/nature20101 . ISSN 1476-4687 . ПМИД 27732574 . S2CID 205251479 .

- ^ Грейвс, Алекс; Уэйн, Грег; Данихелька, Иво (10 декабря 2014 г.), Neural Turing Machines , doi : 10.48550/arXiv.1410.5401 , получено 6 августа 2024 г.

- ^ Jump up to: а б Ченг, Цзяньпэн; Донг, Ли; Лапата, Мирелла (20 сентября 2016 г.), Сети краткосрочной памяти для машинного чтения , номер документа : 10.48550/arXiv.1601.06733 , получено 6 августа 2024 г.

- ^ Свани, Ашиш ; Шазир, Ноам; Пармар, Ник; Ушкорейт, Джейкоб; Джонс, Лион; Гомес, Эйдан Н ; Кайзер, Лукаш; Полосухин, Илья (2017). «Внимание — это все, что вам нужно» (PDF ) Достижения в области нейронных систем обработки информации . 30 . Карран Ассошиэйтс, Инк.

- ^ Чжан, Жуйци (2024). «Обученные трансформаторы изучают линейные модели в контексте» (PDF) . Журнал исследований машинного обучения 1-55 . 25 . arXiv : 2306.09927 .

- ^ Ренде, Риккардо (2024). «Сопоставление механизмов внимания с обобщенной моделью Поттса». Обзор физических исследований . 6 (2): 023057. arXiv : 2304.07235 . Бибкод : 2024PhRvR...6b3057R . doi : 10.1103/PhysRevResearch.6.023057 .

- ^ Он, Бобби (2023). «Упрощение блоков-трансформеров». arXiv : 2311.01906 [ cs.LG ].

- ^ «Трансформаторные схемы» . Transformer-circuits.pub .

- ^ Нейронная сеть-трансформер, созданная с нуля . 2023 год. Событие происходит в 05:30 . Проверено 7 апреля 2024 г.

- ^ Чартон, Франсуа (2023). «Изучение наибольшего общего делителя: объяснение предсказаний трансформатора». arXiv : 2308.15594 [ cs.LG ].

- ^ Бритц, Денни; Голди, Анна; Луонг, Минь-Тхань; Ле, Куок (21 марта 2017 г.). «Массовое исследование архитектур нейронного машинного перевода». arXiv : 1703.03906 [ cs.CV ].

- ^ «Учебное пособие по seq2seq на Pytorch.org» . Проверено 2 декабря 2021 г.

- ^ Jump up to: а б с Богданов Дмитрий; Чо, Кёнхён; Бенджио, Йошуа (2014). «Нейронный машинный перевод путем совместного обучения выравниванию и переводу». arXiv : 1409.0473 [ cs.CL ].

- ^ Шлаг, Иманол ; Ириэ, Казуки; Шмидхубер, Юрген (2021). «Линейные трансформаторы — тайно быстрые программисты веса». ICML 2021 . Спрингер. стр. 9355–9366.

- ^ Jump up to: а б с Луонг, Минь-Тхан (20 сентября 2015 г.). «Эффективные подходы к нейронному машинному переводу, основанному на внимании». arXiv : 1508.04025v5 [ cs.CL ].

- ^ «Обучение позиционному вниманию для последовательных рекомендаций» . catalyzex.com .

- ^ Чжу, Сичжоу; Ченг, Дажи; Чжан, Чжэн; Лин, Стивен; Дай, Цзифэн (2019). «Эмпирическое исследование механизмов пространственного внимания в глубоких сетях» . Международная конференция IEEE/CVF по компьютерному зрению (ICCV) 2019 . стр. 6687–6696. arXiv : 1904.05873 . дои : 10.1109/ICCV.2019.00679 . ISBN 978-1-7281-4803-8 . S2CID 118673006 .

- ^ Ху, Цзе; Шен, Ли; Солнце, Банда (2018). «Сети сжатия и возбуждения» . Конференция IEEE/CVF 2018 по компьютерному зрению и распознаванию образов . стр. 7132–7141. arXiv : 1709.01507 . дои : 10.1109/CVPR.2018.00745 . ISBN 978-1-5386-6420-9 . S2CID 206597034 .

- ^ Уу, Санхён; Пак, Чончан; Ли, Джун-Ён; Квеон, Ин Со (18 июля 2018 г.). «CBAM: Модуль внимания сверточного блока». arXiv : 1807.06521 [ cs.CV ].

- ^ Георгеску, Мариана-Юлиана; Ионеску, Раду Тудор; Мирон, Андреа-Юлиана; Савенку, Оливиан; Ристеа, Николае-Каталин; Верга, Николае; Хан, Фахад Шахбаз (12 октября 2022 г.). «Мультимодальное многоголовое сверточное внимание с различными размерами ядра для сверхразрешения медицинских изображений». arXiv : 2204.04218 [ eess.IV ].

- ^ Нил Роудс (2021). CS 152 NN-27: Внимание: ключи, запросы и значения . Событие происходит в 06:30 . Проверено 22 декабря 2021 г.

- ^ Альфредо Канциани и Янн Лекун (2021). Курс глубокого обучения Нью-Йоркского университета, весна 2020 г. Событие происходит в 05:30 . Проверено 22 декабря 2021 г.

- ^ Альфредо Канциани и Янн Лекун (2021). Курс глубокого обучения Нью-Йоркского университета, весна 2020 г. Событие происходит в 20:15 . Проверено 22 декабря 2021 г.

- ^ Робертсон, Шон. «НЛП с нуля: перевод с помощью сети последовательностей и внимания» . pytorch.org . Проверено 22 декабря 2021 г.

Внешние ссылки

[ редактировать ]- Дэн Джурафски и Джеймс Х. Мартин (2022 г.) Обработка речи и языка (проект 3-го изд., январь 2022 г.) , гл. 10.4 Внимание и гл. 9.7 Сети самообслуживания: преобразователи

- Алекс Грейвс (4 мая 2020 г.), Внимание и память в глубоком обучении (видеолекция), DeepMind / UCL , через YouTube