Влияние искусственного интеллекта на рабочее место

Влияние искусственного интеллекта на работников включает в себя как приложения для повышения безопасности и здоровья работников , так и потенциальные опасности , которые необходимо контролировать.

Одним из потенциальных применений является использование искусственного интеллекта для устранения опасностей путем вывода людей из опасных ситуаций, связанных с риском стресса , переутомления или травм опорно-двигательного аппарата . Прогнозная аналитика также может использоваться для выявления условий, которые могут привести к таким опасностям, как усталость , травмы от повторяющихся перенапряжений или воздействие токсичных веществ , что приводит к более раннему вмешательству. Другой вариант — оптимизировать рабочие процессы в области безопасности и гигиены труда за счет автоматизации повторяющихся задач, улучшения программ обучения технике безопасности с помощью виртуальной реальности или обнаружения и оповещения о потенциально опасных ситуациях .

При использовании на рабочем месте ИИ также создает возможность появления новых опасностей. Они могут возникнуть из-за методов машинного обучения , приводящих к непредсказуемому поведению и непрозрачности при принятии решений, или из-за проблем кибербезопасности и конфиденциальности информации . Многие опасности, связанные с искусственным интеллектом, носят психосоциальный характер из-за его способности вызывать изменения в организации труда. К ним относятся изменения в навыках, требуемых от работников, [1] усиление мониторинга приводит к микроменеджменту , алгоритмам непреднамеренно или намеренно имитируют нежелательные человеческие предубеждения и вместо этого возлагают вину за ошибки машины на человека-оператора. ИИ может также привести к физическим опасностям в виде столкновений человека и робота , а также эргономическим рискам, связанным с интерфейсами управления и взаимодействием человека и машины. Средства контроля рисков включают меры кибербезопасности и конфиденциальности информации, общение и прозрачность с работниками в отношении использования данных, а также ограничения на коллаборативные роботы .

С точки зрения безопасности и здоровья на рабочем месте имеет значение только «слабый» или «узкий» ИИ , адаптированный для конкретной задачи, поскольку существует множество примеров, которые используются в настоящее время или, как ожидается, начнут использоваться в ближайшем будущем. «Сильный» или «общий» ИИ вряд ли станет возможным в ближайшем будущем. [ по мнению кого? ] и обсуждение связанных с этим рисков находится в компетенции футуристов и философов, а не специалистов по промышленной гигиене .

Прогнозируется, что некоторые цифровые технологии приведут к потере рабочих мест. В последние годы внедрение современной робототехники привело к чистому росту занятости. Однако многие предприятия ожидают, что автоматизация или использование роботов приведут к потере рабочих мест в будущем. Это особенно актуально для компаний Центральной и Восточной Европы . [2] [3] [4] Другие цифровые технологии, такие как платформы или большие данные , по прогнозам, окажут более нейтральное влияние на занятость. [2] [4]

Приложения по охране труда и технике безопасности [ править ]

Для того чтобы любое потенциальное применение ИИ в области здравоохранения и безопасности было принято, оно должно быть одобрено как менеджерами, так и работниками. Например, принятие работниками может быть уменьшено из-за опасений по поводу конфиденциальности информации , [5] или из-за отсутствия доверия и принятия новой технологии, что может возникнуть из-за недостаточной прозрачности или недостаточной подготовки. [6] : 26–28, 43–45 менеджеры могут делать акцент на повышении экономической производительности, а не на повышении безопасности и здоровья работников. В качестве альтернативы, при внедрении систем на основе ИИ [7]

Устранение опасных задач [ править ]

ИИ может расширить объем рабочих задач, позволяя вывести работника из ситуации, сопряженной с риском . В некотором смысле, в то время как традиционная автоматизация может заменить функции тела работника роботом, ИИ эффективно заменяет функции его мозга компьютером. К опасностям, которых можно избежать, относятся стресс, переутомление, травмы опорно-двигательного аппарата и скука. [8] : 5–7

Это может расширить спектр затронутых секторов труда, включив в него рабочие места для «белых воротничков» и сферы услуг, такие как медицина, финансы и информационные технологии. [9] Например, сотрудники колл-центра сталкиваются с серьезными рисками для здоровья и безопасности из-за его повторяющегося и требовательного характера, а также высокого уровня микронаблюдения. с поддержкой искусственного интеллекта Чат-боты снижают потребность людей выполнять самые простые задачи колл-центра. [8] : 5–7

Аналитика для снижения риска [ править ]

Машинное обучение используется в HR-аналитике для прогнозирования поведения сотрудников, что помогает принимать управленческие решения, такие как найм и оценка производительности. Их также можно использовать для улучшения здоровья работников. Аналитика может быть основана на таких входных данных, как онлайн-активность, мониторинг коммуникаций, отслеживание местоположения, а также анализ голоса и анализ языка тела в записанных интервью. Например, анализ настроений можно использовать для выявления усталости и предотвращения переутомления . [8] : 3–7 Системы поддержки принятия решений обладают аналогичной способностью, которую можно использовать, например, для предотвращения промышленных катастроф или реагирования на стихийные бедствия . повышения эффективности [12]

Для занимающихся ручными погрузочно-разгрузочными работами работников, прогнозную аналитику , можно использовать и искусственный интеллект для уменьшения травм опорно-двигательного аппарата . Традиционные рекомендации основаны на статистических средних показателях и ориентированы на антропометрически типичных людей. Анализ больших объемов данных от носимых датчиков может позволить в режиме реального времени персонализировать расчет эргономических рисков и управления утомляемостью , а также лучше анализировать риски, связанные с конкретными должностными обязанностями. [5]

Носимые датчики также могут обеспечить более раннее вмешательство в случае воздействия токсичных веществ, чем это возможно при периодическом тестировании зоны или зоны дыхания. Кроме того, полученные большие наборы данных могут улучшить надзор за состоянием здоровья на рабочих местах , оценку рисков и исследования. [12]

Оптимизация рабочих процессов в области безопасности и гигиены труда [ править ]

Искусственный интеллект также можно использовать для повышения эффективности рабочего процесса по обеспечению безопасности и гигиены труда . Одним из примеров является кодирование требований о компенсации работникам , которые подаются в прозаической форме и которым необходимо вручную присваивать стандартизированные коды. Исследуются возможности искусственного интеллекта выполнить эту задачу быстрее, дешевле и с меньшим количеством ошибок. [13] [14]

с поддержкой искусственного интеллекта Системы виртуальной реальности могут быть полезны для обучения технике безопасности и распознавания опасностей. [12]

Искусственный интеллект может использоваться для более эффективного обнаружения промахов . Отчетность и анализ потенциальных происшествий важны для снижения уровня несчастных случаев, но о них часто занижают, поскольку они не замечаются людьми или не сообщаются работниками из-за социальных факторов. [15]

Опасности [ править ]

Существует несколько широких аспектов ИИ, которые могут привести к конкретным опасностям. Риски зависят от реализации, а не от простого присутствия ИИ. [8] : 2–3

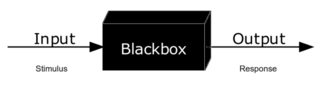

Системы, использующие субсимволический искусственный интеллект, такой как машинное обучение, могут вести себя непредсказуемо и более склонны к непостижимости принятия решений. Это особенно актуально, если возникает ситуация, которая не была частью набора обучающих данных ИИ , и усугубляется в менее структурированных средах. системы Нежелательное поведение может также возникнуть из-за недостатков в восприятии (возникающих либо в программном обеспечении, либо из-за деградации датчиков ), представления знаний и рассуждений , либо из-за ошибок в программном обеспечении . [6] : 14–18 Они могут возникнуть в результате неправильного обучения, например, когда пользователь применяет один и тот же алгоритм к двум задачам, к которым не предъявляются одинаковые требования. [8] : 12–13 Машинное обучение, применяемое на этапе проектирования, может иметь иные последствия, чем то, которое применяется во время выполнения . Системы, использующие символический ИИ , менее склонны к непредсказуемому поведению. [6] : 14–18

Использование ИИ также увеличивает риски кибербезопасности по сравнению с платформами, которые не используют ИИ. [6] : 17 а проблемы конфиденциальности собранных данных могут представлять опасность для работников. [5]

Психосоциальный [ править ]

Психосоциальные опасности – это те, которые возникают из-за того, как работа проектируется, организуется и управляется, или из ее экономического и социального контекста, а не из-за физического вещества или объекта. Они вызывают не только психиатрические и психологические последствия, такие как профессиональное выгорание , тревожные расстройства и депрессия , но также могут стать причиной физических травм или заболеваний, таких как сердечно-сосудистые заболевания или травмы опорно-двигательного аппарата . [16] Многие опасности, связанные с ИИ, носят психосоциальный характер из-за его способности вызывать изменения в организации труда с точки зрения увеличения сложности и взаимодействия между различными организационными факторами. Однако проектировщики передовых производственных систем часто упускают из виду психосоциальные риски. [7]

Изменения в практике работы [ править ]

Ожидается, что ИИ приведет к изменениям в навыках, требуемых от работников, что потребует обучения существующих работников, гибкости и открытости к изменениям. [1] Требование сочетания традиционных знаний с навыками работы на компьютере может оказаться сложной задачей для существующих работников. [7] Чрезмерная зависимость от инструментов ИИ может привести к деквалификации некоторых профессий. [12]

Усиление контроля может привести к микроменеджменту и, следовательно, к стрессу и тревоге. Восприятие слежки также может привести к стрессу. Средства контроля включают консультации с рабочими группами, обширное тестирование и внимание к внесенным предвзятости. Носимые датчики , трекеры активности и дополненная реальность также могут привести к стрессу из-за микроменеджмента как у работников сборочных линий, так и у рабочих . Гиг-работникам также не хватает правовой защиты и прав официальных работников. [8] : 2–10

Существует также риск того, что люди будут вынуждены работать в темпе робота или следить за производительностью робота в нестандартные часы. [8] : 5–7

Предвзятость [ править ]

Алгоритмы, обученные на прошлых решениях, могут имитировать нежелательные человеческие предубеждения , например, прошлую дискриминационную практику найма и увольнения . Информационная асимметрия между руководством и работниками может привести к стрессу, если работники не имеют доступа к данным или алгоритмам, лежащим в основе принятия решений. [8] : 3–5

Помимо построения модели с непреднамеренно дискриминационными характеристиками, преднамеренная дискриминация может происходить за счет разработки показателей, которые скрыто приводят к дискриминации через коррелирующие переменные неочевидным образом. [8] : 12–13

В сложных взаимодействиях человека и машины некоторые подходы к анализу аварий могут быть предвзятыми, чтобы защитить технологическую систему и ее разработчиков, вместо этого возлагая вину на отдельного человека-оператора. [12]

Физический [ править ]

Физические опасности в виде столкновений человека и робота могут возникнуть из-за роботов, использующих ИИ, особенно совместных роботов ( коботов ). Коботы предназначены для работы в непосредственной близости от человека, что делает невозможным общий контроль опасности изоляции робота с помощью заборов или других барьеров, который широко используется для традиционных промышленных роботов . Транспортные средства с автоматическим управлением — это тип коботов, которые по состоянию на 2019 год широко используются, часто в качестве вилочных погрузчиков или домкратов для поддонов на складах или заводах . [6] : 5, 29–30 В случае коботов неисправности датчиков или непредвиденные условия рабочей среды могут привести к непредсказуемому поведению робота и, следовательно, к столкновениям человека и робота. [8] : 5–7

Беспилотные автомобили — еще один пример роботов с искусственным интеллектом. Кроме того, эргономика интерфейсов управления и взаимодействие человека и машины могут создавать опасности. [7]

Контроль опасности [ править ]

ИИ, как и другие вычислительные технологии, требует мер кибербезопасности для предотвращения взломов и вторжений в программное обеспечение. [6] : 17 а также меры конфиденциальности информации . [5] Коммуникация и прозрачность использования данных с работниками позволяют контролировать психосоциальные риски, возникающие из-за вопросов безопасности и конфиденциальности. [5] Предлагаемые передовые методы для программ мониторинга работников, спонсируемых работодателем, включают использование только проверенных сенсорных технологий; обеспечение добровольного участия работников; прекращение сбора данных за пределами рабочего места; раскрытие всех видов использования данных; и обеспечение безопасного хранения данных. [12]

Для промышленных коботов, оснащенных датчиками с поддержкой искусственного интеллекта, Международная организация по стандартизации (ISO) рекомендовала: (a) контролируемые средства управления остановкой, связанные с безопасностью; (б) управление коботом рукой человека; (c) средства контроля скорости и эшелонирования; и d) ограничения власти и силы. Сетевые коботы с поддержкой искусственного интеллекта могут обмениваться информацией об улучшениях безопасности. [12] Человеческий надзор — еще один общий контроль опасностей для ИИ. [8] : 12–13

Управление рисками [ править ]

Как приложения, так и опасности, возникающие из-за ИИ, можно рассматривать как часть существующих рамок управления рисками в области охраны труда и техники безопасности . Как и в случае со всеми опасностями, идентификация рисков наиболее эффективна и наименее затратна, если она выполняется на этапе проектирования . [7]

Наблюдение за состоянием здоровья на рабочем месте , сбор и анализ данных о состоянии здоровья работников, представляет собой сложную задачу для ИИ, поскольку данные о труде часто представляются в совокупности и не дают разбивки по различным видам работы, а ориентированы скорее на экономические данные, такие как заработная плата и уровень занятости. чем квалификационное содержание рабочих мест. Заместители содержания навыков включают образовательные требования и классификацию рутинных и нерутинных, когнитивных и физических работ. Однако они все еще могут быть недостаточно конкретными, чтобы отличить конкретные профессии, которые оказывают явное влияние на ИИ. представляет труда США Министерства Сеть профессиональной информации собой пример базы данных с подробной таксономией навыков. Кроме того, данные часто предоставляются на национальном уровне, хотя существуют большие географические различия, особенно между городскими и сельскими районами. [9]

Стандарты и регулирование [ править ]

По состоянию на 2019 год [update]ISO разрабатывала стандарт по использованию метрик и информационных панелей , информационных дисплеев, представляющих показатели компании для менеджеров на рабочих местах. Планируется, что стандарт будет включать рекомендации как по сбору данных, так и по их отображению в доступной и полезной форме. [8] : 11 [17] [18]

В Европейском Союзе Общий регламент по защите данных , хотя и ориентирован на потребительские данные, также актуален и для сбора данных на рабочих местах. Субъекты данных, включая работников, имеют «право не подвергаться решению, основанному исключительно на автоматизированной обработке». Другие соответствующие директивы ЕС включают Директиву по машинному оборудованию (2006/42/EC), Директиву по радиооборудованию (2014/53/EU) и Общую директиву по безопасности продукции (2001/95/EC). [8] : 10, 12–13

Ссылки [ править ]

- ↑ Перейти обратно: Перейти обратно: а б «Влияние искусственного интеллекта на рабочие места: Джобокалипсис на горизонте?» . 14 июля 2023 г.

- ↑ Перейти обратно: Перейти обратно: а б Банк, Европейские инвестиции (05.05.2022). Цифровизация в Европе 2021-2022: данные инвестиционного исследования ЕИБ . Европейский инвестиционный банк. ISBN 978-92-861-5233-7 .

- ^ Паршау, Кристиан; Хауге, Йостейн (01 октября 2020 г.). «Автоматизация крадет рабочие места на производстве? Данные швейной промышленности Южной Африки» . Геофорум . 115 : 120–131. doi : 10.1016/j.geoforum.2020.07.002 . ISSN 0016-7185 . S2CID 224877507 .

- ↑ Перейти обратно: Перейти обратно: а б Генц, Сабрина (5 мая 2022 г.). «Тонкие отношения между передовыми технологиями и рабочими местами: данные из Германии» . Брукингс . Проверено 5 июня 2022 г.

- ↑ Перейти обратно: Перейти обратно: а б с д и Джанатти, Тони-Луиза (14 мая 2020 г.). «Как алгоритмы, управляемые искусственным интеллектом, повышают эргономическую безопасность человека» . Охрана труда и безопасность . Проверено 30 июля 2020 г.

- ↑ Перейти обратно: Перейти обратно: а б с д и ж Янсен, Энн; ван дер Бек, Дольф; Кремерс, Анита; Неиринкс, Марк; ван Мидделаар, Йохан (28 августа 2018 г.). «Возможные риски для безопасности на рабочем месте: работа в одном пространстве с коботом» . Нидерландская организация прикладных научных исследований (TNO) . Проверено 12 августа 2020 г.

- ↑ Перейти обратно: Перейти обратно: а б с д и Бадри, Адель; Будро-Трудель, Брайан; Суисси, Ахмед Саадеддин (01 ноября 2018 г.). «Охрана труда и безопасность в эпоху индустрии 4.0: повод для серьезного беспокойства?» . Наука безопасности . 109 : 403–411. дои : 10.1016/j.ssci.2018.06.012 . hdl : 10654/44028 . S2CID 115901369 .

- ↑ Перейти обратно: Перейти обратно: а б с д и ж г час я дж к л м Мур, Фиби В. (07 мая 2019 г.). «Безопасность труда и будущее труда: преимущества и риски использования инструментов искусственного интеллекта на рабочих местах» . ЕС-OSHA . Проверено 30 июля 2020 г.

- ↑ Перейти обратно: Перейти обратно: а б Фрэнк, Морган Р.; Автор, Дэвид; Бессен, Джеймс Э.; Бриньольфссон, Эрик; Себриан, Мануэль; Деминг, Дэвид Дж.; Фельдман, Мэриэнн; Гро, Мэтью; Лобо, Хосе; Моро, Эстебан; Ван, Дашунь (2 апреля 2019 г.). «На пути к пониманию влияния искусственного интеллекта на труд» . Труды Национальной академии наук . 116 (14): 6531–6539. Бибкод : 2019PNAS..116.6531F . дои : 10.1073/pnas.1900949116 . ISSN 0027-8424 . ПМК 6452673 . ПМИД 30910965 .

- ^ Уорнер, Эмили; Хадок, Стивен Д.; Лу, Джек (25 августа 2017 г.). «NLE Calc: мобильное приложение, основанное на пересмотренном уравнении подъема NIOSH» . Научный блог NIOSH . Проверено 17 августа 2020 г.

- ^ «Руководство по применению пересмотренного уравнения подъема NIOSH» . Национальный институт охраны труда США . 1 января 1994 г. дои : 10.26616/NIOSHPUB94110 .

- ↑ Перейти обратно: Перейти обратно: а б с д и ж г Ховард, Джон (01 ноября 2019 г.). «Искусственный интеллект: последствия для будущего труда» . Американский журнал промышленной медицины . 62 (11): 917–926. дои : 10.1002/ajim.23037 . ISSN 0271-3586 . PMID 31436850 . S2CID 201275028 .

- ^ Мейерс, Алиша Р. (01 мая 2019 г.). «ИИ и рабочий компьютер» . Научный блог NIOSH . Проверено 3 августа 2020 г.

- ^ Уэбб, Сидней; Сиордия, Карлос; Бертке, Стивен; Бартлетт, Диана; Рейтц, Дэн (26 февраля 2020 г.). «Конкурс краудсорсинга искусственного интеллекта для наблюдения за травмами» . Научный блог NIOSH . Проверено 3 августа 2020 г.

- ^ Фергюсон, Мюррей (19 апреля 2016 г.). «Искусственный интеллект: что будет с EHS… и когда?» . ЭХС сегодня . Проверено 30 июля 2020 г.

- ^ Брун, Эммануэль; Мильчарек, Малгожата (2007). «Экспертный прогноз возникновения психосоциальных рисков, связанных с охраной труда» . Европейское агентство по безопасности и гигиене труда . Проверено 3 сентября 2015 г.

- ^ Мур, Фиби В. (01 апреля 2014 г.). «Под вопросом безопасность и гигиена труда в эпоху искусственного интеллекта» . Комиссия по охране труда и стандартизации . Проверено 6 августа 2020 г.

- ^ «Стандарты ISO/IEC JTC 1/SC 42 – Искусственный интеллект» . Международная организация по стандартизации . Проверено 6 августа 2020 г.