Нейронная сеть (машинное обучение)

| Часть серии о |

| Машинное обучение и интеллектуальный анализ данных |

|---|

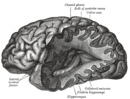

В машинном обучении нейронная сеть (также искусственная нейронная сеть или нейронная сеть , сокращенно ANN или NN ) — это модель, вдохновленная структурой и функцией биологических нейронных сетей животных в мозге . [1] [2]

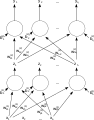

ИНС состоит из связанных единиц или узлов, называемых искусственными нейронами , которые в общих чертах моделируют нейроны мозга. Они соединены ребрами , которые моделируют синапсы в мозге. Каждый искусственный нейрон получает сигналы от связанных нейронов, затем обрабатывает их и отправляет сигнал другим подключенным нейронам. «Сигнал» — это действительное число , а выход каждого нейрона вычисляется некоторой нелинейной функцией суммы его входов, называемой функцией активации . Сила сигнала при каждом соединении определяется весом , который корректируется в процессе обучения.

Обычно нейроны объединяются в слои. Разные слои могут выполнять разные преобразования на своих входах. Сигналы перемещаются от первого слоя ( входной слой ) к последнему уровню ( выходной уровень ), возможно, проходя через несколько промежуточных слоев ( скрытые слои ). Сеть обычно называется глубокой нейронной сетью, если она имеет как минимум два скрытых слоя. [3]

Искусственные нейронные сети используются для различных задач, включая прогнозное моделирование , адаптивное управление и решение задач в области искусственного интеллекта . Они могут учиться на собственном опыте и делать выводы из сложного и, казалось бы, несвязанного набора информации.

Обучение

[ редактировать ]Нейронные сети обычно обучаются посредством минимизации эмпирического риска . Этот метод основан на идее оптимизации параметров сети для минимизации разницы или эмпирического риска между прогнозируемыми выходными данными и фактическими целевыми значениями в данном наборе данных. [4] градиентные методы, такие как обратное распространение ошибки . Для оценки параметров сети обычно используются [4] На этапе обучения ИНС обучаются на помеченных обучающих данных, итеративно обновляя свои параметры, чтобы минимизировать определенную функцию потерь . [5] Этот метод позволяет сети обобщать невидимые данные.

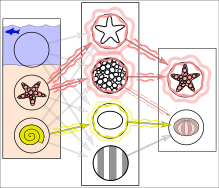

В действительности текстуры и контуры будут представлены не отдельными узлами, а скорее соответствующими весовыми шаблонами нескольких узлов.

История

[ редактировать ]Исторически цифровые компьютеры произошли от модели фон Неймана и работают посредством выполнения явных инструкций посредством доступа к памяти несколькими процессорами. Нейронные сети, с другой стороны, возникли в результате попыток смоделировать обработку информации в биологических системах в рамках коннекционизма . В отличие от модели фон Неймана, коннекционистские вычисления не разделяют память и обработку.

Самый простой вид нейронной сети прямого распространения (FNN) — это линейная сеть, состоящая из одного слоя выходных узлов; входные данные подаются непосредственно на выходы через ряд весов. Сумма произведений весов и входных данных рассчитывается в каждом узле. Среднеквадратические ошибки между этими рассчитанными выходными данными и заданными целевыми значениями сводятся к минимуму за счет корректировки весов. Этот метод известен уже более двух столетий как метод наименьших квадратов или линейная регрессия . (1795 г.) использовали его как средство нахождения хорошей грубой линейной аппроксимации набора точек Лежандр (1805 г.) и Гаусс для предсказания движения планет. [7] [8] [9] [10] [11]

Уоррен Маккалок и Уолтер Питтс [12] (1943) также рассматривали вычислительную модель нейронных сетей, не требующую обучения. [13]

В конце 1940-х годов Д.О. Хебб [14] обучения создал гипотезу , основанную на механизме нейронной пластичности , которая стала известна как обучение Хебба . Хеббианское обучение считается «типичным» правилом обучения без присмотра , а его более поздние варианты были ранними моделями долгосрочного потенцирования . Эти идеи начали применяться к вычислительным моделям в 1948 году с « неорганизованными машинами » Тьюринга. Фарли и Уэсли А. Кларк [15] были первыми, кто смоделировал сеть Хебба в 1954 году в Массачусетском технологическом институте. Они использовали вычислительные машины, которые тогда назывались «калькуляторами». Другие вычислительные машины с нейронными сетями были созданы Рочестером, Холландом, Хабитом и Дудой. [16] в 1956 году. В 1958 году психолог Фрэнк Розенблатт изобрел перцептрон , первую реализованную искусственную нейронную сеть, [17] [18] [19] [20] США финансируется Управлением военно-морских исследований . [21]

Изобретение перцептрона вызвало общественный интерес к исследованиям в области искусственных нейронных сетей, что заставило правительство США резко увеличить финансирование исследований в области глубокого обучения. Это привело к «золотому веку искусственного интеллекта», чему способствовали оптимистические заявления ученых-компьютерщиков относительно способности перцептронов имитировать человеческий интеллект. [22] Например, в 1957 году Герберт Саймон сказал: [22]

У меня нет цели удивить или шокировать вас, но самый простой способ, которым я могу подвести итог, — это сказать, что сейчас в мире существуют машины, которые думают, учатся и творят. Более того, их способность делать эти вещи будет быстро возрастать до тех пор, пока — в обозримом будущем — диапазон проблем, с которыми они могут справиться, не станет таким же обширным, как и диапазон, к которому применяется человеческий разум.

Однако этого не произошло, поскольку исследования в Соединенных Штатах застопорились после работы Мински и Паперта (1969). [23] который обнаружил, что базовые перцептроны не способны обрабатывать схему «исключающее-или» и что компьютерам не хватает мощности для обучения полезных нейронных сетей. Это, наряду с другими факторами, такими как отчет Лайтхилла 1973 года Джеймса Лайтхилла , в котором говорится, что исследования в области искусственного интеллекта «не дали того серьезного эффекта, который тогда был обещан», прекращение финансирования исследований в области ИИ во всех университетах США, кроме двух. Великобритании и во многих крупных учреждениях по всему миру. [24] Это положило начало эпохе под названием « Зима искусственного интеллекта» , в которой исследования коннекционизма сократились из-за уменьшения государственного финансирования и повышенного внимания к символическому искусственному интеллекту в Соединенных Штатах и других западных странах. [25] [24]

Однако в эпоху AI Winter исследования за пределами США продолжались, особенно в Восточной Европе. К моменту книги Мински и Паперта о перцептронах выхода методы обучения многослойных перцептронов (MLP) уже были известны. Первая MLP глубокого обучения была опубликована Алексеем Григорьевичем Ивахненко и Валентином Лапой в 1965 году под названием « Групповой метод обработки данных» . [26] [27] [28] Первый MLP глубокого обучения, обученный методом стохастического градиентного спуска [29] был опубликован в 1967 году Шуничи Амари. [30] [31] В компьютерных экспериментах, проведенных учеником Амари Сайто, пятислойная MLP с двумя изменяемыми слоями изучила полезные внутренние представления для классификации классов нелинейно разделимых шаблонов. [31]

Самоорганизующиеся карты (СОМ) были описаны Теуво Кохоненом в 1982 году. [32] [33] СОМ основаны на нейрофизиологии [34] нейронные сети, которые изучают низкоразмерные представления многомерных данных, сохраняя при этом топологическую структуру данных. Они обучаются с использованием конкурсного обучения . [32]

Архитектура сверточной нейронной сети (CNN) со сверточными слоями и слоями понижающей дискретизации была представлена Кунихико Фукусимой в 1980 году. [35] Он назвал это неокогнитроном . В 1969 году он также представил ReLU (выпрямленная линейная единица) функцию активации . [36] [10] Выпрямитель стал самой популярной функцией активации для CNN и глубоких нейронных сетей в целом. [37] CNN стали важным инструментом компьютерного зрения .

Ключом к более поздним достижениям в исследованиях искусственных нейронных сетей стал алгоритм обратного распространения ошибки , эффективное применение Лейбница цепного правила (1673 г.). [38] к сетям дифференцируемых узлов. [10] Он также известен как обратный режим автоматического дифференцирования или обратного накопления , предложенный Сеппо Линнаинмаа (1970). [39] [40] [41] [42] [10] Термин «ошибки обратного распространения ошибки» был введен в 1962 году Фрэнком Розенблаттом. [43] [10] но у него не было реализации этой процедуры, хотя Генри Дж. Келли [44] и Брайсон [45] имели динамического программирования непрерывные предшественники обратного распространения ошибки на основе [26] [46] [47] [48] уже в 1960–61 гг. в контексте теории управления . [10] В 1973 году Дрейфус использовал обратное распространение ошибки, чтобы адаптировать параметры контроллеров пропорционально градиентам ошибок. [49] В 1982 году Пол Вербос применил обратное распространение ошибки к MLP способом, который стал стандартным. [50] [46] В 1986 году Румельхарт , Хинтон и Уильямс показали, что метод обратного распространения ошибки позволяет изучить интересные внутренние представления слов в виде векторов признаков, когда его обучают предсказывать следующее слово в последовательности. [51]

В конце 1970-х - начале 1980-х годов ненадолго возник интерес к теоретическому исследованию модели Изинга, созданной Вильгельмом Ленцем (1920) и Эрнстом Изингом (1925). [52] применительно к топологиям дерева Кэли и большим нейронным сетям . Модель Изинга по сути представляет собой необучающуюся искусственную рекуррентную нейронную сеть (RNN), состоящую из нейроноподобных пороговых элементов. [10] В 1972 году Сюнъити Амари описал адаптивную версию этой архитектуры. [53] [10] В 1981 году модель Изинга была точно решена Питером Бартом для общего случая замкнутых деревьев Кэли (с петлями) с произвольным коэффициентом ветвления. [54] и было обнаружено, что он демонстрирует необычное поведение при фазовом переходе в локальных и дальних корреляциях между сайтами. [55] [56] Джон Хопфилд популяризировал эту архитектуру в 1982 году. [57] и теперь она известна как сеть Хопфилда .

Нейронная сеть с задержкой по времени (TDNN) Алекса Вайбеля (1987) объединила свертки, распределение веса и обратное распространение ошибки. [58] [59] В 1988 году Вэй Чжан и др. применил обратное распространение ошибки к CNN (упрощенный неокогнитрон со сверточными взаимосвязями между слоями признаков изображения и последним полностью связным слоем) для распознавания алфавита. [60] [61] В 1989 году Ян ЛеКун и др. обучил CNN распознавать рукописные почтовые индексы в почте. [62] В 1992 году максимальное объединение Хуан Венг и др. представили CNN. для обеспечения инвариантности при наименьшем сдвиге и устойчивости к деформации для облегчения распознавания трехмерных объектов . [63] [64] [65] LeNet-5 (1998), 7-уровневая CNN, созданная Яном ЛеКуном и др., [66] который классифицирует цифры, был применен несколькими банками для распознавания рукописных чисел на чеках, оцифрованных в изображениях размером 32x32 пикселя.

Начиная с 1988 года, [67] [68] Использование нейронных сетей изменило область предсказания структуры белков , в частности, когда первые каскадные сети обучались на профилях (матрицах), полученных путем множественного выравнивания последовательностей . [69]

В 1991 году Зеппа Хохрайтера . защитил дипломную работу [70] выявил и проанализировал проблему исчезающего градиента [70] [71] и предложил повторяющиеся остаточные связи для решения этой проблемы. назвал «одним из самых важных документов в истории машинного обучения» Его диссертацию Юрген Шмидхубер . [10]

В 1991 году Юрген Шмидхубер опубликовал состязательные нейронные сети, которые соревнуются друг с другом в форме игры с нулевой суммой , где выигрыш одной сети является проигрышем другой сети. [72] [73] [74] Первая сеть представляет собой генеративную модель , которая моделирует распределение вероятностей по шаблонам выходных данных. Вторая сеть учится с помощью градиентного спуска предсказывать реакцию окружающей среды на эти закономерности. Это называлось «искусственным любопытством».

В 1992 году Юрген Шмидхубер предложил иерархию RNN, предварительно обученных по одному уровню за раз посредством самостоятельного обучения . [75] Он использует прогнозирующее кодирование для изучения внутренних представлений в нескольких самоорганизующихся временных масштабах. Это может существенно облегчить последующее глубокое обучение. Иерархию RNN можно свернуть в единую RNN путем разделения более высокого уровня сети блоков в сеть автоматизатора более низкого уровня . [75] [10] В том же году он также опубликовал альтернативу RNN. [76] который является предшественником линейного трансформатора . [77] [78] [10] В нем представлена концепция внутренних прожекторов внимания : [79] медленная нейронная сеть прямого распространения учится путем градиентного спуска управлять быстрыми весами другой нейронной сети посредством внешних продуктов самогенерируемых шаблонов активации.

Развитие металл-оксид-полупроводник (МОП) сверхкрупномасштабной интеграции (СБИС) в форме дополнительной технологии МОП (КМОП) позволило увеличить количество МОП-транзисторов в цифровой электронике . Это обеспечило большую вычислительную мощность для разработки практических искусственных нейронных сетей в 1980-х годах. [80]

Среди первых успехов нейронных сетей в 1995 году был (в основном) беспилотный автомобиль. [а] [81]

В 1997 году Зепп Хохрайтер и Юрген Шмидхубер представили метод глубокого обучения под названием «длинная кратковременная память» (LSTM), опубликованный в журнале Neural Computation. [82] Рекуррентные нейронные сети LSTM могут изучать задачи «очень глубокого обучения» [83] с длинными путями присвоения кредитов, требующими воспоминаний о событиях, произошедших за тысячи дискретных шагов времени до этого. «Ванильный LSTM» с затвором забывания был представлен в 1999 году Феликсом Герсом , Шмидхубером и Фредом Камминсом. [84]

Джеффри Хинтон и др. (2006) предложили изучать представление высокого уровня с использованием последовательных слоев двоичных или вещественнозначных скрытых переменных с помощью ограниченной машины Больцмана. [85] моделировать каждый слой. В 2012 году Нг и Дин создали сеть, которая научилась распознавать понятия более высокого уровня, такие как кошки, только при просмотре немаркированных изображений. [86] Предварительное обучение без присмотра и увеличение вычислительной мощности графических процессоров и распределенных вычислений позволили использовать более крупные сети, особенно для задач распознавания изображений и визуальных эффектов, которые стали известны как «глубокое обучение». [5]

Варианты алгоритма обратного распространения ошибки , а также неконтролируемые методы Джеффа Хинтона и его коллег из Университета Торонто , могут использоваться для обучения глубоких, сильно нелинейных нейронных архитектур. [87] похож на Неокогнитрон 1980 года Кунихико Фукусимы , [88] и «стандартная архитектура видения», [89] вдохновлен простыми и сложными клетками, выявленными Дэвидом Х. Хьюбелом и Торстеном Визелем в первичной зрительной коре .

Вычислительные устройства были созданы на КМОП как для биофизического моделирования, так и для нейроморфных вычислений . Более поздние усилия показывают перспективу создания наноустройств для очень крупномасштабного анализа главных компонентов и свертки . [90] В случае успеха эти усилия могут открыть новую эру нейронных вычислений , которая станет шагом за пределы цифровых вычислений. [91] потому что это зависит от обучения, а не от программирования , и потому что оно по своей сути является аналоговым, а не цифровым, даже несмотря на то, что первые экземпляры могут фактически быть с цифровыми устройствами CMOS.

Чиресан и коллеги (2010) [92] показали, что, несмотря на исчезающую проблему градиента , графические процессоры делают возможным обратное распространение ошибки для многослойных нейронных сетей с прямой связью. [93] В период с 2009 по 2012 год ИНС начали выигрывать призы в конкурсах по распознаванию изображений, приближаясь к человеческому уровню при выполнении различных задач, первоначально в распознавании образов и распознавании рукописного текста . [94] [95] Например, двунаправленная и многомерная длинная кратковременная память (LSTM). [96] [97] Грейвса и др . выиграл три конкурса по распознаванию рукописного ввода в 2009 году, не имея никаких предварительных знаний о трех языках, которые предстоит выучить. [96] [97]

Чиресан и его коллеги создали первые распознаватели образов для достижения конкурентоспособных и сверхчеловеческих результатов. [98] по таким показателям, как распознавание дорожных знаков (IJCNN, 2012).

Радиальная базисная функция и вейвлет-сети были представлены в 2013 году. Можно показать, что они обладают наилучшими аппроксимирующими свойствами и применяются в приложениях идентификации и классификации нелинейных систем . [99]

В 2014 году принцип состязательной сети был использован в генеративно-состязательной сети (GAN) Яном Гудфеллоу и др. [100] Здесь состязательная сеть (дискриминатор) выводит значение от 1 до 0 в зависимости от вероятности того, что выходной сигнал первой сети (генератора) находится в заданном наборе. Это можно использовать для создания реалистичных дипфейков . [101] Превосходное качество изображения достигается с помощью Nvidia от StyleGAN (2018). [102] на основе Progressive GAN Теро Карраса, Тимо Айлы, Самули Лайне и Яакко Лехтинена. [103] Здесь генератор GAN растет от малого к большому по пирамидальной схеме.

В 2015 году Рупеш Кумар Шривастава, Клаус Грефф и Шмидхубер использовали принцип LSTM для создания сети Highway — нейронной сети прямого распространения с сотнями слоев, гораздо более глубокой, чем предыдущие сети. [104] [105] 7 месяцев спустя Каймин Хэ, Сянъюй Чжан; Шаоцин Рен и Цзянь Сунь выиграли конкурс ImageNet с открытыми воротами или без ворот сети шоссе 2015, предложив вариант под названием Остаточная нейронная сеть . [106]

В 2017 году Ашиш Васвани и др. представили современную архитектуру Transformer в своей статье «Внимание — это все, что вам нужно». [107] Он сочетает в себе это с оператором softmax и матрицей проекции. [10] Трансформаторы все чаще становятся предпочтительной моделью обработки естественного языка . [108] многие современные модели больших языков, такие как ChatGPT , GPT-4 и BERT Его используют . Трансформаторы также все чаще используются в компьютерном зрении . [ нужна ссылка ]

Рамензанпур и др. в 2020 году показал, что аналитические и вычислительные методы, основанные на статистической физике неупорядоченных систем, можно распространить на крупномасштабные проблемы, включая машинное обучение, например, для анализа весового пространства глубоких нейронных сетей. [109]

Модели

[ редактировать ]Этот раздел может сбивать с толку или быть неясным для читателей . ( Апрель 2017 г. ) |

ИНС возникли как попытка использовать архитектуру человеческого мозга для выполнения задач, с которыми традиционные алгоритмы не имели большого успеха. Вскоре они переориентировались на улучшение эмпирических результатов, отказавшись от попыток оставаться верными своим биологическим предшественникам. ИНС обладают способностью обучаться и моделировать нелинейности и сложные взаимосвязи. Это достигается за счет соединения нейронов по различным схемам, что позволяет выходным сигналам одних нейронов становиться входными данными для других. Сеть образует ориентированный взвешенный граф . [110]

Искусственная нейронная сеть состоит из смоделированных нейронов. Каждый нейрон связан с другими узлами посредством связей, подобных биологической связи аксон-синапс-дендрит. Все узлы, соединенные ссылками, принимают некоторые данные и используют их для выполнения определенных операций и задач с данными. Каждое звено имеет вес, определяющий силу влияния одного узла на другой. [111] позволяя весам выбирать сигнал между нейронами.

Искусственные нейроны

[ редактировать ]ИНС состоят из искусственных нейронов , которые концептуально произошли от биологических нейронов . Каждый искусственный нейрон имеет входы и выдает один выходной сигнал, который можно отправить нескольким другим нейронам. [112] Входными данными могут быть значения признаков выборки внешних данных, таких как изображения или документы, или выходные данные других нейронов. Выходы конечных выходных нейронов нейронной сети выполняют такую задачу, как распознавание объекта на изображении.

Чтобы найти выход нейрона, мы берем взвешенную сумму всех входов, взвешенную по от входов весам связей к нейрону. Мы добавляем к этой сумме слагаемое смещения . [113] Эту взвешенную сумму иногда называют активацией . Затем эта взвешенная сумма передается через (обычно нелинейную) функцию активации для получения выходных данных. Исходными входными данными являются внешние данные, такие как изображения и документы. Конечные результаты выполняют задачу, например, распознавание объекта на изображении. [114]

Организация

[ редактировать ]Нейроны обычно организованы в несколько слоев, особенно при глубоком обучении . Нейроны одного слоя соединяются только с нейронами непосредственно предшествующего и непосредственно последующего слоев. Уровень, который получает внешние данные, является входным слоем . Слой, который дает конечный результат, является выходным слоем . Между ними находится ноль или более скрытых слоев . Также используются однослойные и многоуровневые сети. Между двумя слоями возможны несколько шаблонов соединения. Они могут быть «полностью связанными», когда каждый нейрон одного слоя соединяется с каждым нейроном следующего слоя. Они могут быть объединенными , когда группа нейронов в одном слое соединяется с одним нейроном в следующем слое, тем самым уменьшая количество нейронов в этом слое. [115] Нейроны только с такими связями образуют направленный ациклический граф и известны как сети прямого распространения . [116] Альтернативно, сети, которые обеспечивают соединения между нейронами в одном и том же или предыдущих слоях, известны как рекуррентные сети . [117]

Гиперпараметр

[ редактировать ]Гиперпараметр — это постоянный параметр , значение которого устанавливается до начала процесса обучения. Значения параметров получаются посредством обучения. Примеры гиперпараметров включают скорость обучения , количество скрытых слоев и размер пакета. [ нужна ссылка ] Значения некоторых гиперпараметров могут зависеть от значений других гиперпараметров. Например, размер некоторых слоев может зависеть от общего количества слоев.

Обучение

[ редактировать ]Этот раздел включает список использованной литературы , связанной литературы или внешних ссылок , но его источники остаются неясными, поскольку в нем отсутствуют встроенные цитаты . ( Август 2019 г. ) |

Обучение — это адаптация сети для лучшего выполнения задачи путем рассмотрения выборочных наблюдений. Обучение включает в себя корректировку весов (и дополнительных порогов) сети для повышения точности результата. Это достигается за счет минимизации наблюдаемых ошибок. Обучение считается завершенным, когда изучение дополнительных наблюдений не снижает коэффициент ошибок. Даже после обучения частота ошибок обычно не достигает 0. Если после обучения частота ошибок слишком высока, сеть обычно необходимо перепроектировать. Практически это делается путем определения функции стоимости , которая периодически оценивается во время обучения. Пока его производительность продолжает снижаться, обучение продолжается. Стоимость часто определяется как статистика , значение которой может быть только приблизительно оценено. Выходные данные на самом деле представляют собой числа, поэтому, когда ошибка мала, разница между выходными данными (почти наверняка кот) и правильным ответом (кошка) невелика. Обучение пытается уменьшить общую сумму различий между наблюдениями. Большинство моделей обучения можно рассматривать как простое применение теория оптимизации и статистическое оценивание . [110] [118]

Скорость обучения

[ редактировать ]Скорость обучения определяет размер корректирующих шагов, которые модель предпринимает для корректировки ошибок в каждом наблюдении. [119] Высокая скорость обучения сокращает время обучения, но с более низкой предельной точностью, тогда как более низкая скорость обучения требует больше времени, но с потенциалом большей точности. Оптимизации, такие как Quickprop, в первую очередь направлены на ускорение минимизации ошибок, тогда как другие улучшения в основном направлены на повышение надежности. Чтобы избежать колебаний внутри сети, таких как чередующиеся веса соединений, и улучшить скорость сходимости, в уточнениях используется адаптивная скорость обучения , которая увеличивается или уменьшается по мере необходимости. [120] Концепция импульса позволяет взвесить баланс между градиентом и предыдущим изменением, так что корректировка веса в некоторой степени зависит от предыдущего изменения. Импульс, близкий к 0, подчеркивает градиент, а значение, близкое к 1, подчеркивает последнее изменение.

Функция стоимости

[ редактировать ]Хотя можно определить функцию стоимости ad hoc , часто выбор определяется желаемыми свойствами функции (такими как выпуклость модели ) или тем, что она вытекает из модели (например, в вероятностной модели апостериорная вероятность может использоваться как обратная функция) . расходы).

Обратное распространение ошибки

[ редактировать ]Обратное распространение ошибки — это метод, используемый для корректировки весов соединений для компенсации каждой ошибки, обнаруженной во время обучения. Сумма ошибки эффективно распределяется между соединениями. Технически обратное распространение вычисляет градиент (производную) функции стоимости , связанной с данным состоянием, по отношению к весам. Обновления веса могут быть выполнены с помощью стохастического градиентного спуска или других методов, таких как машины экстремального обучения . [121] сети «без опоры», [122] обучение без возврата, [123] «невесомые» сети, [124] [125] и неконнекционистские нейронные сети . [ нужна ссылка ]

Парадигмы обучения

[ редактировать ]Этот раздел включает список использованной литературы , связанной литературы или внешних ссылок , но его источники остаются неясными, поскольку в нем отсутствуют встроенные цитаты . ( Август 2019 г. ) |

Машинное обучение обычно разделяют на три основные парадигмы обучения: обучение с учителем , [126] обучение без присмотра [127] и обучение с подкреплением . [128] Каждый соответствует определенной учебной задаче.

Обучение под присмотром

[ редактировать ]Обучение с учителем использует набор парных входов и желаемых результатов. Задача обучения состоит в том, чтобы получить желаемый результат для каждого входа. В этом случае функция затрат связана с устранением неверных вычетов. [129] Обычно используемая стоимость — это среднеквадратическая ошибка , которая пытается минимизировать среднеквадратическую ошибку между выходными данными сети и желаемыми выходными данными. Задачи, подходящие для обучения с учителем, — это распознавание образов (также известное как классификация) и регрессия (также известная как аппроксимация функций). Обучение с учителем также применимо к последовательным данным (например, для распознавания рукописного текста, речи и жестов ). Это можно рассматривать как обучение с «учителем» в виде функции, обеспечивающей непрерывную обратную связь о качестве полученных к настоящему моменту решений.

Обучение без присмотра

[ редактировать ]При обучении без учителя входные данные передаются вместе с функцией стоимости, некоторой функцией данных. и выход сети. Функция стоимости зависит от задачи (области модели) и любых априорных предположений (неявных свойств модели, ее параметров и наблюдаемых переменных). В качестве тривиального примера рассмотрим модель где является константой, а стоимость . Минимизация этих затрат дает ценность это равно среднему значению данных. Функция стоимости может быть гораздо более сложной. Его форма зависит от приложения: например, при сжатии это может быть связано с взаимной информацией между и , тогда как в статистическом моделировании это может быть связано с апостериорной вероятностью модели с учетом данных (обратите внимание, что в обоих этих примерах эти величины будут максимизированы, а не минимизированы). Задачи, подпадающие под парадигму обучения без учителя, относятся к общей оценки задачам ; приложения включают кластеризацию , оценку статистических распределений , сжатие и фильтрацию .

Обучение с подкреплением

[ редактировать ]В таких приложениях, как видеоигры, актер выполняет ряд действий, после каждого из которых получает в целом непредсказуемый ответ от окружающей среды. Цель состоит в том, чтобы выиграть игру, т. е. получить наиболее положительные (с наименьшими затратами) ответы. Целью обучения с подкреплением является взвешивание сети (разработка политики) для выполнения действий, которые минимизируют долгосрочные (ожидаемые совокупные) затраты. В каждый момент времени агент выполняет действие, а среда генерирует наблюдение и мгновенную стоимость в соответствии с некоторыми (обычно неизвестными) правилами. Правила и долгосрочные затраты обычно можно только оценить. В любой момент агент решает, следует ли исследовать новые действия, чтобы выявить связанные с ними затраты, или использовать предыдущее обучение, чтобы действовать быстрее.

Формально среда моделируется как марковский процесс принятия решений (MDP) с состояниями. и действия . Поскольку переходы между состояниями неизвестны, вместо них используются распределения вероятностей: мгновенное распределение стоимости. , распределение наблюдений и переходное распределение , а политика определяется как условное распределение действий с учетом наблюдений. В совокупности они определяют цепь Маркова (MC). Цель состоит в том, чтобы найти самый дешевый MC.

ИНС служат компонентом обучения в таких приложениях. [130] [131] Динамическое программирование в сочетании с ИНС (обеспечивающее нейродинамическое программирование) [132] был применен к таким проблемам, как определение маршрута транспортных средств , [133] видеоигры, управление природными ресурсами [134] [135] и медицина [136] из-за способности ИНС смягчать потери точности даже при уменьшении плотности сетки дискретизации для численной аппроксимации решения задач управления. Задачи, подпадающие под парадигму обучения с подкреплением, — это задачи управления, игры и другие задачи последовательного принятия решений.

Самообучение

[ редактировать ]Самообучение в нейронных сетях было представлено в 1982 году вместе с нейронной сетью, способной к самообучению, названной перекрестной адаптивной матрицей (CAA). [137] Это система только с одним входом, ситуацией s, и только одним выходом, действием (или поведением) a. Он не имеет ни внешних рекомендаций, ни внешнего подкрепления из окружающей среды. CAA перекрестно вычисляет как решения о действиях, так и эмоции (чувства) в отношении возникших ситуаций. Система управляется взаимодействием познания и эмоций. [138] Учитывая матрицу памяти W =||w(a,s)||, алгоритм самообучения перекрестной панели на каждой итерации выполняет следующие вычисления:

In situation s perform action a; Receive consequence situation s'; Compute emotion of being in consequence situation v(s'); Update crossbar memory w'(a,s) = w(a,s) + v(s').

Значение обратного распространения (вторичное подкрепление) — это эмоция по отношению к последствиям ситуации. ВГА существует в двух средах: одна - это поведенческая среда, в которой он ведет себя, а другая - генетическая среда, откуда он изначально и только один раз получает первоначальные эмоции о том, с какими ситуациями придется столкнуться в поведенческой среде. Получив геномный вектор (вектор вида) из генетической среды, ВГА научится целенаправленному поведению в поведенческой среде, содержащей как желательные, так и нежелательные ситуации. [139]

Нейроэволюция

[ редактировать ]Нейроэволюция может создавать топологии и веса нейронных сетей с использованием эволюционных вычислений . Он конкурирует со сложными подходами градиентного спуска. [140] [141] Одним из преимуществ нейроэволюции является то, что она менее склонна заходить в «тупики». [142]

Стохастическая нейронная сеть

[ редактировать ]Стохастические нейронные сети, возникшие на основе моделей Шеррингтона-Киркпатрика, представляют собой тип искусственных нейронных сетей, построенных путем введения в сеть случайных изменений либо путем присвоения искусственным нейронам сети стохастических передаточных функций, либо путем присвоения им стохастических весов. Это делает их полезными инструментами для решения задач оптимизации , поскольку случайные колебания помогают сети избежать локальных минимумов . [143] Стохастические нейронные сети, обученные с использованием байесовского подхода, известны как байесовские нейронные сети . [144]

Другой

[ редактировать ]В байесовской системе распределение по множеству разрешенных моделей выбирается для минимизации затрат. Эволюционные методы , [145] программирование экспрессии генов , [146] имитация отжига , [147] ожидание-максимизация , непараметрические методы и оптимизация роя частиц [148] другие алгоритмы обучения. Конвергентная рекурсия — это алгоритм обучения нейронных сетей контроллера артикуляции модели мозжечка (CMAC). [149] [150]

Режимы

[ редактировать ]Этот раздел включает список использованной литературы , связанной литературы или внешних ссылок , но его источники остаются неясными, поскольку в нем отсутствуют встроенные цитаты . ( Август 2019 г. ) |

Доступны два режима обучения: стохастический и пакетный. При стохастическом обучении каждый ввод создает корректировку веса. При пакетном обучении веса корректируются на основе пакета входных данных, накапливая ошибки по всему пакету. Стохастическое обучение вносит в процесс «шум», используя локальный градиент, рассчитанный на основе одной точки данных; это снижает вероятность того, что сеть застрянет в локальных минимумах. Однако пакетное обучение обычно обеспечивает более быстрый и стабильный спуск к локальному минимуму, поскольку каждое обновление выполняется в направлении средней ошибки пакета. Распространенным компромиссом является использование «мини-партий», небольших партий, в каждой партии образцы которых выбираются стохастически из всего набора данных.

Типы

[ редактировать ]ИНС превратились в широкое семейство методов, которые продвинули современный уровень техники во многих областях. Простейшие типы имеют один или несколько статических компонентов, включая количество модулей, количество слоев, веса модулей и топологию . Динамические типы позволяют одному или нескольким из них развиваться посредством обучения. Последнее намного сложнее, но может сократить период обучения и дать лучшие результаты. Некоторые типы позволяют/требуют обучения под «контролем» оператора, тогда как другие работают независимо. Некоторые типы работают исключительно аппаратно, тогда как другие являются чисто программными и работают на компьютерах общего назначения.

Некоторые из основных прорывов включают в себя:

- Сверточные нейронные сети , доказавшие свою эффективность в обработке визуальных и других двумерных данных; [151] [152] где длинная кратковременная память позволяет избежать проблемы исчезающего градиента [153] и может обрабатывать сигналы, которые имеют смесь низкочастотных и высокочастотных компонентов, что способствует распознаванию речи с большим словарным запасом, [154] [155] синтез текста в речь, [156] [46] [157] и фотореалистичные говорящие головы; [158]

- Конкурентные сети, такие как генеративно-состязательные сети , в которых несколько сетей (разной структуры) конкурируют друг с другом в таких задачах, как победа в игре. [159] или обмануть оппонента относительно подлинности вводимых данных. [100]

Проектирование сети

[ редактировать ]Использование искусственных нейронных сетей требует понимания их характеристик.

- Выбор модели: зависит от представления данных и приложения. Параметры модели включают количество, тип и связность сетевых слоев, а также размер каждого и тип подключения (полный, пул и т. д.). Слишком сложные модели обучаются медленно.

- Алгоритм обучения . Между алгоритмами обучения существует множество компромиссов. Практически любой алгоритм будет хорошо работать с правильными гиперпараметрами. [160] для обучения на конкретном наборе данных. Однако выбор и настройка алгоритма обучения на невидимых данных требует значительного экспериментирования.

- Устойчивость : если модель, функция стоимости и алгоритм обучения выбраны правильно, результирующая ИНС может стать устойчивой.

Поиск нейронной архитектуры (NAS) использует машинное обучение для автоматизации проектирования ИНС. Различные подходы к NAS позволяют создавать сети, которые не уступают системам, созданным вручную. Основной алгоритм поиска состоит в том, чтобы предложить модель-кандидат, сравнить ее с набором данных и использовать результаты в качестве обратной связи для обучения сети NAS. [161] Доступные системы включают AutoML и AutoKeras. [162] Библиотека scikit-learn предоставляет функции, помогающие построить глубокую сеть с нуля. Затем мы можем реализовать глубокую сеть с помощью TensorFlow или Keras .

Гиперпараметры также должны быть определены как часть проекта (они не изучаются), определяя такие вопросы, как количество нейронов в каждом слое, скорость обучения, шаг, шаг, глубина, рецептивное поле и заполнение (для CNN) и т. д. [163]

Фрагмент кода Python предоставляет обзор функции обучения, которая использует набор обучающих данных, количество модулей скрытого слоя, скорость обучения и количество итераций в качестве параметров:def train(X, y, n_hidden, learning_rate, n_iter):

m, n_input = X.shape

# 1. random initialize weights and biases

w1 = np.random.randn(n_input, n_hidden)

b1 = np.zeros((1, n_hidden))

w2 = np.random.randn(n_hidden, 1)

b2 = np.zeros((1, 1))

# 2. in each iteration, feed all layers with the latest weights and biases

for i in range(n_iter + 1):

z2 = np.dot(X, w1) + b1

a2 = sigmoid(z2)

z3 = np.dot(a2, w2) + b2

a3 = z3

dz3 = a3 - y

dw2 = np.dot(a2.T, dz3)

db2 = np.sum(dz3, axis=0, keepdims=True)

dz2 = np.dot(dz3, w2.T) * sigmoid_derivative(z2)

dw1 = np.dot(X.T, dz2)

db1 = np.sum(dz2, axis=0)

# 3. update weights and biases with gradients

w1 -= learning_rate * dw1 / m

w2 -= learning_rate * dw2 / m

b1 -= learning_rate * db1 / m

b2 -= learning_rate * db2 / m

if i % 1000 == 0:

print("Epoch", i, "loss: ", np.mean(np.square(dz3)))

model = {"w1": w1, "b1": b1, "w2": w2, "b2": b2}

return model

[ нужна ссылка ]

Приложения

[ редактировать ]Благодаря своей способности воспроизводить и моделировать нелинейные процессы искусственные нейронные сети нашли применение во многих дисциплинах. К ним относятся:

- Аппроксимация функции , [164] или регрессионный анализ , [165] (включая прогнозирование временных рядов , аппроксимацию пригодности , [166] и моделирование)

- Обработка данных [167] (включая фильтрацию, кластеризацию, слепое разделение источников , [168] и сжатие)

- Идентификация нелинейной системы [99] и управление (включая управление транспортным средством, прогнозирование траектории, [169] адаптивное управление , управление процессами и управление природными ресурсами )

- Распознавание образов (включая радиолокационные системы, идентификация лиц , классификация сигналов, [170] обнаружение новизны , 3D реконструкция , [171] распознавание объектов и последовательное принятие решений [172] )

- Распознавание последовательностей (включая жесты , речь , распознавание рукописного и печатного текста) [173] )

- Анализ данных датчиков [174] (включая анализ изображений )

- Робототехника (в том числе управляющие манипуляторы и протезы )

- Интеллектуальный анализ данных (включая обнаружение знаний в базах данных )

- Финансы [175] (например, прогнозные модели для конкретных финансовых долгосрочных прогнозов и искусственные финансовые рынки )

- Квантовая химия [176]

- Общая игра [177]

- Генеративный ИИ [178]

- Визуализация данных

- Машинный перевод

- Фильтрация социальных сетей [179]

- спама в электронной почте Фильтрация

- Медицинский диагноз

ИНС использовались для диагностики нескольких типов рака. [180] [181] и отличить высокоинвазивные линии раковых клеток от менее инвазивных линий, используя только информацию о форме клеток. [182] [183]

ИНС использовались для ускорения анализа надежности инфраструктур, подверженных стихийным бедствиям. [184] [185] и прогнозировать осадки фундамента. [186] Также может быть полезно смягчить последствия наводнений за счет использования ИНС для моделирования дождевого стока. [187] ИНС также использовались для построения моделей «черного ящика» в геонауках : гидрологии , [188] [189] моделирование океана и прибрежная инженерия , [190] [191] и геоморфология . [192] ИНС используются в сфере кибербезопасности с целью отличить законную деятельность от злонамеренной. Например, машинное обучение использовалось для классификации вредоносных программ для Android. [193] для идентификации доменов, принадлежащих субъектам угроз, и для обнаружения URL-адресов, представляющих угрозу безопасности. [194] Ведутся исследования систем ИНС, предназначенных для тестирования на проникновение, обнаружения ботнетов, [195] мошенничество с кредитными картами [196] и сетевые вторжения.

ИНС были предложены как инструмент для решения уравнений в частных производных в физике. [197] [198] [199] и моделировать свойства открытых квантовых систем многих тел . [200] [201] [202] [203] В исследованиях мозга ИНС изучали кратковременное поведение отдельных нейронов . [204] динамика нейронных цепей возникает в результате взаимодействия между отдельными нейронами и того, как поведение может возникать из абстрактных нейронных модулей, которые представляют собой целые подсистемы. В исследованиях рассматривалась долгосрочная и краткосрочная пластичность нейронных систем и их связь с обучением и памятью от отдельного нейрона до системного уровня.

По картинкам можно создать профиль интересов пользователя, используя искусственные нейронные сети, обученные распознаванию объектов. [205]

Помимо традиционных приложений, искусственные нейронные сети все чаще используются в междисциплинарных исследованиях, таких как материаловедение. Например, графовые нейронные сети (GNN) продемонстрировали свою способность масштабировать глубокое обучение для открытия новых стабильных материалов путем эффективного прогнозирования полной энергии кристаллов. Это приложение подчеркивает адаптивность и потенциал ИНС в решении сложных проблем, выходящих за рамки прогнозного моделирования и искусственного интеллекта, открывая новые пути для научных открытий и инноваций. [206]

Теоретические свойства

[ редактировать ]Вычислительная мощность

[ редактировать ]Многослойный персептрон является универсальным аппроксиматором функции , что доказано теоремой об универсальной аппроксимации . Однако доказательство не является конструктивным в отношении количества необходимых нейронов, топологии сети, весов и параметров обучения.

Особая рекуррентная архитектура с рациональными весами (в отличие от вещественных весов с полной точностью) обладает мощью универсальной машины Тьюринга . [207] с использованием конечного числа нейронов и стандартных линейных связей. Кроме того, использование иррациональных значений весов приводит к созданию машины с супермощью Тьюринга . [208] [209] [ не удалось пройти проверку ]

Емкость

[ редактировать ]Свойство модели «емкость» соответствует ее способности моделировать любую заданную функцию. Это связано с объемом информации, которая может храниться в сети, и с понятием сложности. Сообществу известны два понятия емкости. Информационная емкость и размерность венчурного капитала. Информационная емкость перцептрона интенсивно обсуждается в книге сэра Дэвида Маккея. [210] который суммирует работу Томаса Ковера. [211] Емкость сети стандартных нейронов (не сверточных) можно определить по четырем правилам: [212] которые вытекают из понимания нейрона как электрического элемента. Информационная емкость охватывает функции, моделируемые сетью, если на входе имеются любые данные. Второе понятие — это размер венчурного капитала . VC Dimension использует принципы теории меры и находит максимальную мощность при наилучших возможных обстоятельствах. Это если ввести входные данные в определенном виде. Как отмечается в, [210] Размерность VC для произвольных входных данных составляет половину информационной емкости персептрона. Размер VC для произвольных точек иногда называют объемом памяти. [213]

Конвергенция

[ редактировать ]Модели могут не всегда сходиться к единому решению, во-первых, потому, что могут существовать локальные минимумы, в зависимости от функции стоимости и модели. Во-вторых, используемый метод оптимизации может не гарантировать сходимость, когда он начинается далеко от любого локального минимума. В-третьих, при достаточно больших данных или параметрах некоторые методы становятся непрактичными.

Еще одна проблема, о которой стоит упомянуть, заключается в том, что обучение может пересечь некоторую седловую точку , что может привести к сближению в неправильном направлении.

Поведение конвергенции определенных типов архитектур ИНС более понятно, чем других. Когда ширина сети приближается к бесконечности, ИНС хорошо описывается расширением Тейлора первого порядка на протяжении всего обучения и, таким образом, наследует поведение сходимости аффинных моделей . [214] [215] Другой пример: когда параметры малы, замечено, что ИНС часто соответствуют целевым функциям от низких до высоких частот. Такое поведение называется спектральным смещением или частотным принципом нейронных сетей. [216] [217] [218] [219] Это явление противоположно поведению некоторых хорошо изученных итерационных численных схем, таких как метод Якоби . Было замечено, что более глубокие нейронные сети более склонны к низкочастотным функциям. [220]

Обобщение и статистика

[ редактировать ]Этот раздел включает список использованной литературы , связанной литературы или внешних ссылок , но его источники остаются неясными, поскольку в нем отсутствуют встроенные цитаты . ( Август 2019 г. ) |

Приложения, целью которых является создание системы, которая хорошо обобщает невидимые примеры, сталкиваются с возможностью переобучения. Это возникает в запутанных или переопределенных системах, когда пропускная способность сети значительно превышает необходимые свободные параметры. Два подхода касаются перетренированности. Первый — использовать перекрестную проверку и подобные методы для проверки наличия переобучения и выбора гиперпараметров для минимизации ошибки обобщения.

Второй — использовать некоторую форму регуляризации . Эта концепция возникает в вероятностной (байесовской) структуре, где регуляризация может быть выполнена путем выбора большей априорной вероятности среди более простых моделей; но также и в статистической теории обучения, где целью является минимизация двух величин: «эмпирического риска» и «структурного риска», который примерно соответствует ошибке в обучающем наборе и прогнозируемой ошибке в невидимых данных из-за переобучения.

Контролируемые нейронные сети, использующие функцию стоимости среднеквадратической ошибки (MSE), могут использовать формальные статистические методы для определения достоверности обученной модели. MSE в наборе проверки можно использовать в качестве оценки дисперсии. Затем это значение можно использовать для расчета доверительного интервала выходных данных сети, предполагая нормальное распределение . Проведенный таким образом доверительный анализ является статистически достоверным до тех пор, пока распределение выходных вероятностей остается прежним и сеть не изменяется.

Присвоив функцию активации softmax , обобщение логистической функции , на выходном слое нейронной сети (или компоненту softmax в сети, основанной на компонентах) для категориальных целевых переменных, выходные данные можно интерпретировать как апостериорные вероятности. Это полезно при классификации, поскольку дает меру достоверности классификаций.

Функция активации softmax:

Критика

[ редактировать ]Обучение

[ редактировать ]Распространенная критика нейронных сетей, особенно в робототехнике, заключается в том, что им требуется слишком много обучающих выборок для реальной работы. [221] Любая обучающаяся машина нуждается в достаточном количестве репрезентативных примеров, чтобы уловить основную структуру, позволяющую обобщать ее на новые случаи. Потенциальные решения включают случайное перетасовывание обучающих примеров с использованием алгоритма числовой оптимизации, который не делает слишком больших шагов при изменении сетевых подключений по примеру, группировку примеров в так называемые мини-пакеты и/или введение рекурсивного алгоритма наименьших квадратов для CMAC. . [149] Дин Померло использует нейронную сеть для обучения роботизированного транспортного средства езде по нескольким типам дорог (однополосные, многополосные, грунтовые и т. д.), и большой объем его исследований посвящен экстраполяции нескольких сценариев обучения на основе одного обучения. опыт и сохранение разнообразия прошлых тренировок, чтобы система не перетренировалась (если, например, ей предлагается серия поворотов направо — она не должна учиться всегда поворачивать направо). [222]

Теория

[ редактировать ]Центральная претензия [ нужна ссылка ] ИНС заключается в том, что они воплощают в себе новые и мощные общие принципы обработки информации. Эти принципы нечетко определены. Часто утверждают [ кем? ] что они возникают из самой сети. Это позволяет описать простую статистическую ассоциацию (основную функцию искусственных нейронных сетей) как обучение или распознавание. В 1997 году Александр Дьюдни , бывший обозреватель Scientific American , заметил, что в результате искусственные нейронные сети приобретают «качество «что-то ради ничего», которое придает особую ауру лени и явное отсутствие любопытства по поводу того, насколько хороши эти сети. вычислительные системы не вмешиваются; решения находятся как по волшебству, и никто, кажется, ничему не научился». [223] Один из ответов Дьюдни заключается в том, что нейронные сети успешно используются для решения многих сложных и разнообразных задач, начиная от автономного управления самолетом [224] от обнаружения мошенничества с кредитными картами до овладения игрой в го .

Писатель-технолог Роджер Бриджмен прокомментировал:

Нейронные сети, например, находятся на скамье подсудимых не только потому, что их разрекламировали до небес (а что нет?), но и потому, что вы можете создать успешную сеть, не понимая, как она работает: набор чисел, фиксирующих ее поведение, по всей вероятности, будет «непрозрачной, нечитаемой таблицей… бесполезной как научный ресурс».

Несмотря на свое решительное заявление о том, что наука — это не технология, Дьюдни, похоже, выставляет нейронные сети к позорному столбу как плохую науку, тогда как большинство из тех, кто их разрабатывает, просто пытаются быть хорошими инженерами. Нечитаемая таблица, которую может прочитать полезная машина, все равно стоит иметь. [225]

Хотя это правда, что анализировать то, что было изучено искусственной нейронной сетью, сложно, сделать это гораздо проще, чем анализировать то, что было изучено биологической нейронной сетью. Более того, недавний акцент на объяснимости ИИ способствовал развитию методов, особенно основанных на механизмах внимания , для визуализации и объяснения изученных нейронных сетей. Более того, исследователи, изучающие алгоритмы обучения нейронных сетей, постепенно раскрывают общие принципы, которые позволяют обучающимся машинам быть успешными. Например, Бенджио и ЛеКун (2007) написали статью о локальном и нелокальном обучении, а также о поверхностной и глубокой архитектуре. [226]

Биологический мозг использует как поверхностные, так и глубокие цепи, как сообщает анатомия мозга. [227] демонстрируя широкий спектр инвариантности. Венг [228] утверждал, что мозг самостоятельно подключается в основном в соответствии со статистикой сигналов, и поэтому последовательный каскад не может уловить все основные статистические зависимости.

Аппаратное обеспечение

[ редактировать ]Большие и эффективные нейронные сети требуют значительных вычислительных ресурсов. [229] Хотя в мозгу есть аппаратное обеспечение, предназначенное для обработки сигналов через граф нейронов, моделирование даже упрощенного нейрона на архитектуре фон Неймана может потребовать огромных объемов памяти и хранилища. Более того, разработчику часто приходится передавать сигналы через многие из этих соединений и связанных с ними нейронов, что требует огромной мощности процессора и времени.

Шмидхубер отметил, что возрождение нейронных сетей в двадцать первом веке во многом связано с достижениями в области аппаратного обеспечения: с 1991 по 2015 год вычислительная мощность, особенно с помощью GPGPU (на графических процессорах ), увеличилась примерно в миллион раз, в результате чего стандартный алгоритм обратного распространения ошибки возможен для обучающих сетей, которые находятся на несколько уровней глубже, чем раньше. [26] Использование ускорителей, таких как FPGA и GPU, может сократить время обучения с месяцев до дней. [229]

Нейроморфная инженерия или физическая нейронная сеть напрямую решают аппаратные трудности, создавая чипы, не относящиеся к фон Нейману, для непосредственной реализации нейронных сетей в схемах. Другой тип чипа, оптимизированный для обработки нейронных сетей, называется тензорным процессором или TPU. [230]

Практические контрпримеры

[ редактировать ]Анализировать то, что было изучено ИНС, гораздо проще, чем анализировать то, что было изучено биологической нейронной сетью. Более того, исследователи, изучающие алгоритмы обучения нейронных сетей, постепенно раскрывают общие принципы, которые позволяют обучающимся машинам быть успешными. Например, локальное и нелокальное обучение и поверхностная и глубокая архитектура. [231]

Гибридные подходы

[ редактировать ]Сторонники гибридных моделей (объединяющих нейронные сети и символические подходы) говорят, что такая смесь может лучше отразить механизмы человеческого разума. [232] [233]

Смещение набора данных

[ редактировать ]Нейронные сети зависят от качества данных, на которых они обучаются, поэтому данные низкого качества с несбалансированной репрезентативностью могут привести к обучению модели и закреплению социальных предубеждений. [234] [235] Эти унаследованные предубеждения становятся особенно критичными, когда ИНС интегрируются в реальные сценарии, где обучающие данные могут быть несбалансированными из-за нехватки данных для конкретной расы, пола или другого признака. [234] Этот дисбаланс может привести к тому, что модель будет иметь неадекватное представление и понимание недостаточно представленных групп, что приведет к дискриминационным результатам, которые усугубят социальное неравенство, особенно в таких приложениях, как распознавание лиц , процессы найма и правоохранительная деятельность . [235] [236] Например, в 2018 году Amazon пришлось отказаться от инструмента подбора персонала, потому что модель отдавала предпочтение мужчинам, а не женщинам на должностях в области разработки программного обеспечения из-за большего количества работников-мужчин в этой области. [236] Программа будет наказывать любое резюме со словом «женщина» или названием любого женского колледжа. Однако использование синтетических данных может помочь уменьшить предвзятость набора данных и повысить представленность в наборах данных. [237]

Галерея

[ редактировать ]-

Однослойная искусственная нейронная сеть прямого распространения. Стрелки, исходящие из опущены для ясности. Эта сеть имеет p входов и q выходов. В этой системе значение q-го выхода, , рассчитывается как

-

Двухслойная искусственная нейронная сеть прямого распространения

-

Искусственная нейронная сеть

-

Граф зависимости ИНС

-

Однослойная искусственная нейронная сеть прямого распространения с 4 входами, 6 скрытыми узлами и 2 выходами. Учитывая состояние положения и направление, он выводит значения управления на основе колеса.

-

Двухслойная искусственная нейронная сеть прямого распространения с 8 входами, скрытыми узлами 2x8 и 2 выходами. Учитывая состояние положения, направление и другие значения окружающей среды, он выводит управляющие значения на основе подруливающего устройства.

-

Параллельная конвейерная структура нейронной сети CMAC. Этот алгоритм обучения может сходиться за один шаг.

Последние достижения и будущие направления

[ редактировать ]Искусственные нейронные сети (ИНС) претерпели значительные усовершенствования, особенно в их способности моделировать сложные системы, обрабатывать большие наборы данных и адаптироваться к различным типам приложений. Их эволюция за последние несколько десятилетий была отмечена широким спектром приложений в таких областях, как обработка изображений, распознавание речи, обработка естественного языка, финансы и медицина.

Обработка изображений

[ редактировать ]В области обработки изображений ИНС используются в таких задачах, как классификация изображений, распознавание объектов и сегментация изображений. Например, глубокие сверточные нейронные сети (CNN) сыграли важную роль в распознавании рукописных цифр, обеспечив современную производительность. [238] Это демонстрирует способность ИНС эффективно обрабатывать и интерпретировать сложную визуальную информацию, что приводит к прогрессу в самых разных областях: от автоматического наблюдения до медицинской визуализации. [238]

Распознавание речи

[ редактировать ]Моделируя речевые сигналы, ИНС используются для таких задач, как идентификация говорящего и преобразование речи в текст. Архитектура глубоких нейронных сетей внесла значительные улучшения в распознавание непрерывной речи с большим словарным запасом, превосходя традиционные методы. [238] [239] Эти достижения позволили разработать более точные и эффективные системы с голосовым управлением, улучшающие пользовательские интерфейсы в технологических продуктах.

Обработка естественного языка

[ редактировать ]При обработке естественного языка ИНС используются для таких задач, как классификация текста, анализ настроений и машинный перевод. Они позволили разработать модели, которые могут точно переводить между языками, понимать контекст и тональность текстовых данных, а также классифицировать текст на основе содержания. [238] [239] Это имеет значение для автоматизированного обслуживания клиентов, модерации контента и технологий понимания языка.

Системы управления

[ редактировать ]В области систем управления ИНС используются для моделирования динамических систем для таких задач, как идентификация системы, проектирование управления и оптимизация. Например, нейронные сети глубокого прямого распространения важны в приложениях идентификации и управления системами.

Финансы

[ редактировать ]ИНС используются для прогнозирования фондового рынка и кредитного скоринга :

- При инвестировании ИНС могут обрабатывать огромные объемы финансовых данных, распознавать сложные закономерности и прогнозировать тенденции фондового рынка, помогая инвесторам и риск-менеджерам принимать обоснованные решения. [238]

- В кредитном скоринге ИНС предлагают персонализированную оценку кредитоспособности на основе данных, повышая точность прогнозов дефолта и автоматизируя процесс кредитования. [239]

ИНС требуют высококачественных данных и тщательной настройки, а их природа «черного ящика» может создавать проблемы при интерпретации. Тем не менее, продолжающиеся достижения позволяют предположить, что ИНС продолжают играть роль в финансах, предлагая ценную информацию и улучшая стратегии управления рисками .

Лекарство

[ редактировать ]ИНС способны обрабатывать и анализировать огромные наборы медицинских данных. Они повышают точность диагностики, особенно за счет интерпретации сложных медицинских изображений для раннего выявления заболеваний и прогнозирования результатов лечения пациентов для индивидуального планирования лечения. [239] При открытии лекарств ИНС ускоряют идентификацию потенциальных кандидатов на лекарства и прогнозируют их эффективность и безопасность, значительно сокращая время и затраты на разработку. [238] Кроме того, их применение в персонализированной медицине и анализе данных здравоохранения позволяет разрабатывать индивидуальные методы лечения и эффективно управлять уходом за пациентами. [239] Продолжающиеся исследования направлены на решение остающихся проблем, таких как конфиденциальность данных и интерпретируемость моделей, а также расширение сферы применения ИНС в медицине.

Создание контента

[ редактировать ]ИНС, такие как генеративно-состязательные сети ( GAN ) и преобразователи, используются для создания контента во многих отраслях. [240] Это связано с тем, что модели глубокого обучения способны изучать стиль художника или музыканта на основе огромных наборов данных и создавать совершенно новые произведения искусства и музыкальные композиции. Например, DALL-E — это глубокая нейронная сеть, обученная на 650 миллионах пар изображений и текстов в Интернете, которая может создавать произведения искусства на основе текста, введенного пользователем. [241] В области музыки трансформеры используются для создания оригинальной музыки для рекламных роликов и документальных фильмов такими компаниями, как AIVA и Jukedeck . [242] В маркетинговой индустрии генеративные модели используются для создания персонализированной рекламы для потребителей. [240] Кроме того, крупные кинокомпании сотрудничают с технологическими компаниями для анализа финансового успеха фильма, например, партнерство между Warner Bros и технологической компанией Cinelytic, основанное в 2020 году. [243] Кроме того, нейронные сети нашли применение при создании видеоигр, где неигровые персонажи (NPC) могут принимать решения на основе всех персонажей, находящихся в данный момент в игре. [244]

См. также

[ редактировать ]- АДАЛИН

- Автоэнкодер

- Биологические вычисления

- Проект Голубого Мозга

- Катастрофическое вмешательство

- Когнитивная архитектура

- Коннекционистская экспертная система

- Коннектомика

- Глубокое изображение до

- Цифровой морфогенез

- Эффективно обновляемая нейронная сеть

- Эволюционный алгоритм

- Генетический алгоритм

- Гиперпространственные вычисления

- Адаптивное табулирование на месте

- Большие ограничения ширины нейронных сетей

- Список концепций машинного обучения

- Мемристор

- Нейронный газ

- Программное обеспечение для нейронных сетей

- Оптическая нейронная сеть

- Параллельная распределенная обработка

- Философия искусственного интеллекта

- Прогнозная аналитика

- Квантовая нейронная сеть

- Машина опорных векторов

- Пиковая нейронная сеть

- Стохастический попугай

- Тензорная продуктовая сеть

Внешние ссылки

[ редактировать ]- Краткое введение в нейронные сети (Д. Кризель) — иллюстрированная двуязычная рукопись об искусственных нейронных сетях; Темы на данный момент: перцептроны, обратное распространение ошибки, радиальные базисные функции, рекуррентные нейронные сети, самоорганизующиеся карты, сети Хопфилда.

- Обзор нейронных сетей в материаловедении. Архивировано 7 июня 2015 г. в Wayback Machine.

- Учебное пособие по искусственным нейронным сетям на трех языках (Мадридский политехнический университет)

- Еще одно знакомство с ИНС

- Следующее поколение нейронных сетей. Архивировано 24 января 2011 г. в Wayback Machine — Google Tech Talks.

- Производительность нейронных сетей

- Нейронные сети и информация. Архивировано 9 июля 2009 г. в Wayback Machine.

- Сандерсон Дж. (5 октября 2017 г.). «Но что такое нейронная сеть?» . 3Синий1Коричневый . Архивировано из оригинала 7 ноября 2021 года — на YouTube .

Примечания

[ редактировать ]- ↑ Для управления мероприятием « Без рук по всей Америке » 1995 года потребовалось «всего несколько человек».

Ссылки

[ редактировать ]- ^ Хардести Л. (14 апреля 2017 г.). «Объяснение: нейронные сети» . Пресс-служба Массачусетского технологического института. Архивировано из оригинала 18 марта 2024 года . Проверено 2 июня 2022 г.

- ^ Ян З, Ян З (2014). Комплексная биомедицинская физика . Каролинский институт, Стокгольм, Швеция: Elsevier. п. 1. ISBN 978-0-444-53633-4 . Архивировано из оригинала 28 июля 2022 года . Проверено 28 июля 2022 г.

- ^ Епископ К.М. (17 августа 2006 г.). Распознавание образов и машинное обучение . Нью-Йорк: Спрингер. ISBN 978-0-387-31073-2 .

- ^ Перейти обратно: а б Вапник В.Н., Вапник В.Н. (1998). Природа статистической теории обучения (Исправленное 2-е издание). Нью-Йорк Берлин Гейдельберг: Springer. ISBN 978-0-387-94559-0 .

- ^ Перейти обратно: а б Ян Гудфеллоу, Йошуа Бенджио и Аарон Курвиль (2016). Глубокое обучение . МТИ Пресс. Архивировано из оригинала 16 апреля 2016 года . Проверено 1 июня 2016 г.

- ^ Ферри К., Кайзер С. (2019). Нейронные сети для детей . Справочники. ISBN 978-1-4926-7120-6 .

- ^ Мэнсфилд Мерриман, «Список работ, касающихся метода наименьших квадратов»

- ^ Стиглер С.М. (1981). «Гаусс и изобретение метода наименьших квадратов» . Энн. Стат . 9 (3): 465–474. дои : 10.1214/aos/1176345451 .

- ^ Бретчер О (1995). Линейная алгебра с приложениями (3-е изд.). Река Аппер-Седл, Нью-Джерси: Прентис-Холл.

- ^ Перейти обратно: а б с д и ж г час я дж к л Шмидхубер Дж (2022). «Аннотированная история современного искусственного интеллекта и глубокого обучения». arXiv : 2212.11279 [ cs.NE ].

- ^ Стиглер С.М. (1986). История статистики: измерение неопределенности до 1900 года . Кембридж: Гарвард. ISBN 0-674-40340-1 .

- ^ Маккалок В., Уолтер Питтс (1943). «Логическое исчисление идей, имманентных нервной деятельности». Вестник математической биофизики . 5 (4): 115–133. дои : 10.1007/BF02478259 .

- ^ Клини С. (1956). «Представление событий в нервных сетях и конечных автоматах» . Анналы математических исследований . № 34. Издательство Принстонского университета. стр. 3–41. Архивировано из оригинала 19 мая 2024 года . Проверено 17 июня 2017 г.

- ^ Хебб Д. (1949). Организация поведения . Нью-Йорк: Уайли. ISBN 978-1-135-63190-1 .

- ^ Фарли Б., В.А. Кларк (1954). «Моделирование самоорганизующихся систем с помощью цифрового компьютера». IRE Транзакции по теории информации . 4 (4): 76–84. дои : 10.1109/TIT.1954.1057468 .

- ^ Рочестер Н., Дж. Х. Холланд, Л. Х. Хабит и В. Л. Дуда (1956). «Испытания теории сборки клеток действия мозга с использованием большого цифрового компьютера». IRE Транзакции по теории информации . 2 (3): 80–93. дои : 10.1109/TIT.1956.1056810 .

- ^ Хайкин (2008) Нейронные сети и обучающиеся машины, 3-е издание

- ^ Розенблатт Ф (1958). «Перцептрон: вероятностная модель хранения и организации информации в мозге». Психологический обзор . 65 (6): 386–408. CiteSeerX 10.1.1.588.3775 . дои : 10.1037/h0042519 . ПМИД 13602029 . S2CID 12781225 .

- ^ Вербос П (1975). За пределами регрессии: новые инструменты прогнозирования и анализа в поведенческих науках .

- ^ Розенблатт Ф (1957). «Персептрон — воспринимающий и распознающий автомат». Отчет 85-460-1 . Корнеллская авиационная лаборатория.

- ^ Олазаран М (1996). «Социологическое исследование официальной истории спора о перцептронах». Социальные исследования науки . 26 (3): 611–659. дои : 10.1177/030631296026003005 . JSTOR 285702 . S2CID 16786738 .

- ^ Перейти обратно: а б Рассел, Стюарт, Норвиг, Питер (2010). Искусственный интеллект: современный подход (PDF) (3-е изд.). Соединенные Штаты Америки: Pearson Education. стр. 16–28. ISBN 978-0-13-604259-4 .

- ^ Минский М, Паперт С (1969). Перцептроны: введение в вычислительную геометрию . МТИ Пресс. ISBN 978-0-262-63022-1 .

- ^ Перейти обратно: а б Рассел С.Дж., Норвиг П. (2021). Искусственный интеллект: современный подход . Серия Пирсона по искусственному интеллекту. Минг-Вэй Чанг, Джейкоб Девлин, Анка Драган, Дэвид Форсайт, Ян Гудфеллоу, Джитендра Малик, Викаш Мансингка, Джудея Перл, Майкл Дж. Вулдридж (4-е изд.). Хобокен, Нью-Джерси: Пирсон. ISBN 978-0-13-461099-3 .

- ^ Джакалья, врач общей практики (2 ноября 2022 г.). Заставить вещи думать . Холлоуэй. ISBN 978-1-952120-41-1 . Архивировано из оригинала 9 декабря 2023 года . Проверено 29 декабря 2023 г.

- ^ Перейти обратно: а б с Шмидхубер Дж (2015). «Глубокое обучение в нейронных сетях: обзор». Нейронные сети . 61 : 85–117. arXiv : 1404.7828 . дои : 10.1016/j.neunet.2014.09.003 . ПМИД 25462637 . S2CID 11715509 .

- ^ Ивахненко А.Г. (1973). Кибернетические предсказывающие устройства . Информационная корпорация CCM.

- ^ Ивахненко А.Г., Лапа В.Г. (1967). Кибернетика и методы прогнозирования . Американский паб Elsevier. Ко.

- ^ Роббинс Х. , Монро С. (1951). «Метод стохастической аппроксимации» . Анналы математической статистики . 22 (3): 400. дои : 10.1214/aoms/1177729586 .

- ^ Амари С (1967). «Теория адаптивного классификатора шаблонов». IEEE-транзакции . ЕС (16): 279–307.

- ^ Перейти обратно: а б Шмидхубер Дж (2022). «Аннотированная история современного искусственного интеллекта и глубокого обучения». arXiv : 2212.11279 [ cs.NE ].

- ^ Перейти обратно: а б Кохонен Т., Хонкела Т. (2007). «Сеть Кохонена» . Схоларпедия . 2 (1): 1568. Бибкод : 2007SchpJ...2.1568K . doi : 10.4249/scholarpedia.1568 .

- ^ Кохонен Т. (1982). «Самоорганизованное формирование топологически правильных карт признаков». Биологическая кибернетика . 43 (1): 59–69. дои : 10.1007/bf00337288 . S2CID 206775459 .

- ^ Фон дер Мальсбург С (1973). «Самоорганизация ориентационно-чувствительных клеток в полосатой коре». Кибернетик . 14 (2): 85–100. дои : 10.1007/bf00288907 . ПМИД 4786750 . S2CID 3351573 .

- ^ Фукусима К (1980). «Неокогнитрон: самоорганизующаяся модель нейронной сети для механизма распознавания образов, на который не влияет сдвиг положения» (PDF) . Биологическая кибернетика . 36 (4): 193–202. дои : 10.1007/BF00344251 . ПМИД 7370364 . S2CID 206775608 . Архивировано (PDF) из оригинала 3 июня 2014 года . Проверено 16 ноября 2013 г.

- ^ Фукусима К (1969 г.). «Визуальное извлечение признаков с помощью многослойной сети аналоговых пороговых элементов». Транзакции IEEE по системным наукам и кибернетике . 5 (4): 322–333. дои : 10.1109/TSSC.1969.300225 .

- ^ Рамачандран П., Баррет З., Куок В.Л. (16 октября 2017 г.). «Поиск функций активации». arXiv : 1710.05941 [ cs.NE ].

- ^ Лейбниц Г.В. (1920). Ранние математические рукописи Лейбница: перевод с латинских текстов, опубликованных Карлом Иммануэлем Герхардтом с критическими и историческими примечаниями (Лейбниц опубликовал цепное правило в мемуарах 1676 года) . Издательство «Открытый суд». ISBN 978-0-598-81846-1 . Архивировано из оригинала 19 мая 2024 года . Проверено 1 апреля 2023 г.

- ^ Линнаинмаа С (1970). Представление совокупной ошибки округления алгоритма в виде разложения Тейлора локальных ошибок округления (Мастерс) (на финском языке). Университет Хельсинки. стр. 6–7.

- ^ Линнаинмаа С (1976). «Разложение Тейлора накопленной ошибки округления». БИТ Численная математика . 16 (2): 146–160. дои : 10.1007/bf01931367 . S2CID 122357351 .

- ^ Гриванк А. (2012). «Кто изобрел обратный способ дифференциации?». Истории оптимизации . Documenta Matematica, Дополнительный том ISMP. стр. 389–400. S2CID 15568746 .

- ^ Гриванк А., Вальтер А. (2008). Оценка производных: принципы и методы алгоритмического дифференцирования, второе издание . СИАМ. ISBN 978-0-89871-776-1 .

- ^ Розенблатт Ф (1962). Принципы нейродинамики . Спартан, Нью-Йорк.

- ^ Келли Х.Дж. (1960). «Градиентная теория оптимальных траекторий полета». Журнал АРС . 30 (10): 947–954. дои : 10.2514/8.5282 .

- ^ «Градиентный метод оптимизации многоэтапных процессов распределения». Труды Гарвардского университета. Симпозиум по цифровым вычислительным машинам и их приложениям . Апрель 1961 года.

- ^ Перейти обратно: а б с Шмидхубер Дж (2015). «Глубокое обучение» . Схоларпедия . 10 (11): 85–117. Бибкод : 2015SchpJ..1032832S . doi : 10.4249/scholarpedia.32832 .

- ^ Дрейфус С.Е. (1 сентября 1990 г.). «Искусственные нейронные сети, обратное распространение ошибки и процедура градиента Келли-Брайсона». Журнал руководства, контроля и динамики . 13 (5): 926–928. Бибкод : 1990JGCD...13..926D . дои : 10.2514/3.25422 . ISSN 0731-5090 .

- ^ Мизутани Э., Дрейфус С. , Нишио К. (2000). «О выводе обратного распространения ошибки MLP из формулы градиента оптимального управления Келли-Брайсона и ее применении». Материалы Международной совместной конференции IEEE-INNS-ENNS по нейронным сетям. IJCNN 2000. Нейронные вычисления: новые вызовы и перспективы нового тысячелетия . IEEE. С. 167–172 т.2. дои : 10.1109/ijcnn.2000.857892 . ISBN 0-7695-0619-4 . S2CID 351146 .

- ^ Дрейфус С. (1973). «Вычислительное решение задач оптимального управления с запаздыванием». Транзакции IEEE при автоматическом управлении . 18 (4): 383–385. дои : 10.1109/tac.1973.1100330 .

- ^ Вербос П (1982). «Применение достижений нелинейного анализа чувствительности» (PDF) . Системное моделирование и оптимизация . Спрингер. стр. 762–770. Архивировано (PDF) из оригинала 14 апреля 2016 г. Проверено 2 июля 2017 г.

- ^ Дэвид Э. Румельхарт, Джеффри Э. Хинтон и Рональд Дж. Уильямс, « Изучение представлений с помощью ошибок обратного распространения. Архивировано 8 марта 2021 года в Wayback Machine », Nature , 323, страницы 533–536, 1986.

- ^ Кисть С.Г. (1967). «История модели Ленца-Изинга». Обзоры современной физики . 39 (4): 883–893. Бибкод : 1967РвМП...39..883Б . дои : 10.1103/RevModPhys.39.883 .

- ^ Амари С.И. (1972). «Обучение шаблонам и последовательностям шаблонов с помощью самоорганизующихся сетей пороговых элементов». IEEE-транзакции . С (21): 1197–1206.

- ^ Барт П.Ф. (1981). Кооперативность и переходное поведение больших нейронных сетей (дипломная работа). Берлингтон: Университет Вермонта. OCLC 8231704 .

- ^ Кризан Дж., Барт П. , Глассер М. (1983). «Точные фазовые переходы для модели Изинга на замкнутом дереве Кэли». Физика . 119А . Издательство Северной Голландии: 230–242. дои : 10.1016/0378-4371(83)90157-7 .

- ^ Глассер М., Голдберг М. (1983), «Модель Изинга на замкнутом дереве Кэли», Physica , 117A (2–3): 670–672, Бибкод : 1983PhyA..117..670G , doi : 10.1016/0378-4371 (83)90138-3

- ^ Хопфилд Джей-Джей (1982). «Нейронные сети и физические системы с возникающими коллективными вычислительными способностями» . Труды Национальной академии наук . 79 (8): 2554–2558. Бибкод : 1982PNAS...79.2554H . дои : 10.1073/pnas.79.8.2554 . ПМЦ 346238 . ПМИД 6953413 .

- ^ Вайбель А. (декабрь 1987 г.). Распознавание фонем с использованием нейронных сетей с задержкой . Заседание Института инженеров по электротехнике, информатике и связи (IEICE). Токио, Япония.

- ^ Александр Вайбель и др., Распознавание фонем с использованием нейронных сетей с задержкой. Архивировано 25 февраля 2021 г. в Wayback Machine IEEE Transactions on Acoustics, Speech and Signal Processing, Том 37, № 3, стр. 328. – 339, март 1989 г.

- ^ Чжан В (1988). «Сдвиг-инвариантная нейронная сеть распознавания образов и ее оптическая архитектура» . Материалы ежегодной конференции Японского общества прикладной физики . Архивировано из оригинала 23 июня 2020 года . Проверено 12 апреля 2023 г.

- ^ Чжан В (1990). «Модель параллельной распределенной обработки с локальными пространственно-инвариантными соединениями и ее оптическая архитектура» . Прикладная оптика . 29 (32): 4790–7. Бибкод : 1990ApOpt..29.4790Z . дои : 10.1364/AO.29.004790 . ПМИД 20577468 . Архивировано из оригинала 6 февраля 2017 года . Проверено 12 апреля 2023 г.

- ^ ЛеКун и др. , «Обратное распространение ошибки, примененное к распознаванию рукописного почтового индекса», Neural Computation , 1, стр. 541–551, 1989.

- ^ Дж. Венг, Н. Ахуджа и Т. С. Хуанг, « Кресцептрон: самоорганизующаяся нейронная сеть, которая растет адаптивно. Архивировано 21 сентября 2017 г. в Wayback Machine », Proc. Международная совместная конференция по нейронным сетям , Балтимор, Мэриленд, том I, стр. 576–581, июнь 1992 г.

- ^ Дж. Венг, Н. Ахуджа и Т. С. Хуанг, « Обучение распознаванию и сегментации трехмерных объектов из двумерных изображений. Архивировано 21 сентября 2017 г. в Wayback Machine », Proc. 4-я Международная конференция. Computer Vision , Берлин, Германия, стр. 121–128, май 1993 г.

- ^ Дж. Венг, Н. Ахуджа и Т. С. Хуанг, « Обучение распознаванию и сегментации с использованием кресцептрона. Архивировано 25 января 2021 года в Wayback Machine », International Journal of Computer Vision , vol. 25, нет. 2, стр. 105–139, ноябрь 1997 г.

- ^ ЛеКун И, Леон Ботту, Йошуа Бенджио, Патрик Хаффнер (1998). «Градиентное обучение, применяемое для распознавания документов» (PDF) . Труды IEEE . 86 (11): 2278–2324. CiteSeerX 10.1.1.32.9552 . дои : 10.1109/5.726791 . S2CID 14542261 . Архивировано (PDF) из оригинала 15 декабря 2017 года . Проверено 7 октября 2016 г.

- ^ Цянь, Нин и Терренс Дж. Сейновски. «Предсказание вторичной структуры глобулярных белков с использованием моделей нейронных сетей». Журнал молекулярной биологии 202, вып. 4 (1988): 865-884.

- ^ Бор, Хенрик, Якоб Бор, Сёрен Брунак, Родни М. Дж. Коттерилл, Бенни Лаутруп, Лейф Норсков, Оле Х. Олсен и Штеффен Б. Петерсен. «Вторичная структура белка и гомология нейронных сетей. α-спирали в родопсине». Письма ФЭБС 241, (1988): 223-228.

- ^ Рост, Буркхард и Крис Сандер. «Предсказание вторичной структуры белка с точностью более 70%». Журнал молекулярной биологии 232, вып. 2 (1993): 584-599.

- ^ Перейти обратно: а б С. Хохрейтер, « Исследования динамических нейронных сетей. Архивировано 6 марта 2015 г. в Wayback Machine », Дипломная работа. Институт компьютерных наук Технического университета Мюнхен. Советник: Дж. Шмидхубер , 1991 г.

- ^ Хохрайтер С. и др. (15 января 2001 г.). «Градиентный поток в рекуррентных сетях: сложность изучения долгосрочных зависимостей» . Колен Дж. Ф., Кремер СК (ред.). Полевое руководство по динамическим рекуррентным сетям . Джон Уайли и сыновья. ISBN 978-0-7803-5369-5 . Архивировано из оригинала 19 мая 2024 года . Проверено 26 июня 2017 г.

- ^ Шмидхубер Дж (1991). «Возможность реализовать любопытство и скуку в нейронных контроллерах для построения моделей». Учеб. САБ'1991 . MIT Press/Брэдфорд Букс. стр. 222–227.

- ^ Шмидхубер Дж (2010). «Формальная теория творчества, веселья и внутренней мотивации (1990–2010)». Транзакции IEEE по автономному умственному развитию . 2 (3): 230–247. дои : 10.1109/TAMD.2010.2056368 . S2CID 234198 .

- ^ Шмидхубер Дж (2020). «Генераторно-состязательные сети представляют собой особые случаи искусственного любопытства (1990), а также тесно связаны с минимизацией предсказуемости (1991)». Нейронные сети . 127 : 58–66. arXiv : 1906.04493 . doi : 10.1016/j.neunet.2020.04.008 . ПМИД 32334341 . S2CID 216056336 .