Многомерное нормальное распределение

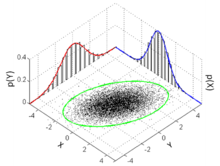

Функция плотности вероятности  Многие точки выборки из многомерного нормального распределения с и , показанный вместе с 3-сигмовым эллипсом, двумя маргинальными распределениями и двумя одномерными гистограммами. | |||

| Обозначения | |||

|---|---|---|---|

| Параметры | ц € Р к - расположение Σ ∈ R к × к — ковариация ( положительная полуопределенная матрица ) | ||

| Поддерживать | x ∈ µ + span( ) ⊆ R к | ||

существует только тогда, когда Σ положительно определена | |||

| Иметь в виду | м | ||

| Режим | м | ||

| Дисперсия | С | ||

| Энтропия | |||

| МГФ | |||

| CF | |||

| Расхождение Кульбака – Лейблера | См. § Расхождение Кульбака – Лейблера. | ||

В теории вероятностей и статистике многомерное нормальное распределение , многомерное распределение Гаусса или совместное нормальное распределение является обобщением одномерного ( одномерного ) нормального распределения на более высокие измерения . Одно из определений состоит в том, что случайный вектор называется нормально распределенным с k -мерными значениями, если каждая линейная комбинация его k компонентов имеет одномерное нормальное распределение. Его важность проистекает главным образом из многомерной центральной предельной теоремы . Многомерное нормальное распределение часто используется для описания, по крайней мере приблизительно, любого набора (возможно) коррелированных действительных случайных величин , каждая из которых группируется вокруг среднего значения.

Определения [ править ]

Обозначения и параметризация [ править ]

Многомерное нормальное распределение k -мерного случайного вектора можно записать в следующих обозначениях:

или чтобы явно было известно, что X является k -мерным,

с k -мерным средним вектором

такой, что и . Обратная и ковариационная матрица называется матрицей точности обозначается .

Стандартный нормальный случайный вектор [ править ]

Настоящий случайный вектор называется стандартным нормальным случайным вектором, если все его компоненты независимы и каждая представляет собой нормально распределенную случайную величину с нулевой средней единичной дисперсией, т.е. если для всех . [1] : с. 454

Центрированный нормальный случайный вектор [ править ]

Настоящий случайный вектор называется центрированным нормальным случайным вектором, если существует детерминированный матрица такой, что имеет то же распределение, что и где — стандартный нормальный случайный вектор с компоненты. [1] : с. 454

Нормальный случайный вектор [ править ]

Настоящий случайный вектор называется нормальным случайным вектором, если существует случайный -вектор , который представляет собой стандартный нормальный случайный вектор, a -вектор и матрица , такой, что . [2] : с. 454 [1] : с. 455

Формально:

Здесь матрица ковариационная .

В вырожденном случае, когда ковариационная матрица сингулярна , соответствующее распределение не имеет плотности; см . в разделе ниже подробности . Этот случай часто возникает в статистике ; например, в распределении вектора остатков в обычной регрессии наименьших квадратов . в целом не являются независимыми; их можно рассматривать как результат применения матрицы к набору независимых гауссовских переменных .

определения Эквивалентные

Следующие определения эквивалентны определению, данному выше. Случайный вектор имеет многомерное нормальное распределение, если оно удовлетворяет одному из следующих эквивалентных условий.

- Любая линейная комбинация его компонентов нормально распределены . То есть для любого постоянного вектора , случайная величина имеет одномерное нормальное распределение, где одномерное нормальное распределение с нулевой дисперсией представляет собой точечную массу в своем среднем значении.

- Существует k -вектор и симметричный положительно полуопределенный матрица , такой, что характеристическая функция является

Сферическое нормальное распределение можно охарактеризовать как уникальное распределение, компоненты которого независимы в любой ортогональной системе координат. [3] [4]

Функция плотности [ править ]

Невырожденный случай [ править ]

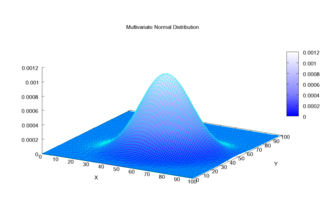

Многомерное нормальное распределение называется «невырожденным», если симметричная ковариационная матрица является положительно определенным . В этом случае распределение имеет плотность [5]

где является действительным k -мерным вектором-столбцом и является определяющим фактором , также известный как обобщенная дисперсия . Приведенное выше уравнение сводится к уравнению одномерного нормального распределения, если это матрица (т.е. одно действительное число).

Циркулярно-симметричная версия комплексного нормального распределения имеет несколько иную форму.

изоплотности Каждый локус — локус точек в k -мерном пространстве, каждая из которых дает одно и то же конкретное значение плотности — представляет собой эллипс или его многомерное обобщение; следовательно, многомерная нормаль является частным случаем эллиптических распределений .

Количество известно как расстояние Махаланобиса , которое представляет собой расстояние до контрольной точки. от среднего . Обратите внимание, что в случае, когда , распределение сводится к одномерному нормальному распределению, а расстояние Махаланобиса сводится к абсолютному значению стандартного балла . См. также Интервал ниже.

Двумерный случай [ править ]

В двумерном неособом случае ( ), функция плотности вероятности вектора является:

В двумерном случае первое эквивалентное условие многомерного восстановления нормальности можно сделать менее ограничительным, поскольку достаточно проверить, что счетное множество различных линейных комбинаций и нормальны, чтобы заключить, что вектор является двумерным нормальным. [6]

Двумерные локусы изоплотности, нанесенные на графике -плоскостью являются эллипсы , главные оси которых определяются собственными векторами ковариационной матрицы (большой и малый полудиаметры эллипса равны квадратному корню из упорядоченных собственных значений).

Поскольку абсолютное значение параметра корреляции увеличивается, эти локусы сжимаются к следующей линии:

Это потому, что это выражение, с (где Sign — функция Sign ), замененная на , является лучшим линейным несмещенным прогнозом учитывая значение . [7]

Вырожденный случай [ править ]

Если ковариационная матрица не является полным рангом, то многомерное нормальное распределение вырождено и не имеет плотности. Точнее, он не имеет плотности по отношению к k -мерной мере Лебега (которая является обычной мерой, принимаемой в курсах вероятностей на уровне исчисления). Говорят , что только случайные векторы, распределения которых абсолютно непрерывны относительно меры, имеют плотность (относительно этой меры). Чтобы говорить о плотностях, но не иметь дело с теоретико-мерными сложностями, проще ограничить внимание подмножеством координат такая, что ковариационная матрица для этого подмножества является положительно определенной; тогда другие координаты можно рассматривать как аффинную функцию этих выбранных координат. [8]

Чтобы осмысленно говорить о плотности в особых случаях, мы должны выбрать другую базовую меру. Используя теорему дезинтеграции, мы можем определить ограничение меры Лебега на -мерное аффинное подпространство где поддерживается распределение Гаусса, т.е. . По этой мере распределение имеет плотность следующего мотива:

где является обобщенным обратным и является псевдодетерминантом . [9]

распределения Кумулятивная функция

Понятие кумулятивной функции распределения (cdf) в измерении 1 можно расширить двумя способами на многомерный случай, основанный на прямоугольных и эллипсоидальных областях.

Первый способ — определить cdf случайного вектора как вероятность того, что все компоненты меньше или равны соответствующим значениям в векторе : [10]

Хотя закрытой формы для , существует ряд алгоритмов, которые оценивают его численно . [10] [11]

Другой способ - определить cdf как вероятность того, что образец находится внутри эллипсоида, определяемая его расстоянием Махаланобиса от гауссовой, прямого обобщения стандартного отклонения. [12] Для вычисления значений этой функции существуют замкнутые аналитические формулы: [12] следующее.

Интервал [ править ]

Интервал x многомерного нормального распределения дает область, состоящую из тех векторов , которые удовлетворяют

Здесь это -мерный вектор, это известный -мерный средний вектор, - известная ковариационная матрица и - функция квантиля вероятности распределения хи-квадрат с степени свободы. [13] Когда выражение определяет внутреннюю часть эллипса, а распределение хи-квадрат упрощается до экспоненциального распределения со средним значением, равным двум (скорость равна половине).

функция распределения (хвостовое распределение кумулятивная ) Дополнительная

Дополнительная кумулятивная функция распределения (ccdf) или хвостовое распределение. определяется как . Когда , затемccdf можно записать как вероятность максимума зависимых гауссовских переменных: [14]

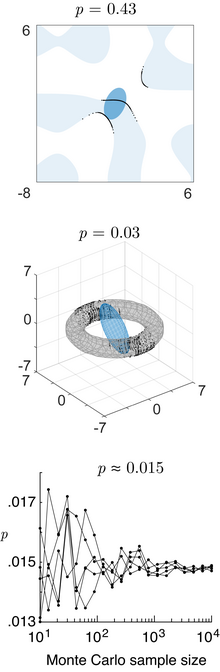

Хотя простой замкнутой формулы для вычисления ccdf не существует, максимум зависимых гауссовских переменных может быть быть точно оценен с помощью метода Монте-Карло . [14] [15]

Свойства [ править ]

Вероятность в разных областях [ править ]

Вероятностное содержание многомерной нормали в квадратичной области, определяемое формулой (где это матрица, является вектором, и является скаляром), который важен для байесовской классификации/теории принятия решений с использованием гауссовского дискриминантного анализа, определяется обобщенным распределением хи-квадрат . [16] Содержимое вероятности в любой общей области, определяемой формулой (где — общая функция) можно вычислить с помощью численного метода трассировки лучей [16] ( код Матлаба ).

Высшие моменты [ править ]

Моменты k порядка - го по x определяются выражением

где р 1 + р 2 + ⋯ + р N знак равно k .

Центральные моменты k -го порядка следующие:

- Если k нечетно, µ 1, …, N ( x - µ ) знак равно 0 .

- Если k четно с k = 2 λ , то [ двусмысленный ]

где сумма берется по всем распределениям набора на λ (неупорядоченные) пары. То есть для k -го (= 2 λ = 6) центрального момента суммируются произведения ковариаций λ = 3 (в интересах экономии ожидаемое значение µ принимается равным 0):

Это дает члены в сумме (15 в приведенном выше случае), каждое из которых является произведением ковариаций λ (в данном случае 3). Для моментов четвертого порядка (четыре переменные) имеется три члена. Для моментов шестого порядка имеется 3 × 5 = 15 членов, а для моментов восьмого порядка — 3 × 5 × 7 = 105 членов.

Затем ковариации определяются путем замены членов списка соответствующими членами списка, состоящего из r 1 единиц, затем r 2 двоек и т. д. Чтобы проиллюстрировать это, рассмотрим следующий случай центрального момента 4-го порядка:

где — ковариация X i и X j . С помощью описанного выше метода сначала находится общий случай для k -го момента с k различными X- переменными: , а затем это соответственно упрощается. Например, для , положим X i = X j и воспользуемся тем фактом, что .

Функции нормального вектора [ править ]

Квадратичная форма нормального вектора , (где это матрица, является вектором, и является скаляром), является обобщенной переменной хи-квадрат . [16] Направление вектора нормали соответствует прогнозируемому нормальному распределению . [17]

Если — это общая скалярная функция нормального вектора, ее функция плотности вероятности , кумулятивная функция распределения и обратная кумулятивная функция распределения могут быть вычислены с помощью численного метода трассировки лучей ( код Matlab ). [16]

Функция правдоподобия [ править ]

Если известны среднее значение и ковариационная матрица, логарифмическая вероятность наблюдаемого вектора это просто журнал функции плотности вероятности :

- ,

Циркулярно-симметричный вариант нецентрального комплексного случая, когда вектор комплексных чисел, будет

т.е. с сопряженным транспонированием (обозначенным ), заменяя обычное транспонирование (обозначается ). Это немного отличается от реального случая, поскольку циркулярно-симметричная версия комплексного нормального распределения имеет несколько иной вид константы нормализации .

Аналогичные обозначения используются для множественной линейной регрессии . [18]

Поскольку логарифмическая вероятность нормального вектора представляет собой квадратичную форму нормального вектора, она распределяется как обобщенная переменная хи-квадрат . [16]

Дифференциальная энтропия [ править ]

Дифференциальная энтропия многомерного нормального распределения равна [19]

,

где столбцы обозначают определитель матрицы , k — размерность векторного пространства, а результат имеет единицы измерения nats .

Кульбака Лейблера Расхождение –

Расхождение Кульбака –Лейблера от к для неособых матриц Σ 1 и Σ 0 равно: [20]

где обозначает определитель матрицы , это след , натуральный логарифм и — размерность векторного пространства.

Логарифм поскольку необходимо брать по основанию e, два члена, следующие за логарифмом, сами являются логарифмами по основанию e выражений, которые либо являются факторами функции плотности, либо возникают естественным образом. Таким образом, уравнение дает результат, измеряемый в натс . Разделив все приведенное выше выражение на log e 2, получим расхождение в битах .

Когда ,

Взаимная информация [ править ]

Взаимная информация распределения представляет собой частный случай расхождения Кульбака – Лейблера , в котором полное многомерное распределение и является продуктом одномерных предельных распределений. В обозначениях раздела о расходимости Кульбака – Лейблера этой статьи: представляет собой диагональную матрицу с диагональными элементами , и . Итоговая формула взаимной информации:

где – корреляционная матрица, построенная из . [21]

В двумерном случае выражение взаимной информации имеет вид:

Нормальность суставов [ править ]

Нормально распределенные и независимые [ править ]

Если и нормально распределены и независимы , это означает, что они «совместно нормально распределены», т. е. пара должно иметь многомерное нормальное распределение. Однако пара совместно нормально распределенных переменных не обязательно должна быть независимой (будет таковой только в том случае, если она некоррелирована, ).

Две нормально распределенные случайные величины не обязательно должны быть совместно нормальными двумерными [ править ]

Тот факт, что две случайные величины и оба имеют нормальное распределение, это не означает, что пара имеет совместное нормальное распределение. Простым примером является тот, в котором X имеет нормальное распределение с ожидаемым значением 0 и дисперсией 1, и если и если , где . Существуют аналогичные контрпримеры для более чем двух случайных величин. В общем, они суммируются в смешанной модели . [ нужна ссылка ]

и независимость Корреляции

В общем, случайные величины могут быть некоррелированными, но статистически зависимыми. Но если случайный вектор имеет многомерное нормальное распределение, то любые два или более его некоррелированных компонента являются независимыми . Это означает, что любые два или более его компонента, попарно независимые, являются независимыми. Но, как указывалось выше, неверно, что две случайные величины, которые ( отдельно , маргинально) нормально распределены и некоррелированы, независимы.

Условные распределения [ править ]

Если N -мерный x разбит следующим образом

и, соответственно, µ и Σ разбиваются следующим образом

тогда распределение x 1 при условии x 2 = a является многомерным нормальным [22] ( Икс 1 | Икс 2 знак равно а ) ~ N ( μ , Σ ) где

и ковариационная матрица

Здесь является обобщенной инверсией . Матрица является дополнением к 22 22 в . Шура То есть приведенное выше уравнение эквивалентно инвертированию общей ковариационной матрицы, удалению строк и столбцов, соответствующих переменным, на которые распространяются условия, и обратному обращению для получения условной ковариационной матрицы.

Обратите внимание, что знание того, что x 2 = a изменяет дисперсию, хотя новая дисперсия не зависит от конкретного значения a ; что еще более удивительно, среднее значение смещается на ; сравните это с ситуацией, когда значение a не известно , и в этом случае x 1 будет иметь распределение .

Интересный факт, полученный для доказательства этого результата, состоит в том, что случайные векторы и независимы.

Матрица Σ 12 Σ 22 −1 известна как матрица коэффициентов регрессии .

Двумерный случай [ править ]

В двумерном случае, когда x разбивается на и , условное распределение данный является [24]

где коэффициент корреляции между и .

Двумерное условное ожидание [ править ]

В общем случае [ править ]

Условное ожидание X 1 при условии X 2 равно:

Доказательство: результат получается, если взять математическое ожидание условного распределения выше.

В центрированном случае с единичными отклонениями [ править ]

Условное ожидание X 1 при условии X 2 равно

и условная дисперсия равна

таким образом, условная дисперсия не зависит от x 2 .

Условное ожидание X 1 при условии, что X 2 меньше/больше z, равно: [25] : 367

где окончательное соотношение здесь называется обратным коэффициентом Миллса .

Доказательство: два последних результата получены с использованием результата , так что

- а затем используя свойства ожидания усеченного нормального распределения .

распределения Маржинальные

Чтобы получить маргинальное распределение по подмножеству многомерных нормальных случайных величин, нужно только исключить нерелевантные переменные (переменные, которые нужно исключить) из среднего вектора и ковариационной матрицы. Доказательство этого следует из определений многомерного нормального распределения и линейной алгебры. [26]

Пример

Пусть X = [ X 1 , X 2 , X 3 ] — многомерные нормальные случайные величины со средним вектором µ = [ µ 1 , µ 2 , µ 3 ] и ковариационной матрицей Σ (стандартная параметризация для многомерных нормальных распределений). Тогда совместное распределение X ' = [ X 1 , X 3 ] является многомерным нормальным со средним вектором µ ' = [ µ 1 , µ 3 ] и ковариационной матрицей .

Аффинное преобразование [ править ]

Если Y = c + BX — преобразование аффинное где c - это вектор констант и B — константа матрица, то Y имеет многомерное нормальное распределение с ожидаемым значением c + Bμ и дисперсией BΣB Т то есть, . В частности, любое подмножество X i имеет предельное распределение, которое также является многомерным нормальным.Чтобы убедиться в этом, рассмотрим следующий пример: чтобы извлечь подмножество ( X 1 , X 2 , X 4 ) Т , использовать

который извлекает нужные элементы напрямую.

Другим следствием является то, что распределение Z = b · X , где b — постоянный вектор с тем же количеством элементов, что и X , а точка указывает скалярное произведение , является одномерным гауссовским с . Этот результат получается при использовании

Обратите внимание, что из положительной определенности Σ следует, что дисперсия скалярного произведения должна быть положительной.

Аффинное преобразование X такое как 2 X, — это не то же самое, что двух независимых реализаций X. , сумма

интерпретация Геометрическая

Контуры эквивалентности неособого многомерного нормального распределения представляют собой эллипсоиды (т.е. аффинные преобразования гиперсфер ) с центром в среднем. [27] Следовательно, многомерное нормальное распределение является примером класса эллиптических распределений . Направления главных осей эллипсоидов задаются собственными векторами ковариационной матрицы . Квадраты относительных длин главных осей задаются соответствующими собственными значениями.

Если Σ = UΛU Т = UΛ 1/2 ( UΛ 1/2 ) Т является собственным разложением , где столбцы U являются единичными собственными векторами, а Λ является диагональной матрицей собственных значений, то мы имеем

Более того, U можно выбрать в качестве матрицы вращения , поскольку инвертирование оси не влияет на N (0, Λ ), но инвертирование столбца меняет знак U. определителя Распределение N ( µ , Σ ) фактически является N (0, I ) масштабированным с помощью Λ 1/2 , повёрнутый U и переведённый на µ .

И наоборот, любой выбор µ , матрицы полного ранга U и положительных диагональных элементов Λ i дает неособое многомерное нормальное распределение. Если любой Λ i равен нулю, а U квадратный, результирующая ковариационная матрица UΛU Т является единичным . Геометрически это означает, что каждый контурный эллипсоид бесконечно тонкий и имеет нулевой объем в n -мерном пространстве, поскольку хотя бы одна из главных осей имеет нулевую длину; это вырожденный случай .

«Радиус вокруг истинного среднего значения двумерной нормальной случайной величины, переписанной в полярных координатах (радиус и угол), соответствует распределению Хойта ». [28]

В одном измерении вероятность найти выборку нормального распределения в интервале составляет примерно 68,27%, но в более высоких размерностях вероятность найти выборку в области эллипса стандартного отклонения ниже. [29]

| Размерность | Вероятность |

|---|---|

| 1 | 0.6827 |

| 2 | 0.3935 |

| 3 | 0.1987 |

| 4 | 0.0902 |

| 5 | 0.0374 |

| 6 | 0.0144 |

| 7 | 0.0052 |

| 8 | 0.0018 |

| 9 | 0.0006 |

| 10 | 0.0002 |

Статистический вывод

Оценка параметров [ править ]

Вывод максимального правдоподобия оценки ковариационной матрицы многомерного нормального распределения прост.

Короче говоря, функция плотности вероятности (pdf) многомерного нормального значения равна

а ML-оценщик ковариационной матрицы из выборки из n наблюдений равен [30]

это просто выборочная ковариационная матрица . Это смещенная оценка, математическое ожидание которой равно

Несмещенная выборочная ковариация — это

- (матричная форма; это единичная матрица, J представляет собой матрица единиц; термин в скобках, таким образом, является центрирующая матрица)

Информационная матрица Фишера для оценки параметров многомерного нормального распределения имеет выражение замкнутого вида. Это можно использовать, например, для вычисления границы Крамера – Рао для оценки параметров в этой ситуации. см . в информации Fisher Дополнительную информацию .

Байесовский вывод [ править ]

В байесовской статистике сопряженный априор среднего вектора представляет собой еще одно многомерное нормальное распределение, а сопряженный априор ковариационной матрицы представляет собой обратное распределение Вишарта. . Предположим тогда, что n было сделано наблюдений.

и что был назначен сопряженный априор, где

где

и

Затем [31]

где

тесты нормальность на Многомерные

Многомерные тесты на нормальность проверяют заданный набор данных на сходство с многомерным нормальным распределением . Нулевая гипотеза заключается в том, что набор данных аналогичен нормальному распределению, поэтому достаточно маленькое p значение указывает на ненормальные данные. Многомерные тесты на нормальность включают тест Кокса – Смолла. [32] и адаптация Смита и Джайна [33] теста Фридмана-Рафски, созданного Ларри Рафски и Джеромом Фридманом . [34]

тест Мардии [35] основано на многомерном расширении мер асимметрии и эксцесса . Для выборки { x 1 , ..., x n } k -мерных векторов мы вычисляем

При нулевой гипотезе многомерной нормальности статистика A будет иметь приблизительно распределение хи-квадрат с 1/6 + ( ⋅ k ( k + 1)( k 2) степеней свободы, и B будет примерно стандартной нормалью N 0,1).

Статистика эксцесса Мардиа искажена и очень медленно сходится к предельному нормальному распределению. Для образцов среднего размера , параметры асимптотического распределения статистики эксцесса изменяются [36] Для небольших выборочных испытаний ( ) используются эмпирические критические значения. Таблицы критических значений для обеих статистик даны Ренчером. [37] для к = 2, 3, 4.

Тесты Мардиа аффинно инвариантны, но несогласованны. Например, многомерный тест на асимметрию не согласуется ссимметричные ненормальные альтернативы. [38]

Тест BHEP [39] вычисляет норму разницы между эмпирической характеристической функцией и теоретической характеристической функцией нормального распределения. Расчет нормы производится в формате L 2 ( µ ) пространство суммируемых с квадратом функций относительно весовой функции Гаусса . Статистика теста

Предельное распределение этой тестовой статистики представляет собой взвешенную сумму случайных величин хи-квадрат. [39]

Доступен подробный обзор этих и других процедур испытаний. [40]

Классификация на многомерные нормальные классы [ править ]

Гауссовский дискриминантный анализ [ править ]

Предположим, что наблюдения (которые являются векторами) предположительно происходят из одного из нескольких многомерных нормальных распределений с известными средними значениями и ковариациями. Тогда любое данное наблюдение можно отнести к распределению, из которого оно имеет наибольшую вероятность возникновения. Эта процедура классификации называется гауссовским дискриминантным анализом.Эффективность классификации, то есть вероятности различных результатов классификации, а также общая ошибка классификации, могут быть рассчитаны с помощью численного метода трассировки лучей. [16] ( код Матлаба ).

Вычислительные методы [ править ]

Получение значений из распределения [ править ]

Широко используемый метод рисования (выборки) случайного вектора x из N -мерного многомерного нормального распределения со средним вектором µ и ковариационной матрицей Σ работает следующим образом: [41]

- Найдите любую вещественную матрицу A такую, что A A Т = Σ . Когда Σ положительно определена, разложение Холецкого обычно используется , и всегда можно использовать расширенную форму этого разложения (поскольку ковариационная матрица может быть только положительно полуопределенной) в обоих случаях подходящая матрица A. получается Альтернативой является использование матрицы A = UΛ ½ полученное спектральным разложением Σ = UΛU −1 Σ . Первый подход более прост с вычислительной точки зрения, но матрицы A изменяются для различного порядка элементов случайного вектора, тогда как второй подход дает матрицы, которые связаны простым переупорядочением. Теоретически оба подхода дают одинаково хорошие способы определения подходящей матрицы A , но есть различия во времени вычислений.

- Пусть z = ( z 1 , …, z N ) Т быть вектором, компоненты которого являются N независимыми стандартными нормальными переменными (которые можно сгенерировать, например, с помощью преобразования Бокса – Мюллера ).

- Пусть x будет µ + Az . Оно имеет желаемое распределение благодаря свойству аффинного преобразования.

См. также [ править ]

- Распределение Хи , PDF ( 2-нормы евклидова норма или длина вектора ) многомерного нормально распределенного вектора (некоррелированного и центрированного по нулю).

- Распределение Рэлея , PDF-файл длины вектора двумерного нормально распределенного вектора (некоррелированного и с центром в нуле)

- Распределение риса , PDF-файл длины вектора двумерного нормально распределенного вектора (некоррелированного и нецентрированного)

- Распределение Хойта , PDF-файл длины вектора двумерного нормально распределенного вектора (коррелированного и центрированного)

- Комплексное нормальное распределение , применение двумерного нормального распределения

- Copula для определения гауссовой или нормальной модели копулы.

- Многомерное t-распределение — еще одно широко используемое сферически-симметричное многомерное распределение.

- Расширение многомерного устойчивого распределения многомерного нормального распределения, когда индекс (показатель степени характеристической функции) находится между нулем и двумя.

- Расстояние Махаланобис

- Распределение желаний

- Матричное нормальное распределение

Ссылки [ править ]

- ↑ Перейти обратно: Перейти обратно: а б с Лапидот, Амос (2009). Фонд цифровых коммуникаций . Издательство Кембриджского университета. ISBN 978-0-521-19395-5 .

- ^ Гут, Аллан (2009). Промежуточный курс теории вероятности . Спрингер. ISBN 978-1-441-90161-3 .

- ^ Кац, М. (1939). «О характеристике нормального распределения». Американский журнал математики . 61 (3): 726–728. дои : 10.2307/2371328 . JSTOR 2371328 .

- ^ Синц, Фабиан; Гервинн, Себастьян; Бетге, Матиас (2009). «Характеристика p-обобщенного нормального распределения» . Журнал многомерного анализа . 100 (5): 817–820. дои : 10.1016/j.jmva.2008.07.006 .

- ^ Саймон Джей Ди Принс (июнь 2012 г.). Компьютерное зрение: модели, обучение и выводы . Издательство Кембриджского университета. 3.7: «Многомерное нормальное распределение».

- ^ Хамедани, Г.Г.; Тата, Миннесота (1975). «Об определении двумерного нормального распределения по распределениям линейных комбинаций переменных». Американский математический ежемесячник . 82 (9): 913–915. дои : 10.2307/2318494 . JSTOR 2318494 .

- ^ Вятт, Джон (26 ноября 2008 г.). «Линейная оценка наименьших среднеквадратических ошибок» (PDF) . Конспект лекций по курсу прикладной вероятности . Архивировано из оригинала (PDF) 10 октября 2015 года . Проверено 23 января 2012 г.

- ^ «Линейная алгебра - Отображение между аффинными координатными функциями» . Математический обмен стеками . Проверено 24 июня 2022 г.

- ^ Рао, ЧР (1973). Линейный статистический вывод и его приложения . Нью-Йорк: Уайли. стр. 527–528. ISBN 0-471-70823-2 .

- ↑ Перейти обратно: Перейти обратно: а б Ботев, З.И. (2016). «Нормальный закон при линейных ограничениях: моделирование и оценка с помощью минимаксного наклона». Журнал Королевского статистического общества, серия B. 79 : 125–148. arXiv : 1603.04166 . Бибкод : 2016arXiv160304166B . дои : 10.1111/rssb.12162 . S2CID 88515228 .

- ^ Генц, Алан (2009). Вычисление многомерных нормальных и t вероятностей . Спрингер. ISBN 978-3-642-01689-9 .

- ↑ Перейти обратно: Перейти обратно: а б Бенсимхун Майкл, N-мерная кумулятивная функция и другие полезные факты о гауссианах и нормальных плотностях (2006)

- ^ Сиотани, Минору (1964). «Области толерантности для многомерной нормальной популяции» (PDF) . Летопись Института статистической математики . 16 (1): 135–153. дои : 10.1007/BF02868568 . S2CID 123269490 .

- ↑ Перейти обратно: Перейти обратно: а б Ботев З.И.; Манджес, М.; Риддер, А. (6–9 декабря 2015 г.). «Хвостовое распределение максимума коррелированных гауссовских случайных величин». Зимняя конференция по моделированию (WSC) 2015 . Хантингтон-Бич, Калифорния, США: IEEE. стр. 633–642. дои : 10.1109/WSC.2015.7408202 . hdl : 10419/130486 . ISBN 978-1-4673-9743-8 .

- ^ Адлер, Р.Дж.; Бланше, Дж.; Лю, Дж. (7–10 декабря 2008 г.). «Эффективное моделирование хвостовых вероятностей гауссовских случайных полей». Зимняя конференция по моделированию (WSC) 2008 г. Майами, Флорида, США: IEEE. стр. 328–336. дои : 10.1109/WSC.2008.4736085 . ISBN 978-1-4244-2707-9 .

{{cite conference}}: CS1 maint: дата и год ( ссылка ) - ↑ Перейти обратно: Перейти обратно: а б с д и ж г час я Дас, Абранил; Уилсон С. Гейслер (2020). «Методы интеграции мультинормальных чисел и вычисления мер классификации». arXiv : 2012.14331 [ stat.ML ].

- ^ Эрнандес-Стумпфхаузер, Даниэль; Брейдт, Ф. Джей; ван дер Вёрд, Марк Дж. (2017). «Общее прогнозируемое нормальное распределение произвольной размерности: моделирование и байесовский вывод» . Байесовский анализ . 12 (1): 113–133. дои : 10.1214/15-BA989 .

- ^ Тонг, Т. (2010) Множественная линейная регрессия: MLE и результаты ее распределения. Архивировано 16 июня 2013 г. на WebCite , конспекты лекций.

- ^ Гохале, Д.В.; Ахмед, Н.А.; Рес, Британская Колумбия; Пискатауэй, Нью-Джерси (май 1989 г.). «Выражения энтропии и их оценки для многомерных распределений». Транзакции IEEE по теории информации . 35 (3): 688–692. дои : 10.1109/18.30996 .

- ^ Дучи, Дж. «Выводы для линейной алгебры и оптимизации» (PDF) : 13.

{{cite journal}}: Для цитирования журнала требуется|journal=( помощь ) - ^ Маккей, Дэвид Дж. К. (6 октября 2003 г.). Теория информации, логический вывод и алгоритмы обучения (Иллюстрированное издание). Кембридж: Издательство Кембриджского университета. ISBN 978-0-521-64298-9 .

- ^ Холт, В.; Нгуен, Д. (2023). «Основные аспекты байесовского вменения данных» . ССНН 4494314 .

{{cite journal}}: Для цитирования журнала требуется|journal=( помощь ) - ^ Итон, Моррис Л. (1983). Многомерная статистика: векторно-пространственный подход . Джон Уайли и сыновья. стр. 116–117. ISBN 978-0-471-02776-8 .

- ^ Дженсен, Дж (2000). Статистика для инженеров-нефтяников и геологов . Амстердам: Эльзевир. п. 207. ИСБН 0-444-50552-0 .

- ^ Маддала, GS (1983). Ограниченно зависимые и качественные переменные в эконометрике . Издательство Кембриджского университета. ISBN 0-521-33825-5 .

- ^ Алгебраическое вычисление предельного распределения показано здесь http://fourier.eng.hmc.edu/e161/lectures/gaussianprocess/node7.html. Архивировано 17 января 2010 г. в Wayback Machine . Гораздо более короткое доказательство изложено здесь https://math.stackexchange.com/a/3832137.

- ^ Николаус Хансен (2016). «Стратегия эволюции CMA: Учебное пособие» (PDF) . arXiv : 1604.00772 . Бибкод : 2016arXiv160400772H . Архивировано из оригинала (PDF) 31 марта 2010 г. Проверено 7 января 2012 г.

- ^ Дэниел Волльшлегер. «Дистрибутив Хойта (документация для пакета R «shotGroups» версии 0.6.2)» . [ постоянная мертвая ссылка ]

- ^ Ван, Бин; Ши, Вэньчжун; Мяо, Зеланг (13 марта 2015 г.). Роккини, Дуччо (ред.). «Анализ уверенности в эллипсе стандартных отклонений и его расширении в евклидово пространство более высоких измерений» . ПЛОС ОДИН . 10 (3): e0118537. Бибкод : 2015PLoSO..1018537W . дои : 10.1371/journal.pone.0118537 . ISSN 1932-6203 . ПМЦ 4358977 . ПМИД 25769048 .

- ^ Холт, В.; Нгуен, Д. (2023). «Введение в байесовский метод вменения данных» . ССНН 4494314 .

{{cite journal}}: Для цитирования журнала требуется|journal=( помощь ) - ^ Холт, В.; Нгуен, Д. (2023). «Введение в байесовский метод вменения данных» . ССНН 4494314 .

{{cite journal}}: Для цитирования журнала требуется|journal=( помощь ) - ^ Кокс, доктор медицинских наук; Смолл, Нью-Джерси (1978). «Тестирование многомерной нормальности». Биометрика . 65 (2): 263. doi : 10.1093/biomet/65.2.263 .

- ^ Смит, СП; Джайн, АК (1988). «Тест для определения многомерной нормальности набора данных». Транзакции IEEE по анализу шаблонов и машинному интеллекту . 10 (5): 757. дои : 10.1109/34.6789 .

- ^ Фридман, Дж. Х.; Рафски, LC (1979). «Многомерные обобщения двухвыборочных критериев Вальда – Вольфовица и Смирнова» . Анналы статистики . 7 (4): 697. дои : 10.1214/aos/1176344722 .

- ^ Мардия, КВ (1970). «Меры многомерной асимметрии и эксцесса с приложениями». Биометрика . 57 (3): 519–530. дои : 10.1093/biomet/57.3.519 .

- ^ Ренчер (1995), страницы 112–113.

- ^ Ренчер (1995), страницы 493–495.

- ^ Бэрингхаус, Л.; Хенце, Н. (1991). «Предельные распределения для мер многомерной асимметрии и эксцесса на основе прогнозов» . Журнал многомерного анализа . 38 : 51–69. дои : 10.1016/0047-259X(91)90031-V .

- ↑ Перейти обратно: Перейти обратно: а б Бэрингхаус, Л.; Хенце, Н. (1988). «Последовательный тест на многомерную нормальность, основанный на эмпирической характеристической функции». Метрика . 35 (1): 339–348. дои : 10.1007/BF02613322 . S2CID 122362448 .

- ^ Хенце, Норберт (2002). «Инвариантные тесты на многомерную нормальность: критический обзор». Статистические документы . 43 (4): 467–506. дои : 10.1007/s00362-002-0119-6 . S2CID 122934510 .

- ^ Нежный, Дж. Э. (2009). Вычислительная статистика . Статистика и вычисления. Нью-Йорк: Спрингер. стр. 315–316. дои : 10.1007/978-0-387-98144-4 . ISBN 978-0-387-98143-7 .

Литература [ править ]

- Ренчер, AC (1995). Методы многомерного анализа . Нью-Йорк: Уайли.

- Тонг, ЮЛ (1990). Многомерное нормальное распределение . Серия Спрингера по статистике. Нью-Йорк: Springer-Verlag. дои : 10.1007/978-1-4613-9655-0 . ISBN 978-1-4613-9657-4 . S2CID 120348131 .

![{\displaystyle {\boldsymbol {\mu }}=\left[{\begin{smallmatrix}0\\0\end{smallmatrix}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/288f20c89fee827ad086cec03369439ba3615d7f)

![{\displaystyle {\boldsymbol {\Sigma }}=\left[{\begin{smallmatrix}1&3/5\\3/5&2\end{smallmatrix}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ee3a76f734b37fcce91f30617152fe104b2782bc)

![{\displaystyle {\boldsymbol {\mu }}=\operatorname {E} [\mathbf {X} ]=(\operatorname {E} [X_{1}],\operatorname {E} [X_{2}], \ldots ,\operatorname {E} [X_{k}])^{\mathrm {T} },}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a0ff77227bef5ec255a816fbb1a31d5c1e0fba21)

![{\displaystyle \Sigma _{i,j}=\operatorname {E} [(X_{i}-\mu _{i})(X_{j}-\mu _{j})]=\operatorname {Cov } [X_{i},X_{j}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c970083f8469366521881996464f23d376b7c40b)

![{\displaystyle {\text{[XY]′}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/24925a0dd360004248b2a1de70e2b0bcf3fcf687)

![{\displaystyle f(x,y)={\frac {1}{2\pi \sigma _{X}\sigma _{Y}{\sqrt {1-\rho ^{2}}}}}\exp \left(-{\frac {1}{2\left[1-\rho ^{2}\right]}}\left[\left({\frac {x-\mu _{X}}{\sigma _{X}}}\right)^{2}-2\rho \left({\frac {x-\mu _{X}}{\sigma _{X}}}\right)\left({\ frac {y-\mu _{Y}}{\sigma _{Y}}}\right)+\left({\frac {y-\mu _{Y}}{\sigma _{Y}}}\ вправо)^{2}\вправо]\вправо)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bf91aebe806d84bb97ab95715e8e10e619387356)

![{\displaystyle \mu _{1,\ldots,N}(\mathbf {x})\mathrel {\stackrel {\mathrm {def} {=}} \mu _{r_{1},\ldots,r_ {N}}(\mathbf {x} )\mathrel {\stackrel {\mathrm {def} }{=}} \operatorname {E} \left[\prod _{j=1}^{N}X_{j }^{r_{j}}\вправо]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e19f7eec8adb98477e74dd88285ec1a07ce29aef)

![{\displaystyle {\begin{aligned}&\operatorname {E} [X_{1}X_{2}X_{3}X_{4}X_{5}X_{6}]\\[8pt]={}& \operatorname {E} [X_{1}X_{2}]\operatorname {E} [X_{3}X_{4}]\operatorname {E} [X_{5}X_{6}]+\operatorname {E } [X_{1}X_{2}]\operatorname {E} [X_{3}X_{5}]\operatorname {E} [X_{4}X_{6}]+\operatorname {E} [X_{ 1}X_{2}]\operatorname {E} [X_{3}X_{6}]\operatorname {E} [X_{4}X_{5}]\\[4pt]&{}+\operatorname {E } [X_{1}X_{3}]\operatorname {E} [X_{2}X_{4}]\operatorname {E} [X_{5}X_{6}]+\operatorname {E} [X_{ 1}X_{3}]\operatorname {E} [X_{2}X_{5}]\operatorname {E} [X_{4}X_{6}]+\operatorname {E} [X_{1}X_{ 3}]\operatorname {E} [X_{2}X_{6}]\operatorname {E} [X_{4}X_{5}]\\[4pt]&{}+\operatorname {E} [X_{ 1}X_{4}]\operatorname {E} [X_{2}X_{3}]\operatorname {E} [X_{5}X_{6}]+\operatorname {E} [X_{1}X_{ 4}]\operatorname {E} [X_{2}X_{5}]\operatorname {E} [X_{3}X_{6}]+\operatorname {E} [X_{1}X_{4}]\ имя_оператора {E} [X_{2}X_{6}]\имя_оператора {E} [X_{3}X_{5}]\\[4pt]&{}+\имя_оператора {E} [X_{1}X_{ 5}]\operatorname {E} [X_{2}X_{3}]\operatorname {E} [X_{4}X_{6}]+\operatorname {E} [X_{1}X_{5}]\ имя_оператора {E} [X_{2}X_{4}]\имя_оператора {E} [X_{3}X_{6}]+\имя_оператора {E} [X_{1}X_{5}]\имя_оператора {E} [X_{2}X_{6}]\operatorname {E} [X_{3}X_{4}]\\[4pt]&{}+\operatorname {E} [X_{1}X_{6}]\ имя_оператора {E} [X_{2}X_{3}]\имя_оператора {E} [X_{4}X_{5}]+\имя_оператора {E} [X_{1}X_{6}]\имя_оператора {E} [X_{2}X_{4}]\operatorname {E} [X_{3}X_{5}]+\operatorname {E} [X_{1}X_{6}]\operatorname {E} [X_{2) }X_{5}]\operatorname {E} [X_{3}X_{4}].\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0517839a9528128fa6d69cedfe4f5003a34716f4)

![{\displaystyle [1,\ldots,2\lambda]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a605bf32a38577fe9df1bc5715a4a3cac5869832)

![{\displaystyle {\begin{aligned}\operatorname {E} \left[X_{i}^{4}\right]&=3\sigma _{ii}^{2}\\[4pt]\operatorname {E } \left[X_{i}^{3}X_{j}\right]&=3\sigma _{ii}\sigma _{ij}\\[4pt]\operatorname {E} \left[X_{i }^{2}X_{j}^{2}\right]&=\sigma _{ii}\sigma _{jj}+2\sigma _{ij}^{2}\\[4pt]\operatorname { E} \left[X_{i}^{2}X_{j}X_{k}\right]&=\sigma _{ii}\sigma _{jk}+2\sigma _{ij}\sigma _{ ik}\\[4pt]\operatorname {E} \left[X_{i}X_{j}X_{k}X_{n}\right]&=\sigma _{ij}\sigma _{kn}+\ сигма _{ik}\sigma _{jn}+\sigma _{in}\sigma _{jk}.\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4e08f5bc180e3f1f4379c1026100e833ea85de97)

![{\displaystyle E\left[X_{i}X_{j}X_{k}X_{n}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0b4bbbf2becaf15b246898e928a37e7d0ab6f93a)

![{\displaystyle \operatorname {E} [X_{i}^{2}X_{k}X_{n}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f7bc1920d0e524aa567ca471bdb54dcf7ef7e673)

![{\displaystyle \ln L({\boldsymbol {x}})=- {\frac {1}{2}}\left[\ln(|{\boldsymbol {\Sigma }}|\,)+({\ Boldsymbol {x}}-{\boldsymbol {\mu }})'{\boldsymbol {\Sigma }}^{-1}({\boldsymbol {x}}-{\boldsymbol {\mu }})+k\ ln(2\pi)\вправо]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4ad05643016bbf6ac76a826320bea00704b50982)

![{\displaystyle E\left[{\widehat {\boldsymbol {\Sigma }}}\right]={\frac {n-1}{n}}{\boldsymbol {\Sigma }}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/12908e94489d8fcdd7c2aa360d3ce85c26bc611a)

![{\displaystyle {\widehat {\boldsymbol {\Sigma }}}={\frac {1}{n-1}}\sum _{i=1}^{n}(\mathbf {x} _{i} - {\overline {\mathbf {x} }})(\mathbf {x} _{i} - {\overline {\mathbf {x} }})^{\rm {T}}={\frac {1 }{n-1}}\left[X'\left(I-{\frac {1}{n}}\cdot J\right)X\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b483843b0f64ecbfea751011ef0ab8e61c7f0dcc)

![{\displaystyle {\begin{aligned}&{\widehat {\boldsymbol {\Sigma }}}={1 \over n}\sum _{j=1}^{n}\left(\mathbf {x} _ {j}-{\bar {\mathbf {x} }}\right)\left(\mathbf {x} _{j}-{\bar {\mathbf {x} }}\right)^{\mathrm { T} }\\&A={1 \over 6n}\sum _{i=1}^{n}\sum _{j=1}^{n}\left[(\mathbf {x} _{i} -{\bar {\mathbf {x} }})^{\mathrm {T} }\;{\widehat {\boldsymbol {\Sigma }}}^{-1}(\mathbf {x} _{j} -{\bar {\mathbf {x} }})\right]^{3}\\&B={\sqrt {\frac {n}{8k(k+2)}}}\left\{{1 \ над n}\sum _{i=1}^{n}\left[(\mathbf {x} _{i}-{\bar {\mathbf {x} }})^{\mathrm {T} }\ ;{\widehat {\boldsymbol {\Sigma }}}^{-1}(\mathbf {x} _{i}-{\bar {\mathbf {x} }})\right]^{2}-k (k+2)\right\}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2d6fcd342cc6e6df3c6fcd10852c7908e248829d)