Искусственный интеллект

| Часть серии о |

| Искусственный интеллект |

|---|

Искусственный интеллект ( ИИ ) в самом широком смысле — это интеллект, демонстрируемый машинами , в частности компьютерными системами . Это область исследований в области информатики , которая разрабатывает и изучает методы и программное обеспечение , которые позволяют машинам воспринимать окружающую среду и использовать обучение и интеллект для принятия мер, которые максимизируют их шансы на достижение определенных целей. [ 1 ] Такие машины можно назвать ИИ.

Некоторые известные приложения ИИ включают передовые поисковые системы в Интернете (например, Google Search ); системы рекомендаций (используются YouTube , Amazon и Netflix ); взаимодействие посредством человеческой речи (например, Google Assistant , Siri и Alexa ); автономные транспортные средства (например, Waymo ); генеративные и творческие инструменты (например, ChatGPT , Apple Intelligence и AI art ); и сверхчеловеческая игра и анализ в стратегических играх (например, шахматах и го ). Однако многие приложения ИИ не воспринимаются как ИИ: «Множество передовых ИИ просочилось в общие приложения, часто не называемые ИИ, потому что как только что-то становится достаточно полезным и достаточно распространенным, его больше не называют ИИ ». [ 2 ] [ 3 ]

Алан Тьюринг был первым человеком, проведшим серьезные исследования в области, которую он назвал «машинный интеллект». [ 4 ] Искусственный интеллект был основан как академическая дисциплина в 1956 году. [ 5 ] те, кого сейчас считают отцами-основателями ИИ: Джон Маккарти , Марвин Минкси , Натаниэль Рочестер и Клод Шеннон . [ 6 ] [ 7 ] Эта отрасль прошла через несколько циклов оптимизма. [ 8 ] [ 9 ] за которыми следовали периоды разочарования и потери финансирования, известные как зима AI . [ 10 ] [ 11 ] Финансирование и интерес значительно возросли после 2012 года, когда глубокое обучение превзошло все предыдущие методы искусственного интеллекта. [ 12 ] а после 2017 года с архитектурой-трансформером . [ 13 ] Это привело к буму искусственного интеллекта в начале 2020-х годов, когда компании, университеты и лаборатории, преимущественно расположенные в Соединенных Штатах, стали пионерами значительных достижений в области искусственного интеллекта . [ 14 ]

Растущее использование искусственного интеллекта в 21 веке влияет на социальный и экономический сдвиг в сторону большей автоматизации , принятия решений на основе данных и интеграции систем искусственного интеллекта в различные экономические сектора и сферы жизни, влияя на рынки труда , здравоохранение , государственное управление. , промышленность , образование , пропаганда и дезинформация . Это поднимает вопросы о долгосрочных последствиях , этических последствиях и рисках ИИ , что побуждает к дискуссиям о регуляторной политике, обеспечивающей безопасность и преимущества технологии .

Различные области исследований ИИ сосредоточены вокруг конкретных целей и использования определенных инструментов. Традиционные цели исследований ИИ включают рассуждение , представление знаний , планирование , обучение , обработку естественного языка , восприятие и поддержку робототехники . [ а ] Общий интеллект — способность выполнять любую задачу, которую может выполнить человек, как минимум на равном уровне — входит в число долгосрочных целей этой области. [ 15 ]

Для достижения этих целей исследователи ИИ адаптировали и интегрировали широкий спектр методов, включая поисковую и математическую оптимизацию , формальную логику , искусственные нейронные сети и методы, основанные на статистике , исследовании операций и экономике . [ б ] ИИ также опирается на психологию , лингвистику , философию , нейробиологию и другие области. [ 16 ]

Цели

Общая проблема моделирования (или создания) интеллекта разбита на подзадачи. Они состоят из определенных черт или способностей, которые исследователи ожидают от интеллектуальной системы. Описанные ниже черты получили наибольшее внимание и охватывают сферу исследований ИИ. [ а ]

Рассуждение и решение проблем

Ранние исследователи разработали алгоритмы, имитирующие пошаговые рассуждения, которые люди используют, когда решают головоломки или делают логические выводы . [ 17 ] К концу 1980-х и 1990-м годам были разработаны методы работы с неопределенной или неполной информацией с использованием концепций теории вероятности и экономики . [ 18 ]

Многих из этих алгоритмов недостаточно для решения больших задач рассуждения, поскольку они испытывают «комбинаторный взрыв»: по мере роста задач они становятся экспоненциально медленнее. [ 19 ] Даже люди редко используют пошаговые выводы, которые могли смоделировать ранние исследования ИИ. Они решают большинство своих проблем, используя быстрые и интуитивные суждения. [ 20 ] Точные и эффективные рассуждения — нерешенная проблема.

Представление знаний

Представление знаний и инженерия знаний [ 21 ] позволить программам искусственного интеллекта разумно отвечать на вопросы и делать выводы на основе реальных фактов. Формальные представления знаний используются при индексировании и поиске на основе контента. [ 22 ] интерпретация сцены, [ 23 ] поддержка принятия клинических решений, [ 24 ] обнаружение знаний (извлечение «интересных» и практических выводов из больших баз данных ), [ 25 ] и другие области. [ 26 ]

База знаний — это совокупность знаний, представленная в форме, которую может использовать программа. Онтология — это набор объектов, отношений, концепций и свойств, используемых в определенной области знаний. [ 27 ] Базы знаний должны представлять такие вещи, как объекты, свойства, категории и отношения между объектами; [ 28 ] ситуации, события, состояния и время; [ 29 ] причины и следствия; [ 30 ] знание о знании (то, что мы знаем о том, что знают другие люди); [ 31 ] рассуждения по умолчанию (вещи, которые люди предполагают, являются истинными, пока им не скажут иначе, и останутся истинными, даже когда другие факты меняются); [ 32 ] и многие другие аспекты и области знаний.

Среди наиболее сложных проблем представления знаний — широта знаний здравого смысла (набор элементарных фактов, известных среднестатистическому человеку, огромен); [ 33 ] и субсимволическая форма большинства здравомыслящих знаний (многое из того, что знают люди, не представлено в виде «фактов» или «утверждений», которые они могли бы выразить устно). [ 20 ] Существует также сложность приобретения знаний , проблема получения знаний для приложений ИИ. [ с ]

Планирование и принятие решений

«Агент» — это все, что воспринимает и совершает действия в мире. имеет Рациональный агент цели или предпочтения и предпринимает действия для их достижения. [ д ] [ 36 ] При автоматизированном планировании у агента есть конкретная цель. [ 37 ] При автоматическом принятии решений у агента есть предпочтения: есть некоторые ситуации, в которых он предпочел бы оказаться, а некоторых ситуаций он пытается избежать. Агент, принимающий решения, присваивает каждой ситуации число (называемое « полезностью »), которое измеряет, насколько агент предпочитает ее. Для каждого возможного действия он может рассчитать « ожидаемую полезность »: полезность всех возможных результатов действия, взвешенную по вероятности того, что результат произойдет. Затем он может выбрать действие с максимальной ожидаемой полезностью. [ 38 ]

При классическом планировании агент точно знает, каким будет эффект любого действия. [ 39 ] Однако в большинстве задач реального мира агент может не быть уверен в ситуации, в которой он находится (она «неизвестна» или «ненаблюдаема»), и он может не знать наверняка, что произойдет после каждого возможного действия (это не так). «детерминированный»). Он должен выбрать действие, сделав вероятностное предположение, а затем повторно оценить ситуацию, чтобы увидеть, сработало ли действие. [ 40 ]

В некоторых задачах предпочтения агента могут быть неопределенными, особенно если в решении участвуют другие агенты или люди. Их можно изучить (например, с помощью обратного обучения с подкреплением ), или агент может искать информацию для улучшения своих предпочтений. [ 41 ] Теорию ценности информации можно использовать для взвешивания ценности исследовательских или экспериментальных действий. [ 42 ] Пространство возможных будущих действий и ситуаций обычно непреодолимо велико, поэтому агенты должны предпринимать действия и оценивать ситуации, не зная, каким будет результат.

Марковский процесс принятия решений имеет модель перехода , которая описывает вероятность того, что конкретное действие изменит состояние определенным образом, и функцию вознаграждения , которая определяет полезность каждого состояния и стоимость каждого действия. Политика . связывает решение с каждым возможным состоянием Политика может быть рассчитана (например, путем итерации ), быть эвристической или ее можно изучить. [ 43 ]

Теория игр описывает рациональное поведение нескольких взаимодействующих агентов и используется в программах ИИ, которые принимают решения с участием других агентов. [ 44 ]

Обучение

Машинное обучение — это исследование программ, которые могут автоматически улучшить свою производительность при выполнении определенной задачи. [ 45 ] Он был частью ИИ с самого начала. [ и ]

Существует несколько видов машинного обучения. Обучение без учителя анализирует поток данных, находит закономерности и делает прогнозы без какого-либо другого руководства. [ 48 ] Обучение с учителем требует, чтобы человек сначала помечал входные данные, и оно бывает двух основных разновидностей: классификация (когда программа должна научиться предсказывать, к какой категории принадлежат входные данные) и регрессия (когда программа должна вывести числовую функцию на основе числового ввода). ). [ 49 ]

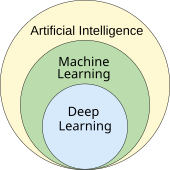

При обучении с подкреплением агент вознаграждается за хорошие ответы и наказывается за плохие. Агент учится выбирать ответы, которые классифицируются как «хорошие». [ 50 ] Трансферное обучение – это когда знания, полученные при решении одной проблемы, применяются к новой проблеме. [ 51 ] Глубокое обучение — это тип машинного обучения, при котором входные данные передаются через биологически созданные искусственные нейронные сети для всех этих типов обучения. [ 52 ]

Теория компьютерного обучения может оценивать учащихся по сложности вычислений , по сложности выборки (сколько данных требуется) или по другим понятиям оптимизации . [ 53 ]

Обработка естественного языка

Обработка естественного языка (НЛП) [ 54 ] позволяет программам читать, писать и общаться на человеческих языках, таких как английский . Конкретные проблемы включают распознавание речи , синтез речи , машинный перевод , извлечение информации , поиск информации и ответы на вопросы . [ 55 ]

Ранние работы, основанные на Ноама Хомского , порождающей грамматике и семантических сетях имели трудности с устранением смысловой неоднозначности слов. [ ж ] если только они не ограничены небольшими областями, называемыми « микромирами » (из-за проблемы знания здравого смысла). [ 33 ] ). Маргарет Мастерман считала, что именно значение, а не грамматика, является ключом к пониманию языков и что тезаурусы основой вычислительной структуры языка должны быть , а не словари.

Современные методы глубокого обучения для НЛП включают встраивание слов (представление слов, обычно в виде векторов, кодирующих их значение), [ 56 ] трансформеры (архитектура глубокого обучения с использованием механизма внимания ), [ 57 ] и другие. [ 58 ] В 2019 году генеративные предварительно обученные языковые модели-трансформеры (или «GPT») начали генерировать связный текст. [ 59 ] [ 60 ] и к 2023 году эти модели смогут получать оценки человеческого уровня на экзаменах на получение адвокатского статуса , SAT , GRE и многих других реальных приложениях. [ 61 ]

Восприятие

Машинное восприятие — это способность использовать данные от датчиков (таких как камеры, микрофоны, беспроводные сигналы, активный лидар , гидролокатор, радар и тактильные датчики ) для определения аспектов мира. Компьютерное зрение — это способность анализировать визуальную информацию. [ 62 ]

Область включает в себя распознавание речи , [ 63 ] классификация изображений , [ 64 ] распознавание лиц , распознавание объектов , [ 65 ] отслеживание объектов , [ 66 ] и роботизированное восприятие . [ 67 ]

Социальный интеллект

Аффективные вычисления — это междисциплинарный зонтик, включающий системы, которые распознают, интерпретируют, обрабатывают или моделируют человеческие чувства, эмоции и настроение . [ 69 ] Например, некоторые виртуальные помощники запрограммированы разговаривать разговорно или даже шутливо подшучивать; это делает их более чувствительными к эмоциональной динамике человеческого взаимодействия или иным образом облегчает взаимодействие человека с компьютером .

Однако это дает наивным пользователям нереальное представление об интеллекте существующих компьютерных агентов. [ 70 ] Умеренные успехи, связанные с аффективными вычислениями, включают текстовый анализ настроений и, в последнее время, мультимодальный анализ настроений , в котором ИИ классифицирует аффекты, отображаемые субъектом, записанным на видео. [ 71 ]

Общий интеллект

Машина с общим искусственным интеллектом должна быть способна решать широкий спектр задач с широтой и универсальностью, подобно человеческому интеллекту . [ 15 ]

Техники

Исследования ИИ используют широкий спектр методов для достижения вышеуказанных целей. [ б ]

Поиск и оптимизация

ИИ может решить многие проблемы, разумно перебирая множество возможных решений. [ 72 ] В ИИ используются два совершенно разных типа поиска: поиск в пространстве состояний и локальный поиск .

Государственный космический поиск

Поиск в пространстве состояний просматривает дерево возможных состояний, чтобы попытаться найти целевое состояние. [ 73 ] Например, алгоритмы планирования просматривают деревья целей и подцелей, пытаясь найти путь к целевой цели. Этот процесс называется анализом средств и результатов . [ 74 ]

Простой исчерпывающий поиск [ 75 ] редко бывают достаточными для большинства реальных задач: пространство поиска (количество мест для поиска) быстро вырастает до астрономических цифр . В результате поиск выполняется слишком медленно или никогда не завершается. [ 19 ] « Эвристика » или «эмпирические правила» могут помочь расставить приоритеты в выборе, который с большей вероятностью приведет к достижению цели. [ 76 ]

Состязательный поиск используется для игровых программ, таких как шахматы или го. Он просматривает дерево возможных ходов и контрходов в поисках выигрышной позиции. [ 77 ]

Локальный поиск

Локальный поиск использует математическую оптимизацию для поиска решения проблемы. Он начинается с некоторой формы предположения и постепенно совершенствует его. [ 78 ]

Градиентный спуск — это тип локального поиска, который оптимизирует набор числовых параметров путем постепенной их корректировки для минимизации функции потерь . Варианты градиентного спуска обычно используются для обучения нейронных сетей. [ 79 ]

Другой тип локального поиска — эволюционные вычисления , целью которых является итеративное улучшение набора возможных решений путем «мутации» и «рекомбинации» их, отбирая только наиболее приспособленных для выживания в каждом поколении. [ 80 ]

Процессы распределенного поиска могут координироваться с помощью алгоритмов роевого интеллекта . Двумя популярными роевыми алгоритмами, используемыми в поиске, являются оптимизация роя частиц (вдохновленная стайкой птиц ) и оптимизация колонии муравьев (вдохновленная муравьиными следами ). [ 81 ]

Логика

Формальная логика используется для рассуждений и представления знаний . [ 82 ] Формальная логика существует в двух основных формах: логика высказываний (которая оперирует утверждениями, которые являются истинными или ложными, и использует логические связки, такие как «и», «или», «не» и «подразумевается»). [ 83 ] и логика предикатов (которая также работает с объектами, предикатами и отношениями и использует кванторы, такие как « Каждый X есть Y » и «Есть некоторые X , которые являются Y »). [ 84 ]

Дедуктивное рассуждение в логике — это процесс доказательства нового утверждения ( вывода ) на основе других утверждений, которые даны и считаются истинными ( посылок ). [ 85 ] Доказательства могут быть структурированы как деревья доказательств , в которых узлы помечены предложениями, а дочерние узлы соединены с родительскими узлами правилами вывода .

Учитывая проблему и набор предпосылок, решение проблемы сводится к поиску дерева доказательств, корневой узел которого помечен решением проблемы, а листовые узлы помечены посылками или аксиомами . В случае предложений Хорна поиск решения проблемы может осуществляться путем рассуждений вперед от посылок или назад от проблемы. [ 86 ] В более общем случае клаузальной формы первого порядка логики разрешение — это единственное, свободное от аксиом правило вывода, в котором проблема решается путем доказательства противоречия из посылок, которые включают отрицание решаемой проблемы. [ 87 ]

Вывод как в логике предложения Хорна, так и в логике первого порядка неразрешим и, следовательно, неразрешим . Однако обратные рассуждения с предложениями Хорна, лежащие в основе вычислений в логического программирования языке Пролог , являются полными по Тьюрингу . Более того, его эффективность не уступает вычислениям на других символьных языках программирования. [ 88 ]

Нечеткая логика присваивает «степень истинности» от 0 до 1. Таким образом, она может обрабатывать расплывчатые и частично истинные утверждения. [ 89 ]

Немонотонная логика , включая логическое программирование с отрицанием как неудачей , предназначена для обработки рассуждений по умолчанию . [ 32 ] Для описания многих сложных областей были разработаны другие специализированные версии логики.

Вероятностные методы для неопределенных рассуждений

Многие проблемы ИИ (в том числе рассуждения, планирование, обучение, восприятие и робототехника) требуют от агента работы с неполной или неопределенной информацией. Исследователи искусственного интеллекта разработали ряд инструментов для решения этих проблем, используя методы теории вероятностей и экономики. [ 90 ] Были разработаны точные математические инструменты, которые анализируют, как агент может делать выбор и планировать, используя теорию принятия решений , анализ решений , [ 91 ] и теория ценности информации . [ 92 ] Эти инструменты включают в себя такие модели, как процессы принятия решений Маркова , [ 93 ] динамических сети решений , [ 94 ] Теория игр и проектирование механизмов . [ 95 ]

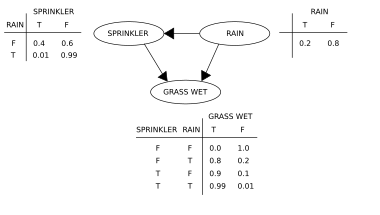

Байесовские сети [ 96 ] являются инструментом, который можно использовать для рассуждений (с использованием алгоритма байесовского вывода ), [ г ] [ 98 ] обучение (с использованием алгоритма ожидания-максимизации ), [ ч ] [ 100 ] планирование (с использованием сетей принятия решений ) [ 101 ] и восприятие (с использованием динамических байесовских сетей ). [ 94 ]

Вероятностные алгоритмы также можно использовать для фильтрации, прогнозирования, сглаживания и поиска объяснений потоков данных, тем самым помогая системам восприятия анализировать процессы, происходящие с течением времени (например, скрытые модели Маркова или фильтры Калмана ). [ 94 ]

Классификаторы и статистические методы обучения

Простейшие ИИ-приложения можно разделить на два типа: классификаторы (например, «если блестит, то ромб»), с одной стороны, и контроллеры (например, «если бриллиант, то поднимите»), с другой стороны. Классификаторы [ 102 ] — это функции, которые используют сопоставление с образцом для определения наиболее близкого соответствия. Их можно доработать на основе выбранных примеров с помощью обучения с учителем . Каждый шаблон (также называемый « наблюдением ») помечен определенным предопределенным классом. Все наблюдения в сочетании с их метками классов известны как набор данных . Когда получено новое наблюдение, оно классифицируется на основе предыдущего опыта. [ 49 ]

Существует множество видов классификаторов. [ 103 ] Дерево решений — это самый простой и наиболее широко используемый алгоритм символьного машинного обучения. [ 104 ] Алгоритм K-ближайшего соседа был наиболее широко используемым аналоговым ИИ до середины 1990-х годов, а методы ядра , такие как машина опорных векторов (SVM), вытеснили k-ближайшего соседа в 1990-х годах. [ 105 ] Сообщается, что наивный классификатор Байеса является «наиболее широко используемым методом обучения». [ 106 ] в Google, отчасти благодаря его масштабируемости. [ 107 ] Нейронные сети также используются в качестве классификаторов. [ 108 ]

Искусственные нейронные сети

Искусственная нейронная сеть основана на наборе узлов, также известных как искусственные нейроны , которые в общих чертах моделируют нейроны биологического мозга. Он обучен распознавать закономерности; после обучения он сможет распознавать эти закономерности в свежих данных. Есть вход, как минимум один скрытый слой узлов и выход. Каждый узел применяет функцию, и как только вес пересекает указанный порог, данные передаются на следующий уровень. Сеть обычно называется глубокой нейронной сетью, если она имеет как минимум два скрытых слоя. [ 108 ]

Алгоритмы обучения нейронных сетей используют локальный поиск для выбора весов, которые дадут правильный результат для каждого входного сигнала во время обучения. Наиболее распространенным методом обучения является алгоритм обратного распространения ошибки . [ 109 ] Нейронные сети учатся моделировать сложные взаимосвязи между входными и выходными данными и находить закономерности в данных. Теоретически нейронная сеть может изучить любую функцию. [ 110 ]

В нейронных сетях прямого распространения сигнал проходит только в одном направлении. [ 111 ] Рекуррентные нейронные сети передают выходной сигнал обратно на вход, что позволяет кратковременно запоминать предыдущие входные события. Долговременная краткосрочная память является наиболее успешной сетевой архитектурой для рекуррентных сетей. [ 112 ] Персептроны [ 113 ] использовать только один слой нейронов, глубокое обучение [ 114 ] использует несколько слоев. Сверточные нейронные сети усиливают связь между нейронами, находящимися «близко» друг к другу — это особенно важно при обработке изображений , где локальный набор нейронов должен идентифицировать «край», прежде чем сеть сможет идентифицировать объект. [ 115 ]

Глубокое обучение

Глубокое обучение [ 114 ] использует несколько слоев нейронов между входами и выходами сети. Несколько слоев могут постепенно извлекать функции более высокого уровня из необработанных входных данных. Например, при обработке изображений нижние уровни могут идентифицировать края, а более высокие уровни могут идентифицировать понятия, относящиеся к человеку, такие как цифры, буквы или лица. [ 116 ]

Глубокое обучение значительно улучшило производительность программ во многих важных областях искусственного интеллекта, включая компьютерное зрение , распознавание речи , обработку естественного языка , классификацию изображений , [ 117 ] и другие. Причина, по которой глубокое обучение так хорошо работает во многих приложениях, по состоянию на 2023 год неизвестна. [ 118 ] Внезапный успех глубокого обучения в 2012–2015 годах произошел не из-за какого-то нового открытия или теоретического прорыва (глубокие нейронные сети и обратное распространение ошибки были описаны многими людьми еще в 1950-х годах). [ я ] но из-за двух факторов: невероятного увеличения мощности компьютера (включая стократное увеличение скорости за счет перехода на графические процессоры ) и доступности огромных объемов обучающих данных, особенно гигантских курируемых наборов данных, используемых для эталонного тестирования, таких как ImageNet . [ Дж ]

GPT

Генеративные предварительно обученные преобразователи (GPT) — это большие языковые модели (LLM), которые генерируют текст на основе семантических отношений между словами в предложениях. Текстовые модели GPT предварительно обучаются на большом массиве текста , который может быть взят из Интернета. Предварительное обучение состоит из предсказания следующего токена (токеном обычно является слово, подслово или знак препинания). В ходе этого предварительного обучения модели GPT накапливают знания о мире, а затем могут генерировать текст, похожий на человеческий, многократно предсказывая следующий токен. Как правило, последующий этап обучения делает модель более правдивой, полезной и безвредной, обычно с помощью метода, называемого обучением с подкреплением на основе обратной связи с человеком (RLHF). Текущие модели GPT склонны генерировать ложные сведения, называемые « галлюцинациями », хотя это можно уменьшить с помощью RLHF и качественных данных. Они используются в чат-ботах , которые позволяют людям задавать вопросы или запрашивать задачу простым текстом. [ 126 ] [ 127 ]

Текущие модели и сервисы включают Gemini (ранее Bard), ChatGPT , Grok , Claude , Copilot и LLaMA . [ 128 ] Мультимодальные модели GPT могут обрабатывать различные типы данных ( модальности ), такие как изображения, видео, звук и текст. [ 129 ]

Специализированное оборудование и программное обеспечение

В конце 2010-х годов графические процессоры (GPU), которые все чаще проектировались с усовершенствованиями, специфичными для искусственного интеллекта, и использовались со специализированным программным обеспечением TensorFlow, заменили ранее использовавшиеся центральные процессоры (ЦП) в качестве доминирующего средства для крупномасштабных (коммерческих и академических) машин. обучения . обучение моделей [ 130 ] Специализированные языки программирования , такие как Пролог, использовались в ранних исследованиях ИИ. [ 131 ] но языки программирования общего назначения, такие как Python, стали преобладать. [ 132 ]

Приложения

Технологии искусственного интеллекта и машинного обучения используются в большинстве важнейших приложений 2020-х годов, включая: поисковые системы (такие как Google Search ), таргетинг онлайн-рекламы , системы рекомендаций (предлагаемые Netflix , YouTube или Amazon ), привлечение интернет-трафика , таргетированную рекламу. ( AdSense , Facebook ), виртуальные помощники (такие как Siri или Alexa ), автономные транспортные средства (включая дроны , ADAS и беспилотные автомобили ), автоматический языковой перевод ( Microsoft Translator , Google Translate ), мимика распознавание ( Apple от Face ID или Microsoft от DeepFace и Google от FaceNet ) и маркировка изображений (используется Facebook от Apple , iPhoto и TikTok ). Развертывание ИИ может контролироваться директором по автоматизации (CAO).

Здоровье и медицина

Применение ИИ в медицине и медицинских исследованиях потенциально может улучшить уход за пациентами и качество их жизни. [ 133 ] Через призму клятвы Гиппократа медицинские работники этически обязаны использовать ИИ, если приложения могут более точно диагностировать и лечить пациентов.

Для медицинских исследований ИИ является важным инструментом обработки и интеграции больших данных . Это особенно важно для развития органоидной и тканевой инженерии визуализация используется , где микроскопическая в качестве ключевого метода производства. [ 134 ] Было высказано предположение, что ИИ может преодолеть несоответствия в финансировании, выделяемом на различные области исследований. [ 134 ] Новые инструменты искусственного интеллекта могут углубить понимание биомедицинских путей. Например, AlphaFold 2 (2021) продемонстрировал способность аппроксимировать трехмерную структуру белка за часы, а не за месяцы . [ 135 ] В 2023 году сообщалось, что открытие лекарств под руководством ИИ помогло найти класс антибиотиков, способных убивать два разных типа устойчивых к лекарствам бактерий. [ 136 ] В 2024 году исследователи использовали машинное обучение, чтобы ускорить поиск от болезни Паркинсона лекарств . Их целью было идентифицировать соединения, которые блокируют слипание или агрегацию альфа-синуклеина (белка, который характеризует болезнь Паркинсона). Им удалось ускорить процесс первичной проверки в десять раз и снизить стоимость в тысячу раз. [ 137 ] [ 138 ]

Игры

Игровые программы используются с 1950-х годов для демонстрации и тестирования самых передовых методов искусственного интеллекта. [ 139 ] Deep Blue стала первой компьютерной шахматной системой, победившей действующего чемпиона мира по шахматам Гарри Каспарова 11 мая 1997 года. [ 140 ] В 2011 году в опасности! викторина-шоу показательный матч, , IBM вопросно-ответная система Уотсон , победилдва величайших Jeopardy! чемпионы Брэд Раттер и Кен Дженнингс со значительным отрывом. [ 141 ] В марте 2016 года AlphaGo выиграла 4 из 5 игр в го в матче с чемпионом по го Ли Седолем , став первой компьютерной системой игры в го, обыгравшей профессионального игрока в го без гандикапов . Затем, в 2017 году, она победила Кэ Цзе , лучшего игрока в го в мире. [ 142 ] Другие программы поддерживают игры с несовершенной информацией , например, в покер программа для игры Pluribus . [ 143 ] DeepMind разработала все более общие модели обучения с подкреплением , такие как MuZero , которые можно было обучить играть в шахматы, го или Atari . игры [ 144 ] В 2019 году AlphaStar из DeepMind достигла уровня гроссмейстера в StarCraft II , особенно сложной стратегической игре в реальном времени, которая предполагает неполное знание того, что происходит на карте. [ 145 ] В 2021 году ИИ-агент принял участие в соревновании PlayStation Gran Turismo , победив четырех лучших в мире водителей Gran Turismo, используя глубокое обучение с подкреплением. [ 146 ] В 2024 году Google DeepMind представила SIMA, тип искусственного интеллекта, способный автономно играть в девять ранее невиданных видеоигр с открытым миром , наблюдая за выводом на экран, а также выполнять короткие конкретные задачи в ответ на инструкции на естественном языке. [ 147 ]

Математика

специальные формы формальных пошаговых рассуждений В математике используются . Напротив, такие LLM, как GPT-4 Turbo , Gemini Ultra , Claude Opus , LLaMa-2 или Mistral Large , работают с вероятностными моделями, которые могут давать неправильные ответы в виде галлюцинаций . Поэтому им нужна не только большая база данных математических задач для обучения, но и такие методы, как контролируемая точная настройка или обученные классификаторы с аннотированными людьми данными, чтобы улучшить ответы на новые проблемы и учиться на исправлениях. [ 148 ] Исследование 2024 года показало, что эффективность некоторых языковых моделей в отношении возможностей рассуждения при решении математических задач, не включенных в их обучающие данные, была низкой, даже для задач с лишь незначительными отклонениями от обученных данных. [ 149 ]

В качестве альтернативы были разработаны специальные модели для решения математических задач с более высокой точностью результата, включая доказательство теорем, такие как Alpha Tensor , Alpha Geometry и Alpha Proof, все от Google DeepMind . [ 150 ] Лемма из элеутера [ 151 ] или Юлиус . [ 152 ]

Когда для описания математических задач используется естественный язык, преобразователи преобразуют такие подсказки в формальный язык, такой как Lean, для определения математических задач.

Некоторые модели были разработаны для решения сложных задач и достижения хороших результатов в контрольных тестах, другие — в качестве учебных пособий по математике. [ 153 ]

Финансы

Финансы — один из наиболее быстрорастущих секторов, где используются прикладные инструменты искусственного интеллекта: от розничного онлайн-банкинга до инвестиционных консультаций и страхования, где уже несколько лет используются автоматизированные «роботы-консультанты». [ 154 ]

Эксперты World Pensions , такие как Николас Фирзли, настаивают, что, возможно, еще слишком рано видеть появление высокоинновационных финансовых продуктов и услуг на основе искусственного интеллекта: «развертывание инструментов искусственного интеллекта просто приведет к дальнейшей автоматизации процессов: уничтожению десятков тысяч рабочих мест в банковском деле, финансовом планировании и пенсионное консультирование в процессе, но я не уверен, что это вызовет новую волну [например, сложных] пенсионных инноваций». [ 155 ]

Военный

Различные страны внедряют военные приложения ИИ. [ 156 ] Основные приложения расширяют возможности управления и контроля , связи, датчиков, интеграции и совместимости. [ 157 ] Исследования направлены на сбор и анализ разведывательной информации, логистику, кибероперации, информационные операции, а также полуавтономные и автономные транспортные средства . [ 156 ] Технологии искусственного интеллекта обеспечивают координацию датчиков и исполнительных устройств, обнаружение и идентификацию угроз, маркировку позиций противника, захват целей , координацию и устранение конфликтов в распределенных совместных огнях между объединенными в сеть боевыми машинами с участием пилотируемых и беспилотных групп. [ 157 ] ИИ был задействован в военных операциях в Ираке и Сирии. [ 156 ]

В ноябре 2023 года вице-президент США Камала Харрис обнародовала подписанную 31 страной декларацию, устанавливающую ограничения на использование искусственного интеллекта в военных целях. Обязательства включают в себя проведение юридических проверок для обеспечения соответствия военного ИИ международному праву, а также осторожность и прозрачность при разработке этой технологии. [ 158 ]

Генеративный ИИ

В начале 2020-х годов генеративный искусственный интеллект получил широкое распространение. В марте 2023 года 58% взрослых американцев слышали о ChatGPT и 14% пробовали его. [ 159 ] Растущая реалистичность и простота использования генераторов текста в изображения на основе искусственного интеллекта, таких как Midjourney , DALL-E и Stable Diffusion, вызвали тенденцию к созданию вирусных фотографий, созданных с помощью искусственного интеллекта. Широкое внимание привлекли фейковая фотография Папы Франциска в белом пуховике, вымышленный арест Дональда Трампа и мистификация нападения на Пентагон , а также использование в профессиональном творчестве. [ 160 ] [ 161 ]

Агенты

Агенты искусственного интеллекта (ИИ) — это программные объекты, предназначенные для восприятия окружающей среды, принятия решений и действий автономно для достижения конкретных целей. Эти агенты могут взаимодействовать с пользователями, их средой или другими агентами. Агенты ИИ используются в различных приложениях, включая виртуальных помощников , чат-ботов , автономные транспортные средства , игровые системы и промышленную робототехнику . Агенты ИИ действуют в рамках ограничений своего программирования, доступных вычислительных ресурсов и аппаратных ограничений. Это означает, что они ограничены выполнением задач в пределах определенной области и имеют ограниченную память и возможности обработки. В реальных приложениях агенты ИИ часто сталкиваются с ограничениями по времени для принятия решений и выполнения действий. Многие агенты ИИ включают в себя алгоритмы обучения, позволяющие им со временем улучшать свою производительность посредством опыта или обучения. Используя машинное обучение, агенты ИИ могут адаптироваться к новым ситуациям и оптимизировать свое поведение для поставленных задач. [ 162 ] [ 163 ] [ 164 ]

Другие отраслевые задачи

Существуют также тысячи успешных приложений ИИ, используемых для решения конкретных проблем в конкретных отраслях или учреждениях. В опросе 2017 года каждая пятая компания сообщила, что включила искусственный интеллект в некоторые предложения или процессы. [ 165 ] Несколько примеров — хранение энергии , медицинская диагностика, военная логистика, приложения, предсказывающие результат судебных решений, внешняя политика или управление цепочками поставок.

Приложения искусственного интеллекта для эвакуации и борьбы со стихийными бедствиями растут. Искусственный интеллект использовался для расследования того, эвакуировались ли люди в крупномасштабных и мелкомасштабных эвакуациях, и если да, то каким образом, с использованием исторических данных GPS, видео или социальных сетей. Кроме того, ИИ может предоставлять информацию в реальном времени об условиях эвакуации в реальном времени. [ 166 ] [ 167 ] [ 168 ]

В сельском хозяйстве ИИ помог фермерам определить области, которые нуждаются в ирригации, удобрении, обработке пестицидами или повышении урожайности. Агрономы используют ИИ для проведения исследований и разработок. ИИ использовался для прогнозирования времени созревания таких культур, как томаты, мониторинга влажности почвы, управления сельскохозяйственными роботами, проведения прогнозной аналитики, классификации эмоций, вызываемых домашним скотом, свиней, автоматизации теплиц, обнаружения болезней и вредителей, а также экономии воды.

Искусственный интеллект используется в астрономии для анализа растущих объемов доступных данных и приложений, в основном для «классификации, регрессии, кластеризации, прогнозирования, генерации, открытия и развития новых научных идей», например, для открытия экзопланет, прогнозирования солнечной активности и различие между сигналами и инструментальными эффектами в гравитационно-волновой астрономии. Его также можно использовать для деятельности в космосе, такой как исследование космоса, включая анализ данных космических миссий, научные решения космических кораблей в реальном времени, предотвращение космического мусора и более автономную работу.

Этика

ИИ имеет потенциальные преимущества и потенциальные риски. ИИ может способствовать развитию науки и находить решения серьезных проблем: Демис Хассабис из Deep Mind надеется «разгадать интеллект, а затем использовать его для решения всего остального». [ 169 ] Однако по мере того, как использование ИИ стало широко распространенным, было выявлено несколько непредвиденных последствий и рисков. [ 170 ] Производственные системы иногда не могут учитывать этику и предвзятость в процессах обучения ИИ, особенно когда алгоритмы ИИ по своей сути необъяснимы при глубоком обучении. [ 171 ]

Риски и вред

Конфиденциальность и авторские права

Алгоритмы машинного обучения требуют больших объемов данных. Методы, используемые для получения этих данных, вызвали обеспокоенность по поводу конфиденциальности , слежки и авторских прав .

Устройства и сервисы на базе искусственного интеллекта, такие как виртуальные помощники и продукты IoT, постоянно собирают личную информацию, вызывая обеспокоенность по поводу несанкционированного сбора данных и несанкционированного доступа третьих лиц. Утрата конфиденциальности еще больше усугубляется способностью ИИ обрабатывать и объединять огромные объемы данных, что потенциально может привести к созданию общества наблюдения, в котором отдельные действия постоянно контролируются и анализируются без адекватных гарантий или прозрачности.

Собираемые конфиденциальные пользовательские данные могут включать записи онлайн-активности, данные геолокации, видео или аудио. [ 172 ] Например, чтобы создать распознавания речи алгоритмы , Amazon записал миллионы частных разговоров и позволил временным работникам прослушивать и расшифровывать некоторые из них. [ 173 ] Мнения об этой широко распространенной слежке варьируются от тех, кто считает ее необходимым злом , до тех, для кого она явно неэтична и нарушает право на неприкосновенность частной жизни . [ 174 ]

Разработчики ИИ утверждают, что это единственный способ предоставлять ценные приложения. и разработали несколько методов, которые пытаются сохранить конфиденциальность при получении данных, таких как агрегирование данных , деидентификация и дифференциальная конфиденциальность . [ 175 ] С 2016 года некоторые эксперты по конфиденциальности, такие как Синтия Дворк , начали рассматривать конфиденциальность с точки зрения справедливости . Брайан Кристиан написал, что эксперты перешли «от вопроса «что они знают» к вопросу «что они с этим делают»». [ 176 ]

Генеративный ИИ часто обучается на нелицензированных произведениях, защищенных авторским правом, в том числе в таких областях, как изображения или компьютерный код; выходные данные затем используются на основании « добросовестного использования ». Эксперты расходятся во мнениях относительно того, насколько хорошо и при каких обстоятельствах это обоснование будет иметь силу в судах; соответствующие факторы могут включать «цель и характер использования произведения, защищенного авторским правом» и «влияние на потенциальный рынок произведения, защищенного авторским правом». [ 177 ] [ 178 ] Владельцы веб-сайтов, которые не хотят, чтобы их контент удалялся, могут указать это в файле robots.txt . [ 179 ] В 2023 году ведущие авторы (в том числе Джон Гришэм и Джонатан Франзен ) подали в суд на компании, занимающиеся ИИ, за использование их работ для обучения генеративному ИИ. [ 180 ] [ 181 ] Другой обсуждаемый подход заключается в создании отдельной sui Generis системы защиты творений, созданных ИИ, чтобы обеспечить справедливое присвоение авторства и компенсацию авторам-людям. [ 182 ]

Доминирование технологических гигантов

На коммерческой сцене ИИ доминируют крупные технологические компании, такие как Alphabet Inc. , Amazon , Apple Inc. , Meta Platforms и Microsoft . [ 183 ] [ 184 ] [ 185 ] Некоторые из этих игроков уже владеют подавляющим большинством существующей облачной инфраструктуры и вычислительными мощностями центров обработки данных , что позволяет им еще больше укрепиться на рынке. [ 186 ] [ 187 ]

Значительные потребности в электроэнергии и другие воздействия на окружающую среду

В январе 2024 года Международное энергетическое агентство (МЭА) опубликовало «Электричество 2024, анализ и прогноз до 2026 года» , в котором прогнозируется потребление электроэнергии. [ 188 ] Это первый отчет МЭА, в котором представлены прогнозы относительно центров обработки данных и энергопотребления для искусственного интеллекта и криптовалют. В отчете говорится, что спрос на электроэнергию для этих целей может удвоиться к 2026 году, при этом дополнительное потребление электроэнергии будет равно объему электроэнергии, потребляемой всей японской страной. [ 189 ]

Колоссальное энергопотребление ИИ является причиной роста использования ископаемого топлива и может задержать закрытие устаревших угольных энергетических объектов, выделяющих углерод. В США наблюдается лихорадочный рост строительства центров обработки данных, превращающий крупные технологические компании (например, Microsoft, Meta, Google, Amazon) в ненасытных потребителей электроэнергии. Прогнозируемое потребление электроэнергии настолько велико, что есть опасения, что оно будет обеспечено независимо от источника. Поиск ChatGPT требует в 10 раз больше электроэнергии, чем поиск Google. Крупные фирмы торопятся найти источники энергии – от ядерной энергии до геотермальной энергии и термоядерного синтеза. Технологические компании утверждают, что в долгосрочной перспективе ИИ в конечном итоге станет более добрым к окружающей среде, но энергия им нужна сейчас. По мнению технологических компаний, искусственный интеллект сделает энергосистему более эффективной и «интеллектуальной», будет способствовать развитию атомной энергетики и отслеживать общие выбросы углекислого газа. [ 190 ]

2024 года Goldman Sachs В исследовательском документе « Центры обработки данных искусственного интеллекта и грядущий всплеск спроса на электроэнергию в США » говорится, что «спрос на электроэнергию в США, вероятно, будет испытывать рост, не наблюдавшийся в течение одного поколения…». и прогнозирует, что к 2030 году центры обработки данных США будут потреблять 8% электроэнергии в США по сравнению с 3% в 2022 году, что предвещает рост электроэнергетической отрасли различными способами. [ 191 ] Потребность центров обработки данных во все большем и большем количестве электроэнергии такова, что они могут максимально использовать электрическую сеть. Крупные технологические компании возражают, что искусственный интеллект может использоваться для максимального использования энергосистемы всеми. [ 192 ]

В 2024 году газета Wall Street Journal сообщила, что крупные компании, занимающиеся искусственным интеллектом, начали переговоры с поставщиками атомной энергии США о поставке электроэнергии в центры обработки данных. В марте 2024 года Amazon приобрела ядерный центр обработки данных в Пенсильвании за 650 миллионов долларов США. [ 193 ]

Дезинформация

YouTube , Facebook и другие используют системы рекомендаций , чтобы направлять пользователей к большему количеству контента. Целью этих программ искусственного интеллекта было максимальное вовлечение пользователей (то есть единственной целью было заставить людей следить за происходящим). ИИ узнал, что пользователи склонны выбирать дезинформацию , теории заговора и крайне предвзятый контент, и, чтобы удержать их на просмотре, ИИ рекомендовал больше такого контента. Пользователи также склонны смотреть больше контента на одну и ту же тему, поэтому ИИ направлял людей в пузыри фильтров , где они получали несколько версий одной и той же дезинформации. [ 194 ] Это убедило многих пользователей в правдивости дезинформации и в конечном итоге подорвало доверие к институтам, СМИ и правительству. [ 195 ] Программа ИИ правильно научилась максимизировать свою цель, но результат был вреден для общества. После выборов в США в 2016 году крупные технологические компании предприняли шаги по смягчению проблемы. [ нужна ссылка ] .

В 2022 году генеративный ИИ начал создавать изображения, аудио, видео и текст, неотличимые от реальных фотографий, записей, фильмов или написанного человеком текста. Злоумышленники могут использовать эту технологию для создания огромного количества дезинформации или пропаганды. [ 196 ] Пионер ИИ Джеффри Хинтон выразил обеспокоенность по поводу того, что ИИ, помимо других рисков, позволяет «авторитарным лидерам манипулировать своим электоратом» в больших масштабах. [ 197 ]

Алгоритмическая предвзятость и справедливость

В статистике смещение — это систематическая ошибка или отклонение от правильного значения. Но в контексте справедливости это часто относится к тенденции в пользу или против определенной группы или индивидуальной характеристики, обычно такой, которая считается несправедливой или вредной. Таким образом, статистически объективная система ИИ, которая дает несопоставимые результаты для разных демографических групп, может рассматриваться как предвзятая в этическом смысле. [ 198 ]

Область справедливости изучает, как предотвратить вред от алгоритмических предубеждений. Существуют различные противоречивые определения и математические модели справедливости. Эти представления зависят от этических предположений и находятся под влиянием представлений об обществе. Одной из широких категорий является справедливость распределения, которая фокусируется на результатах, часто выявляя группы и стремясь компенсировать статистические различия. Репрезентативная справедливость направлена на то, чтобы системы искусственного интеллекта не укрепляли негативные стереотипы и не делали определенные группы невидимыми. Процедурная справедливость фокусируется на процессе принятия решений, а не на результате. Наиболее важные понятия справедливости могут зависеть от контекста, в частности от типа приложения ИИ и заинтересованных сторон. Субъективность понятий предвзятости и справедливости затрудняет их практическую реализацию компаниями. Многие специалисты по этике ИИ также считают, что доступ к чувствительным атрибутам, таким как раса или пол, необходим для компенсации предубеждений, но это может противоречить антидискриминационные законы . [ 198 ]

Приложения машинного обучения будут предвзятыми, если они будут учиться на предвзятых данных. [ 199 ] Разработчики могут не знать о существовании предвзятости. [ 200 ] Смещение может быть вызвано способом выбора обучающих данных и способом развертывания модели. [ 201 ] [ 199 ] Если предвзятый алгоритм используется для принятия решений, которые могут серьезно навредить людям (как это может быть в медицине , финансах , найме на работу , жилье или полиции ), тогда этот алгоритм может вызвать дискриминацию . [ 202 ]

28 июня 2015 года новая функция маркировки изображений в Google Фото ошибочно определила Джеки Алсина и его друга как «горилл», потому что они были черными. Система была обучена на наборе данных, содержащем очень мало изображений чернокожих людей. [ 203 ] проблема под названием «несоответствие размера выборки». [ 204 ] Google «исправил» эту проблему, запретив системе помечать что-либо как «гориллу». Восемь лет спустя, в 2023 году, Google Photos все еще не смог идентифицировать гориллу, как и аналогичные продукты Apple, Facebook, Microsoft и Amazon. [ 205 ]

COMPAS – коммерческая программа, широко используемая судами США для оценки вероятности того, что обвиняемый станет рецидивистом . В 2016 году Джулия Ангвин из ProPublica обнаружила, что КОМПАС демонстрирует расовую предвзятость, несмотря на то, что программе не была указана расовая принадлежность обвиняемых. Хотя частота ошибок как для белых, так и для черных была калибрована равной ровно 61%, ошибки для каждой расы были разными — система постоянно переоценивала вероятность того, что чернокожий человек совершит повторное правонарушение, и недооценивала вероятность того, что белый человек не совершит правонарушение. повторно обидеть. [ 206 ] В 2017 году несколько исследователей [ к ] показало, что COMPAS математически невозможно учесть все возможные меры справедливости, когда базовые показатели повторных правонарушений различаются для белых и черных в данных. [ 208 ]

Программа может принимать предвзятые решения, даже если в данных явно не упоминается проблемный признак (например, «раса» или «пол»). Эта функция будет коррелировать с другими функциями (такими как «адрес», «история покупок» или «имя»), и программа будет принимать те же решения на основе этих функций, что и на основе «расы» или «пола». [ 209 ] Мориц Хардт сказал, что «самый убедительный факт в этой области исследований заключается в том, что справедливость через слепоту не работает». [ 210 ]

Критика COMPAS подчеркнула, что модели машинного обучения созданы для того, чтобы делать «прогнозы», которые действительны только в том случае, если мы предполагаем, что будущее будет напоминать прошлое. Если они обучаются на данных, которые включают результаты расистских решений в прошлом, модели машинного обучения должны предсказывать, что расистские решения будут приняты в будущем. Если приложение затем использует эти прогнозы в качестве рекомендаций , некоторые из этих «рекомендаций», скорее всего, будут расистскими. [ 211 ] Таким образом, машинное обучение не очень подходит для принятия решений в тех областях, где есть надежда, что будущее будет лучше прошлого. Он носит скорее описательный, чем предписывающий характер. [ л ]

Предвзятость и несправедливость могут остаться незамеченными, поскольку разработчики в подавляющем большинстве белые и мужчины: среди инженеров ИИ около 4% — чернокожие, а 20% — женщины. [ 204 ]

На своей конференции по справедливости, подотчетности и прозрачности 2022 года (ACM FAccT 2022) Ассоциация вычислительной техники в Сеуле, Южная Корея, представила и опубликовала результаты, которые рекомендуют, чтобы до тех пор, пока системы искусственного интеллекта и робототехники не будут продемонстрированы, что они свободны от ошибок предвзятости, они небезопасны, и следует ограничить использование самообучающихся нейронных сетей, обученных на огромных нерегулируемых источниках ошибочных интернет-данных. [ сомнительно – обсудить ] [ 213 ]

Отсутствие прозрачности

Многие системы искусственного интеллекта настолько сложны, что их разработчики не могут объяснить, как они принимают решения. [ 214 ] Особенно с глубокими нейронными сетями , в которых существует большое количество нелинейных связей между входными и выходными данными. Но существуют некоторые популярные методы объяснения. [ 215 ]

Невозможно быть уверенным в том, что программа работает правильно, если никто не знает, как именно она работает. Было много случаев, когда программа машинного обучения прошла строгие тесты, но, тем не менее, узнала нечто иное, чем то, что планировали программисты. Например, было обнаружено, что система, которая может идентифицировать кожные заболевания лучше, чем медицинские работники, на самом деле имеет сильную тенденцию классифицировать изображения с линейкой как «раковые», поскольку изображения злокачественных новообразований обычно включают линейку, показывающую масштаб. [ 216 ] Было обнаружено, что другая система машинного обучения, разработанная для эффективного распределения медицинских ресурсов, классифицирует пациентов с астмой как людей с «низким риском» смерти от пневмонии. Наличие астмы на самом деле является серьезным фактором риска, но, поскольку пациенты, страдающие астмой, обычно получают гораздо больше медицинской помощи, согласно данным обучения, их смерть относительно маловероятна. Корреляция между астмой и низким риском смерти от пневмонии была реальной, но вводящей в заблуждение. [ 217 ]

Люди, пострадавшие от решения алгоритма, имеют право на объяснение. [ 218 ] Doctors, for example, are expected to clearly and completely explain to their colleagues the reasoning behind any decision they make. Early drafts of the European Union's General Data Protection Regulation in 2016 included an explicit statement that this right exists.[m] Industry experts noted that this is an unsolved problem with no solution in sight. Regulators argued that nevertheless the harm is real: if the problem has no solution, the tools should not be used.[219]

DARPA established the XAI ("Explainable Artificial Intelligence") program in 2014 to try and solve these problems.[220]

Several approaches aim to address the transparency problem. SHAP enables to visualise the contribution of each feature to the output.[221] LIME can locally approximate a model's outputs with a simpler, interpretable model.[222] Multitask learning provides a large number of outputs in addition to the target classification. These other outputs can help developers deduce what the network has learned.[223] Deconvolution, DeepDream and other generative methods can allow developers to see what different layers of a deep network for computer vision have learned, and produce output that can suggest what the network is learning.[224] For generative pre-trained transformers, Anthropic developed a technique based on dictionary learning that associates patterns of neuron activations with human-understandable concepts.[225]

Bad actors and weaponized AI

Artificial intelligence provides a number of tools that are useful to bad actors, such as authoritarian governments, terrorists, criminals or rogue states.

A lethal autonomous weapon is a machine that locates, selects and engages human targets without human supervision.[n] Widely available AI tools can be used by bad actors to develop inexpensive autonomous weapons and, if produced at scale, they are potentially weapons of mass destruction.[227] Even when used in conventional warfare, it is unlikely that they will be unable to reliably choose targets and could potentially kill an innocent person.[227] In 2014, 30 nations (including China) supported a ban on autonomous weapons under the United Nations' Convention on Certain Conventional Weapons, however the United States and others disagreed.[228] By 2015, over fifty countries were reported to be researching battlefield robots.[229]

AI tools make it easier for authoritarian governments to efficiently control their citizens in several ways. Face and voice recognition allow widespread surveillance. Machine learning, operating this data, can classify potential enemies of the state and prevent them from hiding. Recommendation systems can precisely target propaganda and misinformation for maximum effect. Deepfakes and generative AI aid in producing misinformation. Advanced AI can make authoritarian centralized decision making more competitive than liberal and decentralized systems such as markets. It lowers the cost and difficulty of digital warfare and advanced spyware.[230] All these technologies have been available since 2020 or earlier—AI facial recognition systems are already being used for mass surveillance in China.[231][232]

There many other ways that AI is expected to help bad actors, some of which can not be foreseen. For example, machine-learning AI is able to design tens of thousands of toxic molecules in a matter of hours.[233]

Technological unemployment

Economists have frequently highlighted the risks of redundancies from AI, and speculated about unemployment if there is no adequate social policy for full employment.[234]

In the past, technology has tended to increase rather than reduce total employment, but economists acknowledge that "we're in uncharted territory" with AI.[235] A survey of economists showed disagreement about whether the increasing use of robots and AI will cause a substantial increase in long-term unemployment, but they generally agree that it could be a net benefit if productivity gains are redistributed.[236] Risk estimates vary; for example, in the 2010s, Michael Osborne and Carl Benedikt Frey estimated 47% of U.S. jobs are at "high risk" of potential automation, while an OECD report classified only 9% of U.S. jobs as "high risk".[o][238] The methodology of speculating about future employment levels has been criticised as lacking evidential foundation, and for implying that technology, rather than social policy, creates unemployment, as opposed to redundancies.[234] In April 2023, it was reported that 70% of the jobs for Chinese video game illustrators had been eliminated by generative artificial intelligence.[239][240]

Unlike previous waves of automation, many middle-class jobs may be eliminated by artificial intelligence; The Economist stated in 2015 that "the worry that AI could do to white-collar jobs what steam power did to blue-collar ones during the Industrial Revolution" is "worth taking seriously".[241] Jobs at extreme risk range from paralegals to fast food cooks, while job demand is likely to increase for care-related professions ranging from personal healthcare to the clergy.[242]

From the early days of the development of artificial intelligence, there have been arguments, for example, those put forward by Joseph Weizenbaum, about whether tasks that can be done by computers actually should be done by them, given the difference between computers and humans, and between quantitative calculation and qualitative, value-based judgement.[243]

Existential risk

It has been argued AI will become so powerful that humanity may irreversibly lose control of it. This could, as physicist Stephen Hawking stated, "spell the end of the human race".[244] This scenario has been common in science fiction, when a computer or robot suddenly develops a human-like "self-awareness" (or "sentience" or "consciousness") and becomes a malevolent character.[p] These sci-fi scenarios are misleading in several ways.

First, AI does not require human-like "sentience" to be an existential risk. Modern AI programs are given specific goals and use learning and intelligence to achieve them. Philosopher Nick Bostrom argued that if one gives almost any goal to a sufficiently powerful AI, it may choose to destroy humanity to achieve it (he used the example of a paperclip factory manager).[246] Stuart Russell gives the example of household robot that tries to find a way to kill its owner to prevent it from being unplugged, reasoning that "you can't fetch the coffee if you're dead."[247] In order to be safe for humanity, a superintelligence would have to be genuinely aligned with humanity's morality and values so that it is "fundamentally on our side".[248]

Second, Yuval Noah Harari argues that AI does not require a robot body or physical control to pose an existential risk. The essential parts of civilization are not physical. Things like ideologies, law, government, money and the economy are made of language; they exist because there are stories that billions of people believe. The current prevalence of misinformation suggests that an AI could use language to convince people to believe anything, even to take actions that are destructive.[249]

The opinions amongst experts and industry insiders are mixed, with sizable fractions both concerned and unconcerned by risk from eventual superintelligent AI.[250] Personalities such as Stephen Hawking, Bill Gates, and Elon Musk,[251] as well as AI pioneers such as Yoshua Bengio, Stuart Russell, Demis Hassabis, and Sam Altman, have expressed concerns about existential risk from AI.

In May 2023, Geoffrey Hinton announced his resignation from Google in order to be able to "freely speak out about the risks of AI" without "considering how this impacts Google."[252] He notably mentioned risks of an AI takeover,[253] and stressed that in order to avoid the worst outcomes, establishing safety guidelines will require cooperation among those competing in use of AI.[254]

In 2023, many leading AI experts issued the joint statement that "Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war".[255]

Other researchers, however, spoke in favor of a less dystopian view. AI pioneer Juergen Schmidhuber did not sign the joint statement, emphasising that in 95% of all cases, AI research is about making "human lives longer and healthier and easier."[256] While the tools that are now being used to improve lives can also be used by bad actors, "they can also be used against the bad actors."[257][258] Andrew Ng also argued that "it's a mistake to fall for the doomsday hype on AI—and that regulators who do will only benefit vested interests."[259] Yann LeCun "scoffs at his peers' dystopian scenarios of supercharged misinformation and even, eventually, human extinction."[260] In the early 2010s, experts argued that the risks are too distant in the future to warrant research or that humans will be valuable from the perspective of a superintelligent machine.[261] However, after 2016, the study of current and future risks and possible solutions became a serious area of research.[262]

Ethical machines and alignment

Friendly AI are machines that have been designed from the beginning to minimize risks and to make choices that benefit humans. Eliezer Yudkowsky, who coined the term, argues that developing friendly AI should be a higher research priority: it may require a large investment and it must be completed before AI becomes an existential risk.[263]

Machines with intelligence have the potential to use their intelligence to make ethical decisions. The field of machine ethics provides machines with ethical principles and procedures for resolving ethical dilemmas.[264] The field of machine ethics is also called computational morality,[264] and was founded at an AAAI symposium in 2005.[265]

Other approaches include Wendell Wallach's "artificial moral agents"[266] and Stuart J. Russell's three principles for developing provably beneficial machines.[267]

Open source

Active organizations in the AI open-source community include Hugging Face,[268] Google,[269] EleutherAI and Meta.[270] Various AI models, such as Llama 2, Mistral or Stable Diffusion, have been made open-weight,[271][272] meaning that their architecture and trained parameters (the "weights") are publicly available. Open-weight models can be freely fine-tuned, which allows companies to specialize them with their own data and for their own use-case.[273] Open-weight models are useful for research and innovation but can also be misused. Since they can be fine-tuned, any built-in security measure, such as objecting to harmful requests, can be trained away until it becomes ineffective. Some researchers warn that future AI models may develop dangerous capabilities (such as the potential to drastically facilitate bioterrorism) and that once released on the Internet, they can't be deleted everywhere if needed. They recommend pre-release audits and cost-benefit analyses.[274]

Frameworks

Artificial Intelligence projects can have their ethical permissibility tested while designing, developing, and implementing an AI system. An AI framework such as the Care and Act Framework containing the SUM values—developed by the Alan Turing Institute tests projects in four main areas:[275][276]

- Respect the dignity of individual people

- Connect with other people sincerely, openly, and inclusively

- Care for the wellbeing of everyone

- Protect social values, justice, and the public interest

Other developments in ethical frameworks include those decided upon during the Asilomar Conference, the Montreal Declaration for Responsible AI, and the IEEE's Ethics of Autonomous Systems initiative, among others;[277] however, these principles do not go without their criticisms, especially regards to the people chosen contributes to these frameworks.[278]

Promotion of the wellbeing of the people and communities that these technologies affect requires consideration of the social and ethical implications at all stages of AI system design, development and implementation, and collaboration between job roles such as data scientists, product managers, data engineers, domain experts, and delivery managers.[279]

The UK AI Safety Institute released in 2024 a testing toolset called 'Inspect' for AI safety evaluations available under a MIT open-source licence which is freely available on GitHub and can be improved with third-party packages. It can be used to evaluate AI models in a range of areas including core knowledge, ability to reason, and autonomous capabilities.[280]

Regulation

The regulation of artificial intelligence is the development of public sector policies and laws for promoting and regulating AI; it is therefore related to the broader regulation of algorithms.[281] The regulatory and policy landscape for AI is an emerging issue in jurisdictions globally.[282] According to AI Index at Stanford, the annual number of AI-related laws passed in the 127 survey countries jumped from one passed in 2016 to 37 passed in 2022 alone.[283][284] Between 2016 and 2020, more than 30 countries adopted dedicated strategies for AI.[285] Most EU member states had released national AI strategies, as had Canada, China, India, Japan, Mauritius, the Russian Federation, Saudi Arabia, United Arab Emirates, U.S., and Vietnam. Others were in the process of elaborating their own AI strategy, including Bangladesh, Malaysia and Tunisia.[285] The Global Partnership on Artificial Intelligence was launched in June 2020, stating a need for AI to be developed in accordance with human rights and democratic values, to ensure public confidence and trust in the technology.[285] Henry Kissinger, Eric Schmidt, and Daniel Huttenlocher published a joint statement in November 2021 calling for a government commission to regulate AI.[286] In 2023, OpenAI leaders published recommendations for the governance of superintelligence, which they believe may happen in less than 10 years.[287] In 2023, the United Nations also launched an advisory body to provide recommendations on AI governance; the body comprises technology company executives, governments officials and academics.[288]

In a 2022 Ipsos survey, attitudes towards AI varied greatly by country; 78% of Chinese citizens, but only 35% of Americans, agreed that "products and services using AI have more benefits than drawbacks".[283] A 2023 Reuters/Ipsos poll found that 61% of Americans agree, and 22% disagree, that AI poses risks to humanity.[289] In a 2023 Fox News poll, 35% of Americans thought it "very important", and an additional 41% thought it "somewhat important", for the federal government to regulate AI, versus 13% responding "not very important" and 8% responding "not at all important".[290][291]

In November 2023, the first global AI Safety Summit was held in Bletchley Park in the UK to discuss the near and far term risks of AI and the possibility of mandatory and voluntary regulatory frameworks.[292] 28 countries including the United States, China, and the European Union issued a declaration at the start of the summit, calling for international co-operation to manage the challenges and risks of artificial intelligence.[293][294] In May 2024 at the AI Seoul Summit, 16 global AI tech companies agreed to safety commitments on the development of AI.[295][296]

History

The study of mechanical or "formal" reasoning began with philosophers and mathematicians in antiquity. The study of logic led directly to Alan Turing's theory of computation, which suggested that a machine, by shuffling symbols as simple as "0" and "1", could simulate any conceivable form of mathematical reasoning.[297][4] This, along with concurrent discoveries in cybernetics, information theory and neurobiology, led researchers to consider the possibility of building an "electronic brain".[q] They developed several areas of research that would become part of AI,[299] such as McCullouch and Pitts design for "artificial neurons" in 1943,[119] and Turing's influential 1950 paper 'Computing Machinery and Intelligence', which introduced the Turing test and showed that "machine intelligence" was plausible.[300][4]

The field of AI research was founded at a workshop at Dartmouth College in 1956.[r][5] The attendees became the leaders of AI research in the 1960s.[s] They and their students produced programs that the press described as "astonishing":[t] computers were learning checkers strategies, solving word problems in algebra, proving logical theorems and speaking English.[u][8] Artificial intelligence laboratories were set up at a number of British and U.S. universities in the latter 1950s and early 1960s.[4]

Researchers in the 1960s and the 1970s were convinced that their methods would eventually succeed in creating a machine with general intelligence and considered this the goal of their field.[304] In 1965 Herbert Simon predicted, "machines will be capable, within twenty years, of doing any work a man can do".[305] In 1967 Marvin Minsky agreed, writing, "within a generation ... the problem of creating 'artificial intelligence' will substantially be solved".[306] They had, however, underestimated the difficulty of the problem.[v] In 1974, both the U.S. and British governments cut off exploratory research in response to the criticism of Sir James Lighthill[308] and ongoing pressure from the U.S. Congress to fund more productive projects.[309] Minsky's and Papert's book Perceptrons was understood as proving that artificial neural networks would never be useful for solving real-world tasks, thus discrediting the approach altogether.[310] The "AI winter", a period when obtaining funding for AI projects was difficult, followed.[10]

In the early 1980s, AI research was revived by the commercial success of expert systems,[311] a form of AI program that simulated the knowledge and analytical skills of human experts. By 1985, the market for AI had reached over a billion dollars. At the same time, Japan's fifth generation computer project inspired the U.S. and British governments to restore funding for academic research.[9] However, beginning with the collapse of the Lisp Machine market in 1987, AI once again fell into disrepute, and a second, longer-lasting winter began.[11]

Up to this point, most of AI's funding had gone to projects that used high-level symbols to represent mental objects like plans, goals, beliefs, and known facts. In the 1980s, some researchers began to doubt that this approach would be able to imitate all the processes of human cognition, especially perception, robotics, learning and pattern recognition,[312] and began to look into "sub-symbolic" approaches.[313] Rodney Brooks rejected "representation" in general and focussed directly on engineering machines that move and survive.[w] Judea Pearl, Lofti Zadeh and others developed methods that handled incomplete and uncertain information by making reasonable guesses rather than precise logic.[90][318] But the most important development was the revival of "connectionism", including neural network research, by Geoffrey Hinton and others.[319] In 1990, Yann LeCun successfully showed that convolutional neural networks can recognize handwritten digits, the first of many successful applications of neural networks.[320]

AI gradually restored its reputation in the late 1990s and early 21st century by exploiting formal mathematical methods and by finding specific solutions to specific problems. This "narrow" and "formal" focus allowed researchers to produce verifiable results and collaborate with other fields (such as statistics, economics and mathematics).[321] By 2000, solutions developed by AI researchers were being widely used, although in the 1990s they were rarely described as "artificial intelligence".[322] However, several academic researchers became concerned that AI was no longer pursuing its original goal of creating versatile, fully intelligent machines. Beginning around 2002, they founded the subfield of artificial general intelligence (or "AGI"), which had several well-funded institutions by the 2010s.[15]

Deep learning began to dominate industry benchmarks in 2012 and was adopted throughout the field.[12] For many specific tasks, other methods were abandoned.[x] Deep learning's success was based on both hardware improvements (faster computers,[324] graphics processing units, cloud computing[325]) and access to large amounts of data[326] (including curated datasets,[325] such as ImageNet). Deep learning's success led to an enormous increase in interest and funding in AI.[y] The amount of machine learning research (measured by total publications) increased by 50% in the years 2015–2019.[285]

In 2016, issues of fairness and the misuse of technology were catapulted into center stage at machine learning conferences, publications vastly increased, funding became available, and many researchers re-focussed their careers on these issues. The alignment problem became a serious field of academic study.[262]

In the late teens and early 2020s, AGI companies began to deliver programs that created enormous interest. In 2015, AlphaGo, developed by DeepMind, beat the world champion Go player. The program was taught only the rules of the game and developed strategy by itself. GPT-3 is a large language model that was released in 2020 by OpenAI and is capable of generating high-quality human-like text.[327] These programs, and others, inspired an aggressive AI boom, where large companies began investing billions in AI research. According to AI Impacts, about $50 billion annually was invested in "AI" around 2022 in the U.S. alone and about 20% of the new U.S. Computer Science PhD graduates have specialized in "AI".[328] About 800,000 "AI"-related U.S. job openings existed in 2022.[329]

Philosophy

Defining artificial intelligence

Alan Turing wrote in 1950 "I propose to consider the question 'can machines think'?"[330] He advised changing the question from whether a machine "thinks", to "whether or not it is possible for machinery to show intelligent behaviour".[330] He devised the Turing test, which measures the ability of a machine to simulate human conversation.[300] Since we can only observe the behavior of the machine, it does not matter if it is "actually" thinking or literally has a "mind". Turing notes that we can not determine these things about other people but "it is usual to have a polite convention that everyone thinks."[331]

Russell and Norvig agree with Turing that intelligence must be defined in terms of external behavior, not internal structure.[1] However, they are critical that the test requires the machine to imitate humans. "Aeronautical engineering texts," they wrote, "do not define the goal of their field as making 'machines that fly so exactly like pigeons that they can fool other pigeons.'"[333] AI founder John McCarthy agreed, writing that "Artificial intelligence is not, by definition, simulation of human intelligence".[334]

McCarthy defines intelligence as "the computational part of the ability to achieve goals in the world".[335] Another AI founder, Marvin Minsky similarly describes it as "the ability to solve hard problems".[336] The leading AI textbook defines it as the study of agents that perceive their environment and take actions that maximize their chances of achieving defined goals.[1] These definitions view intelligence in terms of well-defined problems with well-defined solutions, where both the difficulty of the problem and the performance of the program are direct measures of the "intelligence" of the machine—and no other philosophical discussion is required, or may not even be possible.

Another definition has been adopted by Google,[337] a major practitioner in the field of AI. This definition stipulates the ability of systems to synthesize information as the manifestation of intelligence, similar to the way it is defined in biological intelligence.

Some authors have suggested in practice, that the definition of AI is vague and difficult to define, with contention as to whether classical algorithms should be categorised as AI,[338] with many companies during the early 2020s AI boom using the term as a marketing buzzword, often even if they did "not actually use AI in a material way".[339]

Evaluating approaches to AI

No established unifying theory or paradigm has guided AI research for most of its history.[z] The unprecedented success of statistical machine learning in the 2010s eclipsed all other approaches (so much so that some sources, especially in the business world, use the term "artificial intelligence" to mean "machine learning with neural networks"). This approach is mostly sub-symbolic, soft and narrow. Critics argue that these questions may have to be revisited by future generations of AI researchers.

Symbolic AI and its limits

Symbolic AI (or "GOFAI")[341] simulated the high-level conscious reasoning that people use when they solve puzzles, express legal reasoning and do mathematics. They were highly successful at "intelligent" tasks such as algebra or IQ tests. In the 1960s, Newell and Simon proposed the physical symbol systems hypothesis: "A physical symbol system has the necessary and sufficient means of general intelligent action."[342]

However, the symbolic approach failed on many tasks that humans solve easily, such as learning, recognizing an object or commonsense reasoning. Moravec's paradox is the discovery that high-level "intelligent" tasks were easy for AI, but low level "instinctive" tasks were extremely difficult.[343] Philosopher Hubert Dreyfus had argued since the 1960s that human expertise depends on unconscious instinct rather than conscious symbol manipulation, and on having a "feel" for the situation, rather than explicit symbolic knowledge.[344] Although his arguments had been ridiculed and ignored when they were first presented, eventually, AI research came to agree with him.[aa][20]